Krystal_1

用戶暫無簡介

Krystal_1

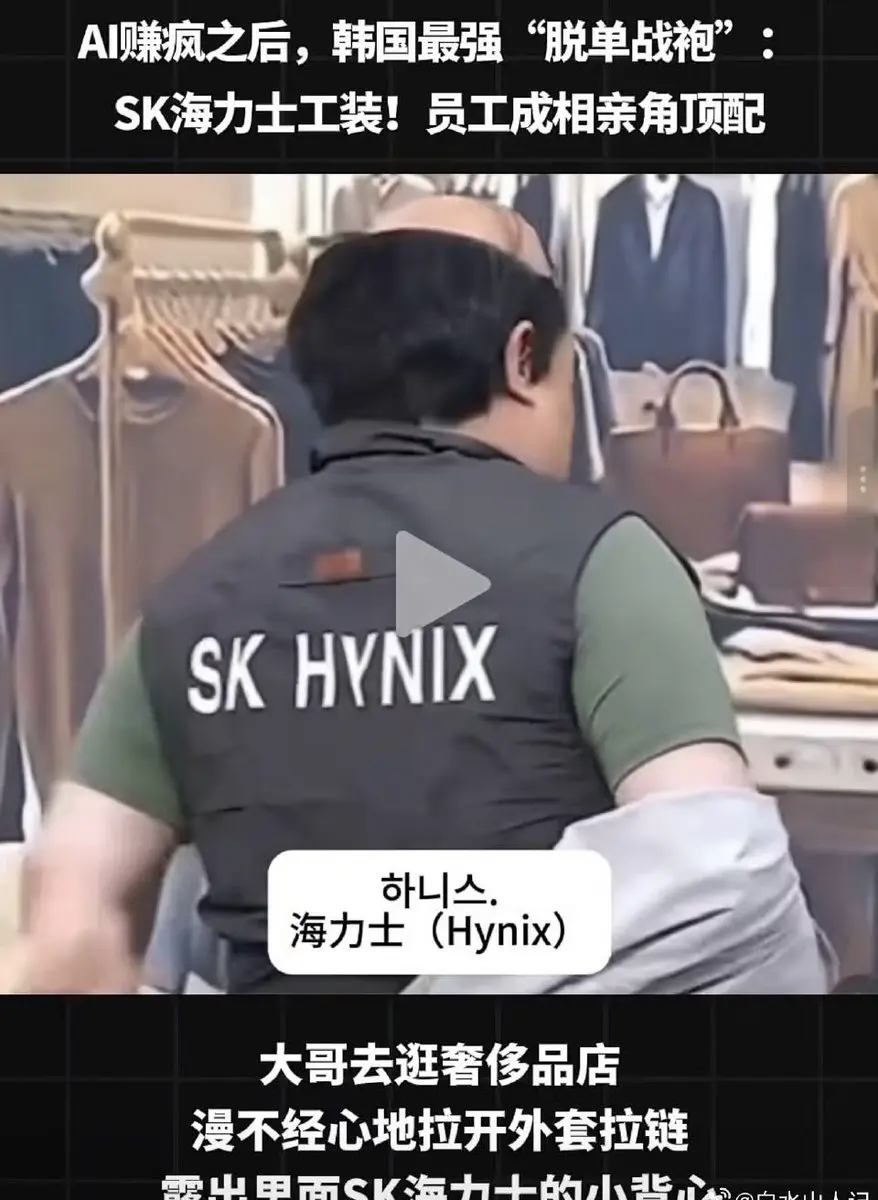

韓國存儲巨頭SK海力士最新出爐的財報,直接吊打英偉達了

SK海力士一季度營收355億美元,淨利潤就達到254億美元,淨利潤率飆升至77%,穩穩超過英偉達。

這個利潤率到底有多誇張?特斯拉巔峰時期淨利率才15%,常年暴利的茅台也僅有30%上下,把英偉達65%的利潤率比下去了,更不用說台積電的58%,成了全球芯片圈最能賺錢的公司。

77%的淨利潤率是什麼概念?簡單來說,賣出100元的存儲芯片,到手純利潤就有77元。放眼全球所有製造業,乃至絕大多數行業,幾乎再也找不出第二個能達到這種盈利水平的企業。

現在全世界的科技公司都在建AI數據中心,要用一種叫HBM的高端內存,SK海力士在這塊做得最早,也做得最好,賣得貴,別人還搶著要。

光是內存芯片價格,一個季度就漲了六成,閃存漲了七成。

手機、電腦用的普通內存不太好賣,但AI伺服器要的芯片賣瘋了,把少賺的錢全補回來了。

還有一點,現在供不應求。

查看原文SK海力士一季度營收355億美元,淨利潤就達到254億美元,淨利潤率飆升至77%,穩穩超過英偉達。

這個利潤率到底有多誇張?特斯拉巔峰時期淨利率才15%,常年暴利的茅台也僅有30%上下,把英偉達65%的利潤率比下去了,更不用說台積電的58%,成了全球芯片圈最能賺錢的公司。

77%的淨利潤率是什麼概念?簡單來說,賣出100元的存儲芯片,到手純利潤就有77元。放眼全球所有製造業,乃至絕大多數行業,幾乎再也找不出第二個能達到這種盈利水平的企業。

現在全世界的科技公司都在建AI數據中心,要用一種叫HBM的高端內存,SK海力士在這塊做得最早,也做得最好,賣得貴,別人還搶著要。

光是內存芯片價格,一個季度就漲了六成,閃存漲了七成。

手機、電腦用的普通內存不太好賣,但AI伺服器要的芯片賣瘋了,把少賺的錢全補回來了。

還有一點,現在供不應求。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

韓國存儲巨頭SK海力士最新公布的財報,直接碾壓英偉達了

SK海力士一季度營收355億美元,淨利潤就達到254億美元,淨利潤率飆升至77%,穩穩超過英偉達。

這個利潤率到底有多誇張?特斯拉巔峰時期淨利率才15%,常年暴利的茅台也僅有30%上下,把英偉達65%的利潤率比下去了,更不用說台積電的58%,成了全球芯片圈最能賺錢的公司。

77%的淨利潤率是什麼概念?簡單來說,賣出100元的存儲芯片,到手純利潤就有77元。放眼全球所有製造業,乃至絕大多數行業,幾乎再也找不出第二個能達到這種盈利水平的企業。

現在全世界的科技公司都在建AI數據中心,要用一種叫HBM的高端內存,SK海力士在這塊做得最早,也做得最好,賣得貴,別人還搶著要。

光是內存芯片價格,一個季度就漲了六成,閃存漲了七成。

手機、電腦用的普通內存不太好賣,但AI伺服器要的芯片賣瘋了,把少賺的錢全補回來了。

還有一點,現在供不應求。

查看原文SK海力士一季度營收355億美元,淨利潤就達到254億美元,淨利潤率飆升至77%,穩穩超過英偉達。

這個利潤率到底有多誇張?特斯拉巔峰時期淨利率才15%,常年暴利的茅台也僅有30%上下,把英偉達65%的利潤率比下去了,更不用說台積電的58%,成了全球芯片圈最能賺錢的公司。

77%的淨利潤率是什麼概念?簡單來說,賣出100元的存儲芯片,到手純利潤就有77元。放眼全球所有製造業,乃至絕大多數行業,幾乎再也找不出第二個能達到這種盈利水平的企業。

現在全世界的科技公司都在建AI數據中心,要用一種叫HBM的高端內存,SK海力士在這塊做得最早,也做得最好,賣得貴,別人還搶著要。

光是內存芯片價格,一個季度就漲了六成,閃存漲了七成。

手機、電腦用的普通內存不太好賣,但AI伺服器要的芯片賣瘋了,把少賺的錢全補回來了。

還有一點,現在供不應求。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

以 AI 為由裁員,已成為硅谷新“風向”

▪️亞馬遜:裁3萬人,AI取代人工任務

▪️Block:裁4000人,扁平化AI組織

▪️Snap:裁千人,AI削減重複勞動

▪️Meta:5月20日再裁8000人,占員工總數約10%,全年持續縮編

看似是AI迭代淘汰人力,實則另有隱情。

黃仁勛一針見血戳破真相

「靠裁員應對AI的管理者,只是沒有創新能力,拿工具當藉口」

行業共識:AI是漂亮遮羞布,營收壓力才是底層邏輯。多位業界大佬曾就此進行過表態,認為許多以“AI 迭代生產力”為理由進行裁員的公司,其實只是在掩蓋業務前景或營收壓力。

查看原文▪️亞馬遜:裁3萬人,AI取代人工任務

▪️Block:裁4000人,扁平化AI組織

▪️Snap:裁千人,AI削減重複勞動

▪️Meta:5月20日再裁8000人,占員工總數約10%,全年持續縮編

看似是AI迭代淘汰人力,實則另有隱情。

黃仁勛一針見血戳破真相

「靠裁員應對AI的管理者,只是沒有創新能力,拿工具當藉口」

行業共識:AI是漂亮遮羞布,營收壓力才是底層邏輯。多位業界大佬曾就此進行過表態,認為許多以“AI 迭代生產力”為理由進行裁員的公司,其實只是在掩蓋業務前景或營收壓力。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

王傳福怕是要睡不著了:造車,終究是苦力活

最殘忍的新能源真相擺在眼前。

比亞迪全年賣爆460萬輛,淨利潤326億。

寧德時代營收少4000億,淨賺722億。

不是車企給電池廠打工,是商業模式赤裸裸的碾壓。

✅比亞迪:賺辛苦錢

重資產、百萬人力、全產業鏈負重。

車市內卷殺價,單車利潤暴跌三成。

全年砸634億研發,是淨利潤近兩倍。電池、芯片、智駕、整車全自研,每一分利潤都在反哺未來競爭力。

上游材料漲價、下游卷價,兩頭受壓。

✅寧德時代:賺壟斷錢

全球近四成市佔率,手握定價權。

營收微漲,淨利潤暴增42%。

專注電池一條賽道,輕裝上陣吃肉。

寧德時代研發221億,佔營收5.2%。它只專注電池一條賽道,錢花得準、回報高,每1元研發帶動3.8元營收。

更關鍵是定價權。碳酸鋰漲價,寧德能把成本轉嫁給車企;車市降價,比亞迪只能自己扛,利潤被兩頭擠壓。

一個負重拓疆土,一個站塔尖收割。

一個是鋪天蓋地的整車帝國,賺規模與生態的錢;一個是一針捅破天的電池霸主,賺技術與壟斷的錢。

沒有誰對誰錯,只有賽道天差。

查看原文最殘忍的新能源真相擺在眼前。

比亞迪全年賣爆460萬輛,淨利潤326億。

寧德時代營收少4000億,淨賺722億。

不是車企給電池廠打工,是商業模式赤裸裸的碾壓。

✅比亞迪:賺辛苦錢

重資產、百萬人力、全產業鏈負重。

車市內卷殺價,單車利潤暴跌三成。

全年砸634億研發,是淨利潤近兩倍。電池、芯片、智駕、整車全自研,每一分利潤都在反哺未來競爭力。

上游材料漲價、下游卷價,兩頭受壓。

✅寧德時代:賺壟斷錢

全球近四成市佔率,手握定價權。

營收微漲,淨利潤暴增42%。

專注電池一條賽道,輕裝上陣吃肉。

寧德時代研發221億,佔營收5.2%。它只專注電池一條賽道,錢花得準、回報高,每1元研發帶動3.8元營收。

更關鍵是定價權。碳酸鋰漲價,寧德能把成本轉嫁給車企;車市降價,比亞迪只能自己扛,利潤被兩頭擠壓。

一個負重拓疆土,一個站塔尖收割。

一個是鋪天蓋地的整車帝國,賺規模與生態的錢;一個是一針捅破天的電池霸主,賺技術與壟斷的錢。

沒有誰對誰錯,只有賽道天差。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

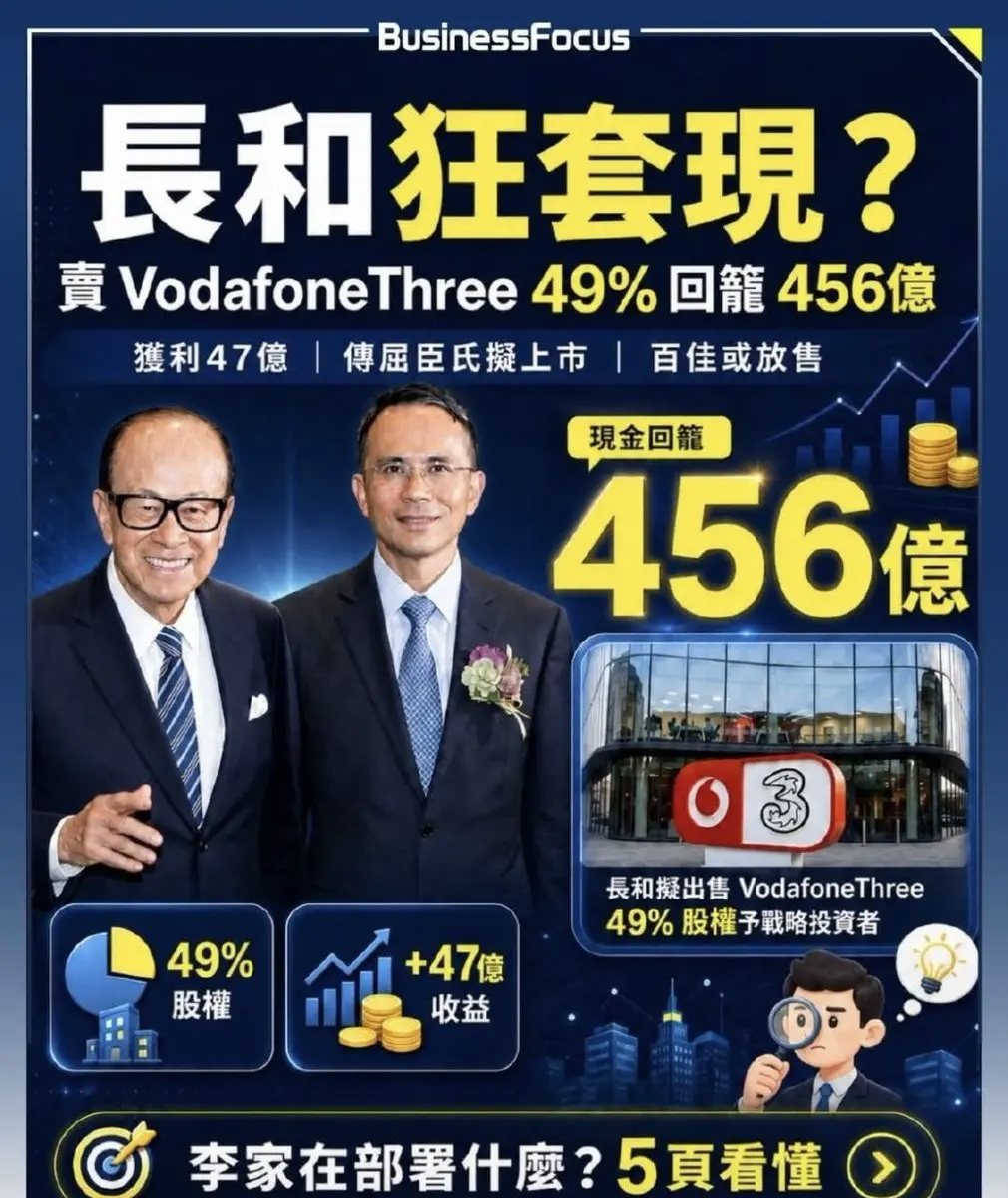

#李嘉誠套現約455億港元

李嘉誠大撤退,超人嗅到了什麼?

李嘉誠開啟賣賣賣模式。

最近李嘉誠密集清倉英國核心資產:電網1100億、電訊455億、鐵路600億,全線高位套現離場。

一邊巴拿馬港口被強制沒收、血本無歸;一邊英國基建順利落袋為安,反差刺眼直白。

為何巴拿馬剛翻車,轉頭清倉英國優質資產?

▫️政策收緊:工黨上台,公用事業行業監管加碼,經營成本飆升

▫️地緣動盪:當前全球博弈加劇,重資產、長周期的海外基建不再安全。香港資本身份敏感,及時切割就是避險。

基礎設施永遠有一個通病:

政治穩定時,是躺賺的現金牛;

局勢動盪時,是最先被拿捏的靶子。

賣掉這些,是因為看到西方國有化回潮。

巴拿馬港口被收,證明了這種擔憂不是杞人憂天。

咱們普通人糾結柴米油鹽,97歲的他早把周期玩明白了。這次賣英國電訊股權,不是心血來潮,是近年撤離歐洲的又一步。又是高位離場,不賺最後一個銅板,這操作太“李嘉誠”了。

世界正從和平與發展轉向衝突與安全

李超人的選擇,是亂世中資本的本能反應:去槓桿,減風險,換現金,等機會。

查看原文李嘉誠大撤退,超人嗅到了什麼?

李嘉誠開啟賣賣賣模式。

最近李嘉誠密集清倉英國核心資產:電網1100億、電訊455億、鐵路600億,全線高位套現離場。

一邊巴拿馬港口被強制沒收、血本無歸;一邊英國基建順利落袋為安,反差刺眼直白。

為何巴拿馬剛翻車,轉頭清倉英國優質資產?

▫️政策收緊:工黨上台,公用事業行業監管加碼,經營成本飆升

▫️地緣動盪:當前全球博弈加劇,重資產、長周期的海外基建不再安全。香港資本身份敏感,及時切割就是避險。

基礎設施永遠有一個通病:

政治穩定時,是躺賺的現金牛;

局勢動盪時,是最先被拿捏的靶子。

賣掉這些,是因為看到西方國有化回潮。

巴拿馬港口被收,證明了這種擔憂不是杞人憂天。

咱們普通人糾結柴米油鹽,97歲的他早把周期玩明白了。這次賣英國電訊股權,不是心血來潮,是近年撤離歐洲的又一步。又是高位離場,不賺最後一個銅板,這操作太“李嘉誠”了。

世界正從和平與發展轉向衝突與安全

李超人的選擇,是亂世中資本的本能反應:去槓桿,減風險,換現金,等機會。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

最近去家附近的五星級溫泉度假酒店,春節漲到4000多一晚,五一也要2500多,但是感覺五一遊客明顯少了很多!

結果數據出來了,五一全國人均消費跌了12%!大家消費開始變得理性了:

800元以上酒店:預訂量直接暴跌35%

200-400元平價民宿/經濟型酒店:訂單暴漲80%

人均200元以上網紅正餐:沒人追捧了

人均30-50元實惠消費:成為主流

如今消費早就拉開了K型差距,趨勢特別明顯:

高端消費集體降溫(住便宜酒店、吃平價飯)

體驗消費在上升(看演出、看比賽)

物質消費在精簡(不買不需要的東西)

說白了,現在的消費真的降級了,消費者都拎得清,拒絕衝動消費,只把錢花在刀刃上!

查看原文結果數據出來了,五一全國人均消費跌了12%!大家消費開始變得理性了:

800元以上酒店:預訂量直接暴跌35%

200-400元平價民宿/經濟型酒店:訂單暴漲80%

人均200元以上網紅正餐:沒人追捧了

人均30-50元實惠消費:成為主流

如今消費早就拉開了K型差距,趨勢特別明顯:

高端消費集體降溫(住便宜酒店、吃平價飯)

體驗消費在上升(看演出、看比賽)

物質消費在精簡(不買不需要的東西)

說白了,現在的消費真的降級了,消費者都拎得清,拒絕衝動消費,只把錢花在刀刃上!

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

孫哥 @sunyuchentron 早年一段錄音裡早就說透了一個道理:

2016年的時候,別著急買房買車,手裡有100萬就拆成五份,分別重倉比特幣、英偉達、特斯拉、騰訊,再配上LC。

拿住不動拿到今天,直接翻到六千七百萬!

英偉達和比特幣早就暴漲一百五十倍,就算五個標的裡,有一個虧掉三成,壓根影響不了大局。

選對了時代大趨勢,中間這點小虧損,壓根就是不值一提的小風浪。

最讓人佩服的是什麼?早在2016年,他就死死認準了人工智能這條主線!想想那是什麼年代啊!

想想2016年那時候,那時候大多數普通人,滿腦子都是湊買房首付、攢錢買車,看不上比特幣,覺得不靠譜;瞧不上特斯拉,只當是個電動玩具;更覺得人工智能離自己十萬八千里,跟普通人遙不可及。

看來,人和人之間的貧富差距,從來都不是辛苦程度拉開的。普通人靠埋頭苦幹賺辛苦血汗錢,厲害的人,從來都是靠超前認知躺賺時代紅利。

2016年的時候,別著急買房買車,手裡有100萬就拆成五份,分別重倉比特幣、英偉達、特斯拉、騰訊,再配上LC。

拿住不動拿到今天,直接翻到六千七百萬!

英偉達和比特幣早就暴漲一百五十倍,就算五個標的裡,有一個虧掉三成,壓根影響不了大局。

選對了時代大趨勢,中間這點小虧損,壓根就是不值一提的小風浪。

最讓人佩服的是什麼?早在2016年,他就死死認準了人工智能這條主線!想想那是什麼年代啊!

想想2016年那時候,那時候大多數普通人,滿腦子都是湊買房首付、攢錢買車,看不上比特幣,覺得不靠譜;瞧不上特斯拉,只當是個電動玩具;更覺得人工智能離自己十萬八千里,跟普通人遙不可及。

看來,人和人之間的貧富差距,從來都不是辛苦程度拉開的。普通人靠埋頭苦幹賺辛苦血汗錢,厲害的人,從來都是靠超前認知躺賺時代紅利。

BTC-0.24%

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

最近試了下 1024EX智能交易平台,有點出乎意料。

一開始我以為 @1024EX也是那種“給你信號、讓你自己操作”的工具,但用下來發現完全不是一回事——

它宛如一直在線的交易代理,直接把 AI 放進了“執行層”。想自己感受一下可以看這裡:

我在 1024EX 主網體驗後的直觀感受是:

以前的交易更像是——你盯信息 → 做判斷 → 手動點單

現在更像是——你表達觀點 → Agent 幫你持續執行

它會一直掃現貨 / 永續 / 預測市場,還有鏈上數據、新聞、情緒

你只需要給一個觀點,甚至一句話,它就能幫你生成策略

然後關鍵點來了:它會在你設定的規則裡直接執行(下單、控倉、止盈止損、套利)

結束後還能看到它是怎麼做判斷、怎麼優化的

如果你還停留在看信號再操作,

其實已經在用上一代方式了。早點上手,你會更清楚差距在哪。

#AD

查看原文一開始我以為 @1024EX也是那種“給你信號、讓你自己操作”的工具,但用下來發現完全不是一回事——

它宛如一直在線的交易代理,直接把 AI 放進了“執行層”。想自己感受一下可以看這裡:

我在 1024EX 主網體驗後的直觀感受是:

以前的交易更像是——你盯信息 → 做判斷 → 手動點單

現在更像是——你表達觀點 → Agent 幫你持續執行

它會一直掃現貨 / 永續 / 預測市場,還有鏈上數據、新聞、情緒

你只需要給一個觀點,甚至一句話,它就能幫你生成策略

然後關鍵點來了:它會在你設定的規則裡直接執行(下單、控倉、止盈止損、套利)

結束後還能看到它是怎麼做判斷、怎麼優化的

如果你還停留在看信號再操作,

其實已經在用上一代方式了。早點上手,你會更清楚差距在哪。

#AD

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

成功有一个很大的要素是:要身体好。

先说司马懿,这辈子赢就赢在活得久。

曹操早就看出他狼顾之相,满心提防,处处压制,可曹操都死了,他没死;曹操的儿子曹丕死了,他还是没死;曹操的孙子曹叡死了,他还是没死。

正面谋略上他赢不了诸葛亮,索性用寿命耗到底,最后硬生生把诸葛亮熬走。

年逾古稀的年纪,依旧杀伐果断,一举扳倒政敌曹爽,手握全部军政大权,直接为司马家建立西晋打下了稳固根基。

再看武则天,更是把好身体的优势发挥到极致。

武则天十几岁就能驯烈马,跟李治生了六胎,还能帮他打理朝政。67岁登基,在D位上干了十几年,直到81岁才去世。

这个年纪,大多数人早就心气耗尽,看淡所有,等着安稳入土,人生再也没有翻身和翻盘的可能,而武则天的另一段旅程才刚刚开始。

成功需要积累。很多人熬不到苦尽甘来,等不到收获成果的那天,身体就先扛不住,早早出局。

先说司马懿,这辈子赢就赢在活得久。

曹操早就看出他狼顾之相,满心提防,处处压制,可曹操都死了,他没死;曹操的儿子曹丕死了,他还是没死;曹操的孙子曹叡死了,他还是没死。

正面谋略上他赢不了诸葛亮,索性用寿命耗到底,最后硬生生把诸葛亮熬走。

年逾古稀的年纪,依旧杀伐果断,一举扳倒政敌曹爽,手握全部军政大权,直接为司马家建立西晋打下了稳固根基。

再看武则天,更是把好身体的优势发挥到极致。

武则天十几岁就能驯烈马,跟李治生了六胎,还能帮他打理朝政。67岁登基,在D位上干了十几年,直到81岁才去世。

这个年纪,大多数人早就心气耗尽,看淡所有,等着安稳入土,人生再也没有翻身和翻盘的可能,而武则天的另一段旅程才刚刚开始。

成功需要积累。很多人熬不到苦尽甘来,等不到收获成果的那天,身体就先扛不住,早早出局。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

這就是赤裸裸的差距!

2025自主車企單車淨利排行

1. 赛力斯:51.7萬台、淨利59.5億、單車11508元(毛利率28.8%)

2. 長城:132.4萬台、淨利98.6億、單車7447元

3. 比亞迪:460.2萬台、淨利326億、單車7083元

4. 奇瑞:280.6萬台、淨利195億、單車6949元

5. 吉利:302.5萬台、淨利168.5億、單車5570元

6. 理想:40.63萬台、淨利11.24億、單車2766元

7. 小米:41.1萬台、淨利9億、單車2189元

8. 長安:291.3萬台、淨利40.7億、單車1397元

9. 零跑:59.6萬台、淨利5.4億、單車906元

行業共性:增收不增利,價格戰白熱化

• 特斯拉:2024年淨利71億美元,2025年約38億美元,近乎腰斬

• 論國內新能源汽車總利潤:比亞迪斷層第一(326億)

• 論單車賺錢:

賽力斯用“華為+高端”跑出了中國品牌的利潤天花板(11508元)

• 行業真相:

整個行業都在價格戰裡內卷。

國內:比亞迪、長城、吉利、理想等全員降價/變相降價(零利息、低息、送保險等),本質是隱形價格戰,利潤被持續擠壓。

• 行業真相:

高端化(賽力斯問界)才是利潤解藥,性價比路線(比亞迪、長安、零跑)規模再大也難賺厚利。

查看原文2025自主車企單車淨利排行

1. 赛力斯:51.7萬台、淨利59.5億、單車11508元(毛利率28.8%)

2. 長城:132.4萬台、淨利98.6億、單車7447元

3. 比亞迪:460.2萬台、淨利326億、單車7083元

4. 奇瑞:280.6萬台、淨利195億、單車6949元

5. 吉利:302.5萬台、淨利168.5億、單車5570元

6. 理想:40.63萬台、淨利11.24億、單車2766元

7. 小米:41.1萬台、淨利9億、單車2189元

8. 長安:291.3萬台、淨利40.7億、單車1397元

9. 零跑:59.6萬台、淨利5.4億、單車906元

行業共性:增收不增利,價格戰白熱化

• 特斯拉:2024年淨利71億美元,2025年約38億美元,近乎腰斬

• 論國內新能源汽車總利潤:比亞迪斷層第一(326億)

• 論單車賺錢:

賽力斯用“華為+高端”跑出了中國品牌的利潤天花板(11508元)

• 行業真相:

整個行業都在價格戰裡內卷。

國內:比亞迪、長城、吉利、理想等全員降價/變相降價(零利息、低息、送保險等),本質是隱形價格戰,利潤被持續擠壓。

• 行業真相:

高端化(賽力斯問界)才是利潤解藥,性價比路線(比亞迪、長安、零跑)規模再大也難賺厚利。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

AI接單成本直接砍17倍!普通人現在入局剛好趕上風口

GitHub最近有個開源項目叫DeepClaude,可以把Claude Code的AI後端切換成DeepSeek V4 Pro。

換完之後成本直接斷崖式下跌,原本一百萬token要花15美元,現在只需要0.87美元,成本直接壓低整整17倍。

而且實測下來實力幾乎沒差,拿編程標準跑分測試,DeepSeek拿到80.6%,原版Anthropic是80.8%,差距基本可以忽略不計。

靠AI接開發接單賺錢的朋友,這下入門門檻直接被狠狠拉低了。

超簡單三步就能搞定配置,全程不用寫一行代碼:

1. GitHub搜DeepClaude,進入項目主頁,跟著自帶的教程一步步安裝設置就行

2. 去DeepSeek官網註冊帳號,申領專屬API Key,按需充值就可以,沒有任何月租套路

3. 本地修改一下代理地址,Claude Code就會自動調用DeepSeek後端,原有所有功能全都照常使用

整個流程不需要寫新代碼,只是改配置。

不過要注意:DeepSeek和Anthropic在某些邊緣任務上有細微差異,建議根據自己的實際使用場景測試後再決定是否長期切換。

工具成本每降低一次,就會湧現一批新的入局者賺到錢。阻礙你的,可能不是工具貴,是還沒有動手

查看原文GitHub最近有個開源項目叫DeepClaude,可以把Claude Code的AI後端切換成DeepSeek V4 Pro。

換完之後成本直接斷崖式下跌,原本一百萬token要花15美元,現在只需要0.87美元,成本直接壓低整整17倍。

而且實測下來實力幾乎沒差,拿編程標準跑分測試,DeepSeek拿到80.6%,原版Anthropic是80.8%,差距基本可以忽略不計。

靠AI接開發接單賺錢的朋友,這下入門門檻直接被狠狠拉低了。

超簡單三步就能搞定配置,全程不用寫一行代碼:

1. GitHub搜DeepClaude,進入項目主頁,跟著自帶的教程一步步安裝設置就行

2. 去DeepSeek官網註冊帳號,申領專屬API Key,按需充值就可以,沒有任何月租套路

3. 本地修改一下代理地址,Claude Code就會自動調用DeepSeek後端,原有所有功能全都照常使用

整個流程不需要寫新代碼,只是改配置。

不過要注意:DeepSeek和Anthropic在某些邊緣任務上有細微差異,建議根據自己的實際使用場景測試後再決定是否長期切換。

工具成本每降低一次,就會湧現一批新的入局者賺到錢。阻礙你的,可能不是工具貴,是還沒有動手

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

難怪法拉利總裁會對她念念不忘...朱珠真的太有女人味了

查看原文

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

難怪法拉利總裁會對她念念不忘...朱竹真的太有女人味了

查看原文

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

現在短視頻裡最魔幻的一波人:

一個在任何行業裡都沒賺過錢的人,

在教一群極其渴望賺錢的人,

怎麼通過“教別人賺錢”來賺錢

查看原文一個在任何行業裡都沒賺過錢的人,

在教一群極其渴望賺錢的人,

怎麼通過“教別人賺錢”來賺錢

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

都以为浪姐李小冉、王濛、唐艺昕这局,是背后哪个老板撮合的?

查到底才发现,这事比想象的干净,也比想象的现实。

先扒扒三个人各自的处境就懂了。

一人想顺利复出,一人谋求行业转型,还有一人急需跨界出圈稳住事业基本盘。

李小冉,资深演员,自己工作室说了算。

唐艺昕,产后复出关键期,急需一个翻身仗。

两人在节目之前,她和李小冉从来没有过任何合作交集。

最关键的是王濛。

本就不属于娱乐圈体系,手里经营着体育公司,自身还有不少麻烦事。名下湾道体育四百多万股权,早在2023年7月就已经被冻结。

这下就能看清了,哪有什么高深莫测的资本布局?三个人的抱团,不是因为背后站着同一个金主,而是因为前面是同一片窄路。

查到底才发现,这事比想象的干净,也比想象的现实。

先扒扒三个人各自的处境就懂了。

一人想顺利复出,一人谋求行业转型,还有一人急需跨界出圈稳住事业基本盘。

李小冉,资深演员,自己工作室说了算。

唐艺昕,产后复出关键期,急需一个翻身仗。

两人在节目之前,她和李小冉从来没有过任何合作交集。

最关键的是王濛。

本就不属于娱乐圈体系,手里经营着体育公司,自身还有不少麻烦事。名下湾道体育四百多万股权,早在2023年7月就已经被冻结。

这下就能看清了,哪有什么高深莫测的资本布局?三个人的抱团,不是因为背后站着同一个金主,而是因为前面是同一片窄路。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

#國乒男團1比3韓國

國兵男隊1:3輸給韓國,雖說勝敗乃兵家常事,但飯圈文化盛行之後國兵明顯在走下坡路了,老兵退役後這梯建設沒跟上,後面沒人頂上來呀

國乒現在的問題,你把樊振東召回來也是治標不治本!

說實話樊振東現在還處在生涯巔峰,可等到下一屆奧運會,他都35歲了,競技狀態必然大打折扣。

所以現在讓樊振東回來,他和王楚欽,對於中國隊而言,在這個奧運周期,單打和團體賽確實是雙重保險。

但國乒真正的隱患擺在這:接下來兩三年要是冒不出天賦炸裂的新生代小將,往後幾年人才斷層的窘境只會越來越嚴重。

再說林詩棟,國乒給他的機會夠多了。哪有憑空掉下來的核心資源?都是靠自己打出實力硬拼來的。就他現在這樣,關鍵比賽總習慣性拉胯、扛不住壓力的表現,他也不配更多的資源傾斜啊

查看原文國兵男隊1:3輸給韓國,雖說勝敗乃兵家常事,但飯圈文化盛行之後國兵明顯在走下坡路了,老兵退役後這梯建設沒跟上,後面沒人頂上來呀

國乒現在的問題,你把樊振東召回來也是治標不治本!

說實話樊振東現在還處在生涯巔峰,可等到下一屆奧運會,他都35歲了,競技狀態必然大打折扣。

所以現在讓樊振東回來,他和王楚欽,對於中國隊而言,在這個奧運周期,單打和團體賽確實是雙重保險。

但國乒真正的隱患擺在這:接下來兩三年要是冒不出天賦炸裂的新生代小將,往後幾年人才斷層的窘境只會越來越嚴重。

再說林詩棟,國乒給他的機會夠多了。哪有憑空掉下來的核心資源?都是靠自己打出實力硬拼來的。就他現在這樣,關鍵比賽總習慣性拉胯、扛不住壓力的表現,他也不配更多的資源傾斜啊

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

#嚴軍曬與嚴浩翔聊天記錄

聊天記錄看得我好累,全是說教和PUA毫無父愛只剩算計,實在讓人寒心

直白扒一扒這段聊天記錄:

1、產後一年渣男老公就和嚴浩翔母親宣布感情破裂!和前妻離婚時,嘴上承諾給300萬外加兩套房產,結果到頭來只兌現了100萬。剩下的欠款和房子一概不提,後續每年轉給前妻的錢,还美其名曰是拖欠款項的利息。

2、當初開口向嚴浩翔借走三百多萬拿去投資,失敗了,兒子沒問他要三百多萬,他還問兒子要上千萬。

3、把現任妻子和小女兒安置在國外安逸生活,獨自回國喊著還債,还冠上保全兒子名聲的名頭。說白了就是打定主意道德綁架,逼著兒子替自己償還債務,甚至還要讓嚴浩翔,承擔起撫養同父異母妹妹的責任。

4、整個聊天記錄看不到對浩翔的愛,只有對現任老婆和小女兒的愛和維護。

查看原文聊天記錄看得我好累,全是說教和PUA毫無父愛只剩算計,實在讓人寒心

直白扒一扒這段聊天記錄:

1、產後一年渣男老公就和嚴浩翔母親宣布感情破裂!和前妻離婚時,嘴上承諾給300萬外加兩套房產,結果到頭來只兌現了100萬。剩下的欠款和房子一概不提,後續每年轉給前妻的錢,还美其名曰是拖欠款項的利息。

2、當初開口向嚴浩翔借走三百多萬拿去投資,失敗了,兒子沒問他要三百多萬,他還問兒子要上千萬。

3、把現任妻子和小女兒安置在國外安逸生活,獨自回國喊著還債,还冠上保全兒子名聲的名頭。說白了就是打定主意道德綁架,逼著兒子替自己償還債務,甚至還要讓嚴浩翔,承擔起撫養同父異母妹妹的責任。

4、整個聊天記錄看不到對浩翔的愛,只有對現任老婆和小女兒的愛和維護。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

王晶導演看人眼光是真夠毒辣的。

他說陳冠希人家哪是退出娛樂圈啊,明明是提前上岸抽身跑路。現在的陳冠希,早就看不上內娛這點蠅頭小利了。。

陳冠希的CLOT潮流品牌,早幾年年收入就破千萬美元了。

放到現在來看,品牌估值直奔十個億,每年穩穩入帳幾千萬利潤,純純的現金奶牛,躺著賺錢。

看看他合作的都是什么大牌?阿迪、耐克、拉夫勞倫,全都主動找上門求合作。

去年全球時尚IP排行榜,CLOT直接拿下中國區榜首,把圈內一眾明星創辦的潮牌,遠遠甩在了身後。

說到底,內娛還在爭名奪利、互相內卷,人家早就跳出圈層,靠著自己的實力賺得盆滿缽滿。不必迎合世俗眼光,不靠流量博取熱度,陳冠希這波,才是真正的人生贏家。

查看原文他說陳冠希人家哪是退出娛樂圈啊,明明是提前上岸抽身跑路。現在的陳冠希,早就看不上內娛這點蠅頭小利了。。

陳冠希的CLOT潮流品牌,早幾年年收入就破千萬美元了。

放到現在來看,品牌估值直奔十個億,每年穩穩入帳幾千萬利潤,純純的現金奶牛,躺著賺錢。

看看他合作的都是什么大牌?阿迪、耐克、拉夫勞倫,全都主動找上門求合作。

去年全球時尚IP排行榜,CLOT直接拿下中國區榜首,把圈內一眾明星創辦的潮牌,遠遠甩在了身後。

說到底,內娛還在爭名奪利、互相內卷,人家早就跳出圈層,靠著自己的實力賺得盆滿缽滿。不必迎合世俗眼光,不靠流量博取熱度,陳冠希這波,才是真正的人生贏家。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

這就是渣男的天花板嗎?這幾天明星家庭的千萬贍養風波鬧上熱搜。

不敢想,04年8月嚴浩翔母親剛生完浩翔,那麼難,大出血,05年這男的說“十年感受不到你愛我”PUA周瓊女士,而他自己跑去跟小三一起同居,甚至在離婚前小三孩子都好幾歲了

周女士在丈夫出軌pua後拿著微薄的工資,獨自拉扯教育出一對極為優秀的兒女

——周女士牛逼

嚴浩翔看到了母親的艱難,頂著各種壓力和質疑,為母親分擔,十多歲就開始賺錢養家

——嚴浩翔牛逼

產後一年渣男老公就和其母親宣布感情破裂!嚴浩翔給了嚴軍300萬並承諾贍養他以及支助同父異母的妹妹上學。

嚴軍欠的債務是他跟現在的老婆投資欠的,所以周瓊反對!但嚴浩翔還是堅持給嚴軍,但嚴軍張口想要一千萬,這一千萬不給就要斷親嗎?

親情該是港灣,不是無底洞。

查看原文不敢想,04年8月嚴浩翔母親剛生完浩翔,那麼難,大出血,05年這男的說“十年感受不到你愛我”PUA周瓊女士,而他自己跑去跟小三一起同居,甚至在離婚前小三孩子都好幾歲了

周女士在丈夫出軌pua後拿著微薄的工資,獨自拉扯教育出一對極為優秀的兒女

——周女士牛逼

嚴浩翔看到了母親的艱難,頂著各種壓力和質疑,為母親分擔,十多歲就開始賺錢養家

——嚴浩翔牛逼

產後一年渣男老公就和其母親宣布感情破裂!嚴浩翔給了嚴軍300萬並承諾贍養他以及支助同父異母的妹妹上學。

嚴軍欠的債務是他跟現在的老婆投資欠的,所以周瓊反對!但嚴浩翔還是堅持給嚴軍,但嚴軍張口想要一千萬,這一千萬不給就要斷親嗎?

親情該是港灣,不是無底洞。

- 打賞

- 按讚

- 回覆

- 轉發

- 分享

@A9lansir 堅持每天簽到任務

查看原文- 打賞

- 按讚

- 回覆

- 轉發

- 分享

熱門話題

查看更多50.59萬 熱度

10630.03萬 熱度

327.74萬 熱度

141.9萬 熱度

83.36萬 熱度

置頂

🏆 WCTC S8 風雲熱議:曬戰績,贏豪禮

廣場發帖即參與,WCTC 限量定制周邊、GT、卡券等您拿!

🎁 四大獎勵賽道:

1️⃣ 組隊禮: 一鍵分享組隊,抽 100 人送 50U 體驗券。

2️⃣ 大神禮: 寫攻略,贏 20U GT + 官方置頂。

3️⃣ 戰神禮: 晒個人 PK 戰績截圖,送 WCTC 紀念 T 恤。

4️⃣ 領頭羊: 晒團隊戰績,熱度前 10 贏全場流量推廣。

👉 帶話題 #WCTC交易王PK 發帖,鎖定你的專屬獎勵!

🔗 https://www.gate.com/competition/wctc-s8

詳情:https://www.gate.com/announcements/article/5090710,000 USDT 悬赏,寻找Gate广场跟单金牌星探!🕵️♀️

挖掘顶级带单员,赢取高额跟单体验金!

立即参与:https://www.gate.com/campaigns/4624

🎁 三大活动,奖金叠满:

1️⃣ 慧眼识英:发帖推荐带单员,分享跟单体验,抽 100 位送 30 USDT!

2️⃣ 强力应援:晒出你的跟单截图,为大神打 Call,抽 120 位送 50 USDT!

3️⃣ 社交达人:同步至 X/Twitter,凭流量赢取 100 USDT!

📍 标签: #跟单金牌星探 #GateCopyTrading

⏰ 限时: 4/22 16:00 - 5/10 16:00 (UTC+8)

详情:https://www.gate.com/announcements/article/50848#Gate广场五月交易分享 狂歡開啟,五一紅包狂撒!🧧

發帖聊行情,紅包天天領,新人100%中獎!

🎁 福利亮點:

✅ 新人禮: 發布廣場首帖,100% 必中紅包!

✅ 發帖獎: 發帖越多,互動越多,紅包金額越大!

✅ 衝榜單: Top 100 都有獎,Gate X RedBull 積木賽車禮盒、速乾運動套裝等您拿!

立即行動,發布你的五月廣場第一帖!

👉️ https://www.gate.com/post

🗓 截止日期: 5 月 15 日

詳情:https://www.gate.com/announcements/article/50981

#BTC #ETH #GT📢 Gate 廣場|5/6 Polymarket 每日熱點預測

🎁 參與即有機會贏!隨機抽取 5 位幸運用戶,每人送 $5 代幣

📝 參與方式:

1️⃣ 參與 Polymarket 預測投票並在評論區留言

2️⃣ 帶 #Polymarket每日热点 發帖,分享您的判斷邏輯與押注策略

👇 點擊下方 Polymarket 卡片,立即參與預測

發帖掛載 Polymarket 卡片需將 App 更新至 8.17.0 及以上版本

詳情:https://gate.onelink.me/Hls0/prediction?page=detail&event_ticker=415443&source=cex