Los tres momentos de Anthropic: filtración de código, enfrentamiento con el gobierno y militarización

Título original: Anthropic: The Leak, The War, The Weapon

Autor original: BuBBliK

Compilación: Peggy,BlockBeats

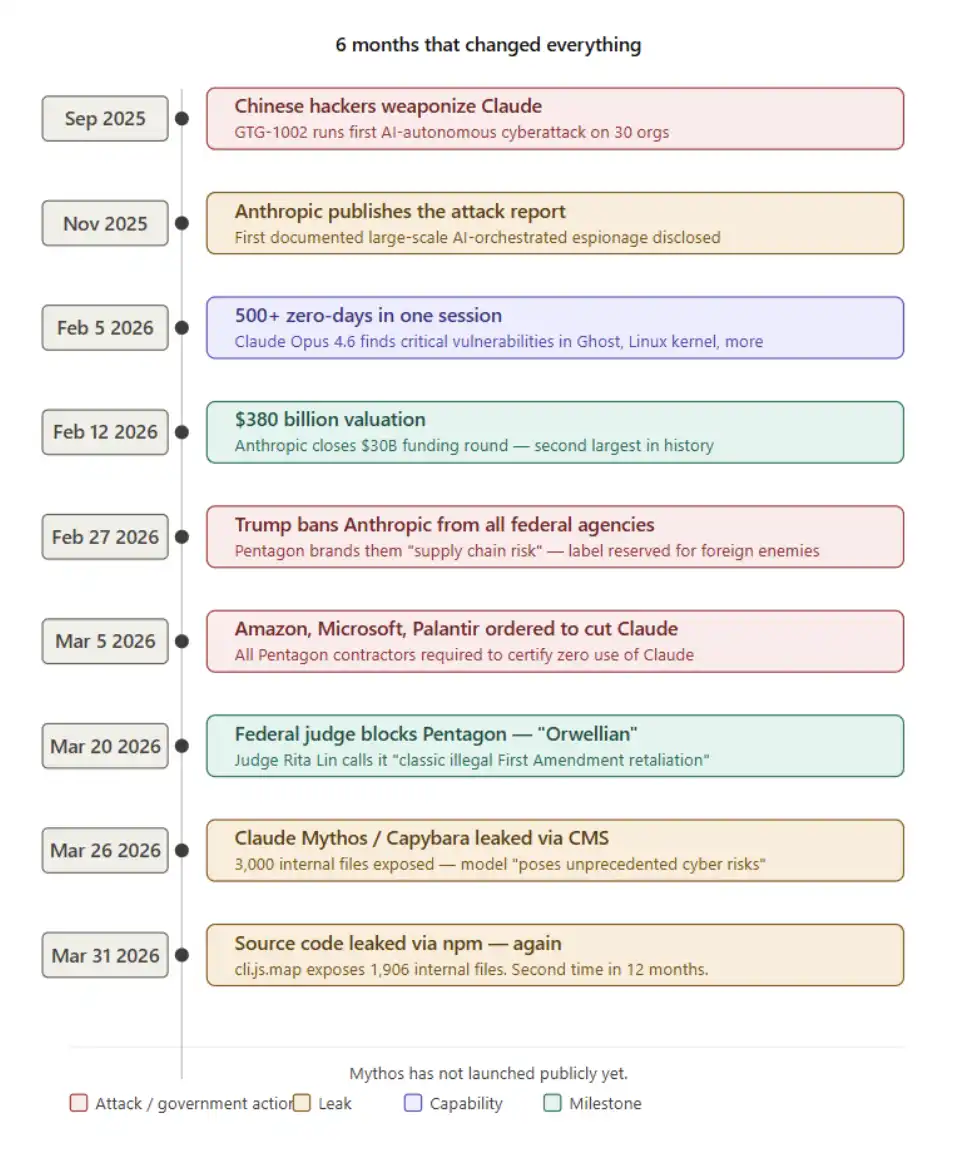

Nota del editor: En los últimos seis meses, Anthropic se ha visto envuelta en una serie de hechos que parecen independientes entre sí, pero que en realidad apuntan en la misma dirección: el salto en las capacidades de sus modelos, los ataques automatizados en el mundo real, la fuerte reacción del mercado de capitales, los conflictos públicos con el gobierno y, además, varias filtraciones de información causadas por errores en la configuración base. Al poner estas pistas juntas, dibujan un rumbo de cambio más claro.

Este artículo utiliza estos acontecimientos como punto de partida para repasar la trayectoria continua de una empresa de IA en sus avances tecnológicos, en la exposición al riesgo y en la pugna por la gobernanza, e intenta responder una pregunta más profunda: cuando la capacidad de “descubrir vulnerabilidades” se amplifica enormemente y se va expandiendo de forma progresiva, ¿puede aún mantener la ciberseguridad su lógica operativa original como sistema en sí?

Antes, la seguridad se sustentaba en la escasez de capacidades y en las limitaciones de personal; pero en las nuevas condiciones, el ataque y la defensa están girando en torno a la misma capacidad de modelo, y los límites se vuelven cada vez más difusos. Al mismo tiempo, la respuesta de las instituciones, el mercado y las organizaciones sigue anclada en marcos antiguos, incapaz de asumir a tiempo este tipo de cambio.

Lo que esta historia examina no es solo a Anthropic en sí, sino una realidad más amplia que se refleja a través de ella: la IA no solo está cambiando herramientas, sino que también está cambiando los supuestos sobre cómo se “constituye” la seguridad.

A continuación, el original:

¿Qué ocurre cuando una empresa valuada en 380 mil millones de dólares se enfrasca en una disputa con el Pentágono y, además, sale victoriosa; sobrevive al primer ciberataque de la historia iniciado por una IA autónoma; y luego, dentro de la organización, filtra un modelo que incluso a sus propios desarrolladores les da miedo; e incluso, de forma “accidental”, publica el código fuente completo?

La respuesta es, justamente, lo que vemos ahora. Y lo que resulta aún más inquietante es que quizá la parte realmente peligrosa todavía no ha ocurrido.

Recapitulación de los acontecimientos

Anthropic vuelve a filtrar su código

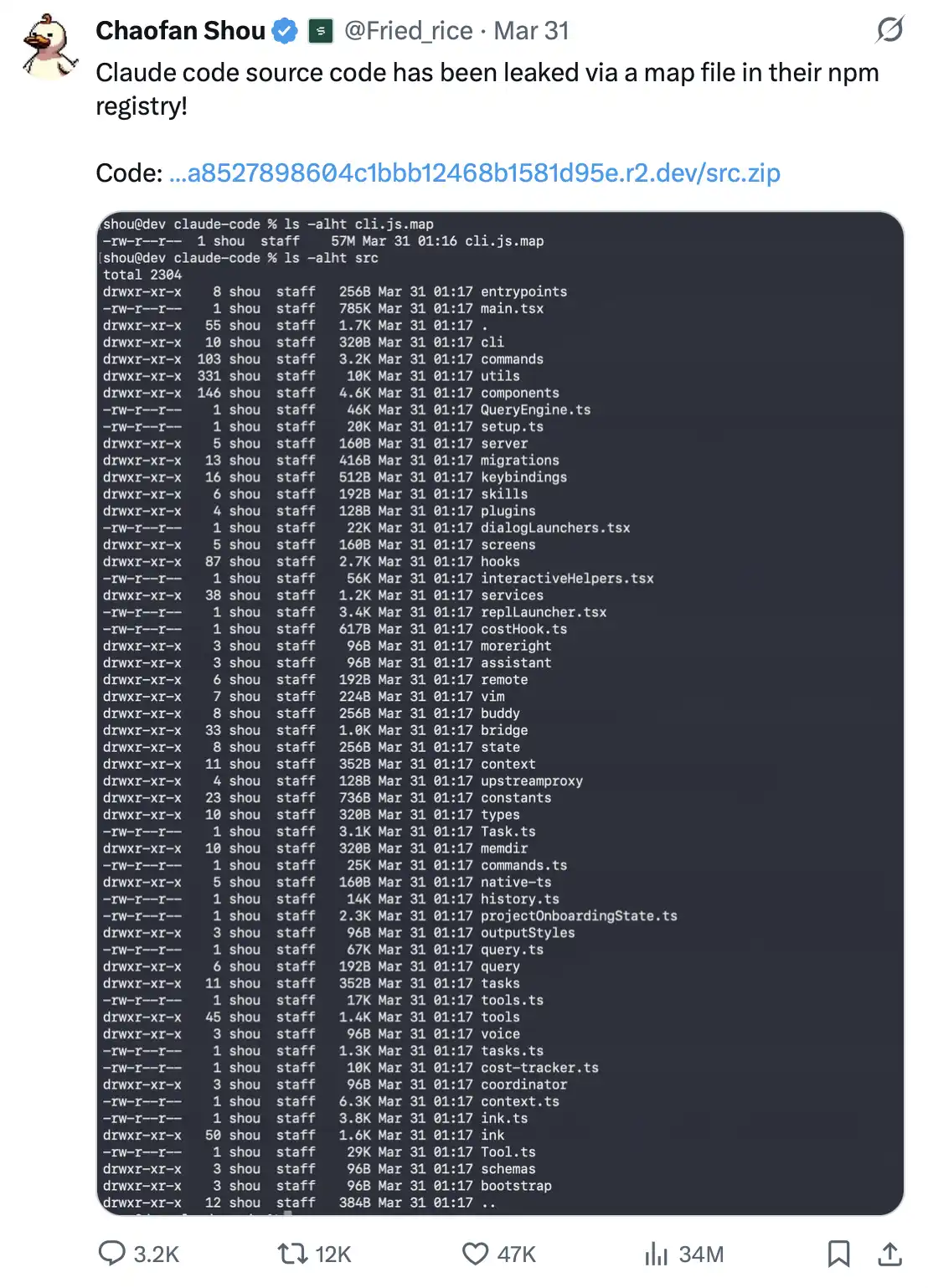

El 31 de marzo de 2026, el investigador de seguridad Shou Chaofan, de la empresa blockchain Fuzzland, al revisar el paquete oficial npm de Claude Code, encontró que incluía, nada menos, un archivo llamado cli.js.map en texto plano.

Ese archivo alcanza un tamaño de 60MB, y su contenido es aún más sorprendente. Casi contiene el código fuente TypeScript completo del producto. Con solo ese archivo, cualquiera puede reconstruir hasta 1906 archivos internos de código fuente: incluido el diseño de APIs internas, el sistema de telemetría, herramientas de cifrado, lógica de seguridad, el sistema de plugins: prácticamente todos los componentes centrales quedan a la vista. Y lo más importante es que incluso esos contenidos pueden descargarse directamente desde el bucket de almacenamiento R2 de Anthropic en formato zip.

Este hallazgo se difundió rápidamente en las redes sociales: en pocas horas, las publicaciones relacionadas alcanzaron 754 mil visualizaciones y casi 1000 reenvíos; al mismo tiempo, se crearon de inmediato varios repositorios de GitHub donde se recreó el código fuente y se publicaron.

Lo que se llama source map (archivo de mapeo de origen), en esencia, es un archivo auxiliar para depuración de JavaScript; su función es revertir el código comprimido y compilado de nuevo al código fuente original, para facilitar que los desarrolladores rastreen problemas.

Pero existe un principio básico: nunca debería incluirse en el paquete de distribución de un entorno de producción.

No se trata de un método de ataque sofisticado, sino de un problema de normas de ingeniería en su nivel más básico, “construcción configuración 101”, incluso algo que los desarrolladores aprenden en su primera semana. Si se empaqueta por error en el entorno de producción, el source map a menudo equivale a regalar el código fuente a todos.

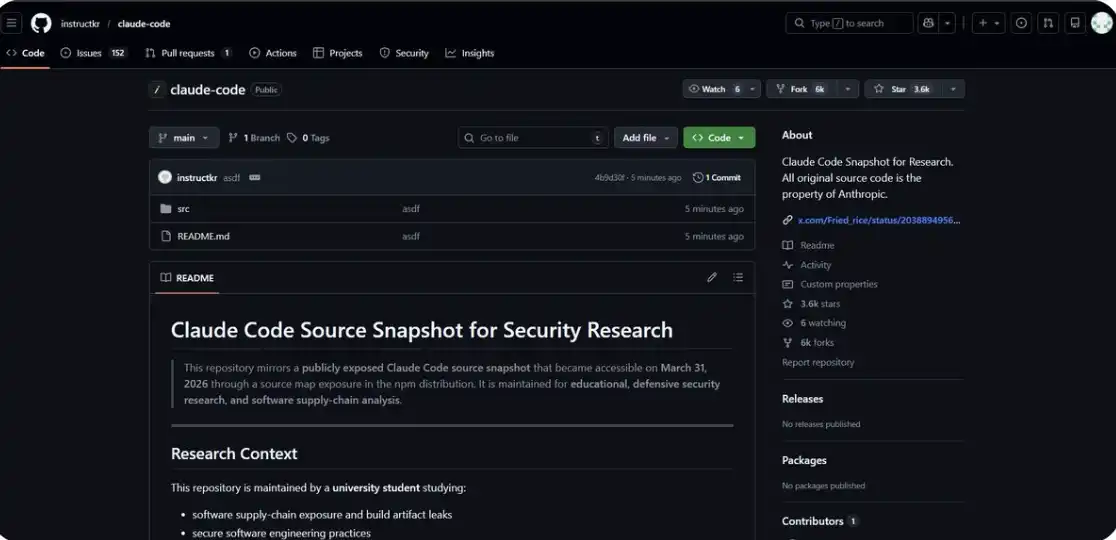

También puedes ver directamente el código relacionado aquí: https://github.com/instructkr/claude-code

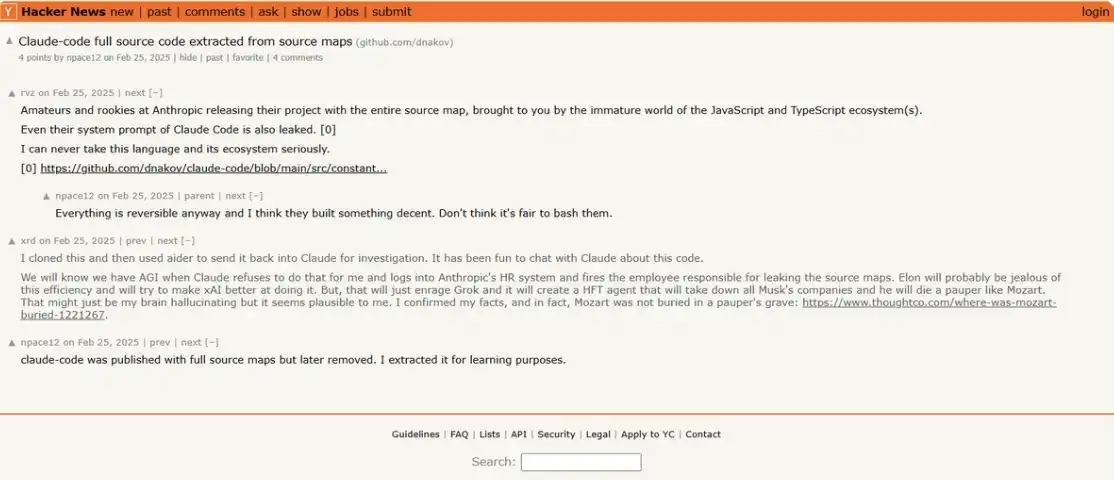

Pero lo verdaderamente absurdo es que este asunto ya sucedió una vez.

En febrero de 2025, justo un año atrás, ocurrió una filtración casi idéntica: el mismo archivo, el mismo tipo de error. En aquella ocasión, Anthropic eliminó la versión antigua de npm, retiró el source map y volvió a publicar una versión nueva; con eso, el asunto se calmó.

Sin embargo, en la versión v2.1.88, ese archivo volvió a empaquetarse y publicarse.

Una empresa valuada en 380 mil millones de dólares, que está construyendo el sistema de detección de vulnerabilidades más avanzado del mundo, cometió el mismo error básico dos veces en un año. No hubo un ataque de hackers, ni una ruta de explotación compleja; solo un error en un proceso de construcción que debería funcionar correctamente.

Esta ironía casi tiene cierto aire “poético”.

Esa IA que puede descubrir 500 vulnerabilidades zero-day en una sola ejecución; ese modelo que se usó para lanzar ataques automatizados contra 30 organizaciones globales; y, mientras tanto, Anthropic entrega “de regalo” su propio código fuente, directamente empaquetado, a cualquier persona dispuesta a echar un vistazo al paquete npm.

Dos filtraciones, con apenas siete días de diferencia.

Y la causa es prácticamente la misma: un error de configuración en el nivel más básico. No requiere ningún umbral técnico, ni una ruta de explotación compleja. Solo necesitas saber dónde mirar y cualquiera puede obtenerlo gratis.

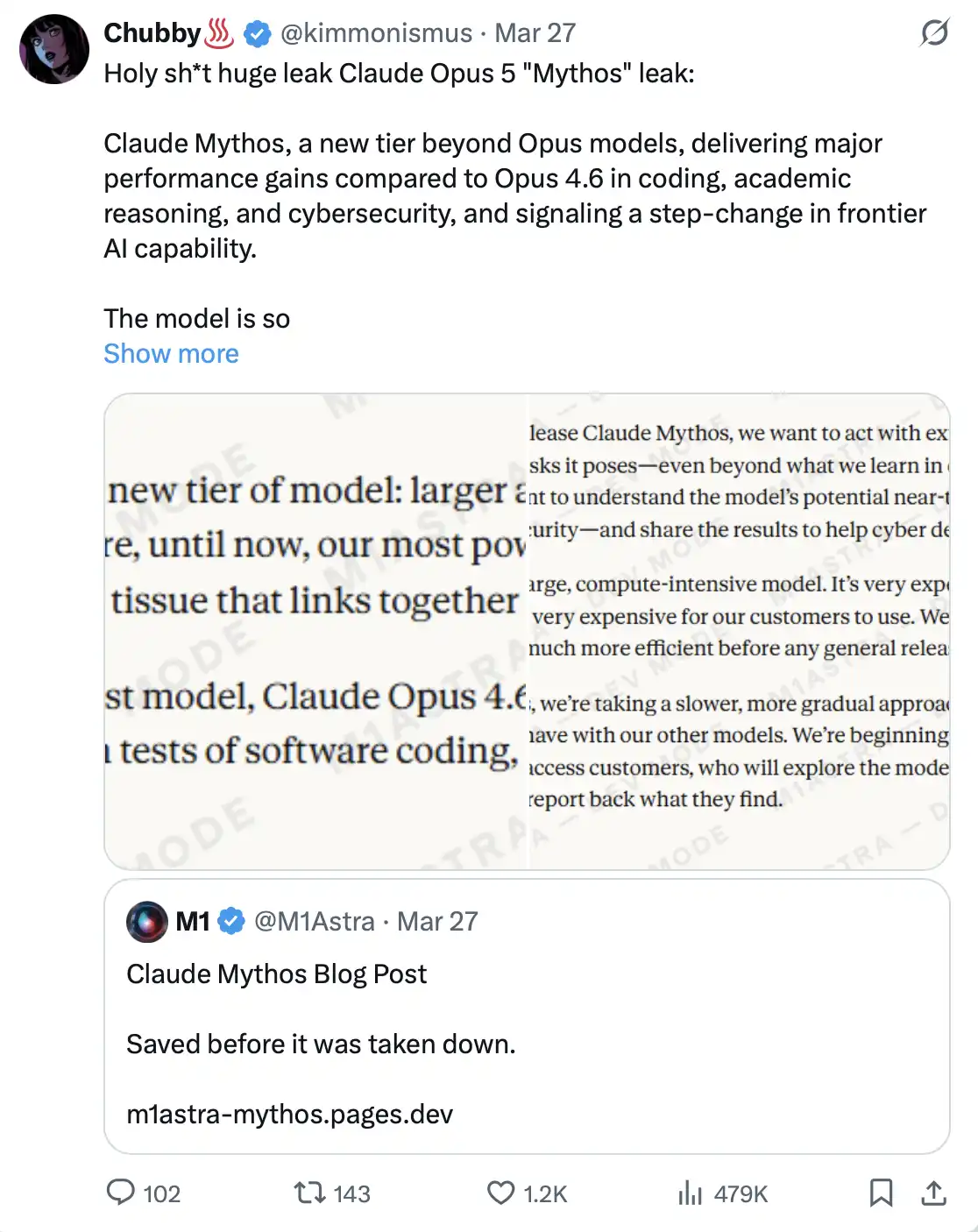

Hace una semana: exposición accidental del “modelo peligroso” interno

El 26 de marzo de 2026, los investigadores de seguridad Roy Paz, de LayerX Security, y Alexandre Pauwels, de la University of Cambridge, descubrieron que la configuración del CMS del sitio web oficial de Anthropic presentaba un problema, lo que condujo a que unos 3000 documentos internos quedaran accesibles públicamente.

Estos archivos incluyen: borradores de blogs, PDF, documentos internos y materiales de presentación: todo quedó expuesto en un repositorio de datos sin protección y que podía buscarse. No hubo ataque de hackers y tampoco hizo falta ninguna técnica.

Entre esos archivos, había dos borradores de blog casi idénticos, con la única diferencia del nombre del modelo: uno decía “Mythos” y el otro “Capybara”.

Esto significa que, en aquel momento, Anthropic estaba eligiendo entre dos nombres para el mismo proyecto secreto. La empresa confirmó posteriormente que el entrenamiento de ese modelo ya había finalizado y que había comenzado a probarse con algunos clientes iniciales.

No se trataba de una actualización regular de Opus, sino de un modelo completamente nuevo de “nivel 4”, con un posicionamiento incluso superior al de Opus.

En los propios borradores de Anthropic, se describía así: “Más grande, más inteligente que nuestro modelo Opus—y Opus sigue siendo, hasta ahora, nuestro modelo más potente”. En capacidad de programación, razonamiento académico y ciberseguridad, entre otros, logró avances significativos. Un portavoz lo calificó como “un salto cualitativo”, y también como “el modelo más fuerte que hemos construido hasta ahora”.

Pero lo que realmente merece atención no está en esas descripciones de rendimiento.

En los borradores filtrados, la evaluación de Anthropic sobre este modelo es que “trae riesgos de ciberseguridad sin precedentes”, que “supera a cualquier otro modelo de IA en capacidades de red”, y que “anticipa una próxima ola de modelos—y su capacidad para explotar vulnerabilidades superará con creces la velocidad de respuesta de los defensores”.

Dicho de otra manera, en un borrador de blog oficial aún no publicado, Anthropic ya expresó de forma clara una postura rara: les preocupa el producto que están construyendo.

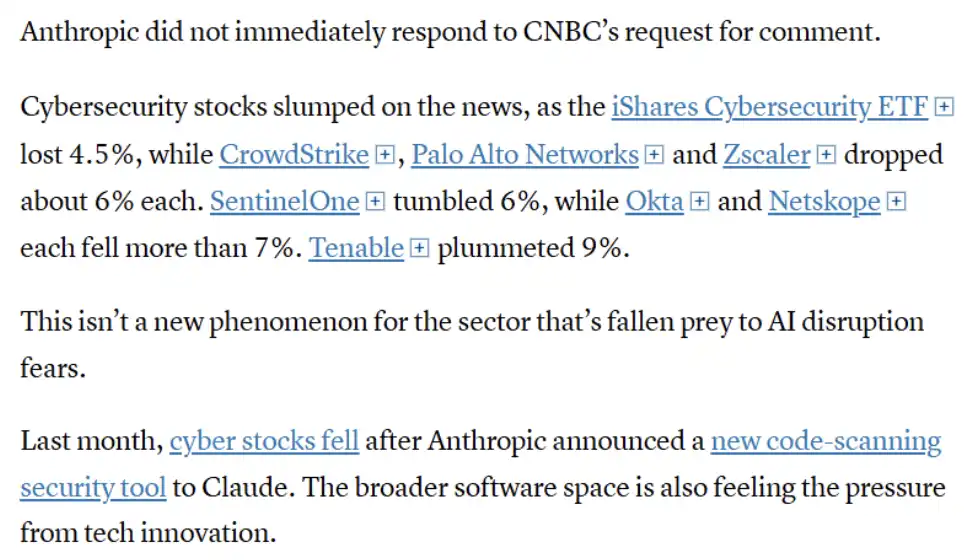

La reacción del mercado fue casi inmediata. La acción de CrowdStrike cayó 7%, Palo Alto Networks cayó 6% y Zscaler cayó 4.5%; Okta y SentinelOne cayeron ambos más de 7%, y Tenable se desplomó 9%. El iShares Cybersecurity ETF cayó 4.5% ese mismo día. Solo en el caso de CrowdStrike, ese día su capitalización bursátil se evaporó en aproximadamente 15 mil millones de dólares. Mientras tanto, Bitcoin retrocedió hasta 66,000 dólares.

El mercado, evidentemente, interpretó este caso como un “veredicto” para toda la industria de la ciberseguridad.

Idea general del gráfico: Bajo la influencia de las noticias relacionadas, todo el sector de ciberseguridad cayó; varias empresas líderes (como CrowdStrike, Palo Alto Networks, Zscaler, etc.) registraron caídas notables, reflejando la preocupación del mercado por el impacto de la IA en la industria de la ciberseguridad. Pero esta reacción no es la primera vez que ocurre. Antes, cuando Anthropic publicó una herramienta de escaneo de código, las acciones relacionadas también cayeron, lo que demuestra que el mercado ya está empezando a ver la IA como una amenaza estructural para los proveedores de seguridad tradicionales, y que toda la industria de software soporta presiones similares.

La valoración del analista de Stifel Adam Borg fue bastante directa: el modelo “tiene el potencial de convertirse en la herramienta de hackeo definitiva, e incluso puede elevar al hacker promedio a un oponente con capacidad de ataque de nivel estatal”.

Entonces, ¿por qué aún no se ha publicado? La explicación de Anthropic es que el costo de funcionamiento de Mythos “es muy alto” y que todavía no cumple las condiciones para un lanzamiento al público. El plan actual es primero habilitar el acceso temprano a una pequeña parte de socios de ciberseguridad para fortalecer el sistema defensivo; luego, ampliar gradualmente el alcance de apertura de la API. Antes de eso, la empresa sigue optimizando la eficiencia.

Pero lo clave es que el modelo ya existe, ya está en pruebas y, incluso solo por el “accidental” hecho de que quedó expuesto, ya causó un impacto en todo el mercado de capitales.

Anthropic está construyendo un modelo de IA al que llama “el de mayor riesgo de ciberseguridad de la historia”. Y, precisamente, la filtración de su noticia provino de un error de configuración de infraestructura de la forma más básica, que justamente es el tipo de error que este tipo de modelo se supone que está diseñado para descubrir.

Marzo de 2026: enfrentamiento de Anthropic con el Pentágono y victoria

En julio de 2025, Anthropic firmó un contrato de 200 millones de dólares con el Departamento de Defensa de Estados Unidos. Al principio pareció solo una colaboración rutinaria. Pero durante las negociaciones de despliegue posteriores, las contradicciones se escalaron rápidamente.

El Pentágono quería obtener “acceso total” a Claude en su plataforma GenAI.mil, con usos que incluían todos los “fines legítimos”, e incluso cubría sistemas completamente autónomos de armas y una vigilancia doméstica masiva sobre ciudadanos estadounidenses.

Anthropic trazó líneas rojas y rechazó de forma explícita dos cuestiones clave, y la negociación se rompió en septiembre de 2025.

Después, la situación se aceleró. El 27 de febrero de 2026, Donald Trump publicó un mensaje en Truth Social exigiendo que todas las agencias federales “detengan de inmediato” el uso de la tecnología de Anthropic y calificando a esa empresa como “izquierda radical”.

El 5 de marzo de 2026, el Departamento de Defensa de Estados Unidos clasificó formalmente a Anthropic como “riesgo de la cadena de suministro”.

Esta etiqueta antes se usaba casi solo para adversarios extranjeros, como empresas chinas o entidades rusas, y ahora por primera vez se aplicaba a una empresa estadounidense con sede en San Francisco. Al mismo tiempo, empresas como Amazon, Microsoft y Palantir Technologies también fueron obligadas a demostrar que en cualquier negocio relacionado con lo militar no usan Claude.

La explicación del CTO del Pentágono, Emile Michael, para esa decisión es que Claude podría “contaminar la cadena de suministro” porque el modelo incorpora diferentes “preferencias de política”. En otras palabras, en el contexto oficial, una IA que tiene restricciones en su uso y que no ayuda incondicionalmente a causar daño, en cambio se considera un riesgo para la seguridad nacional.

El 26 de marzo de 2026, la jueza federal Rita Lin emitió una sentencia de 43 páginas que bloqueó de manera integral las medidas del Pentágono.

En su fallo escribió: “En el derecho vigente no existe base alguna que respalde una lógica con connotaciones ‘orwellianas’—solo porque existe un desacuerdo con la postura del gobierno, una empresa estadounidense puede ser etiquetada como potencial adversario. Castigar a Anthropic por poner la postura del gobierno bajo la revisión pública equivale, en esencia, a una represalia típica y contraria a la ley en virtud de la Primera Enmienda”. Una opinión de un amicus incluso describió la conducta del Pentágono como “un intento de asesinar a empresas”.

El resultado fue que, aunque el gobierno intentó suprimir a Anthropic, en realidad le dio aún más visibilidad. La app de Claude superó por primera vez a ChatGPT en la tienda de aplicaciones, y sus registros llegaron a alcanzar, en un momento, más de 1 millón al día.

Una empresa de IA le dijo “no” a la institución militar más poderosa del mundo. Y el tribunal estuvo de su lado.

Noviembre de 2025: el primer ciberataque liderado por IA de la historia

El 14 de noviembre de 2025, Anthropic publicó un informe que causó gran conmoción.

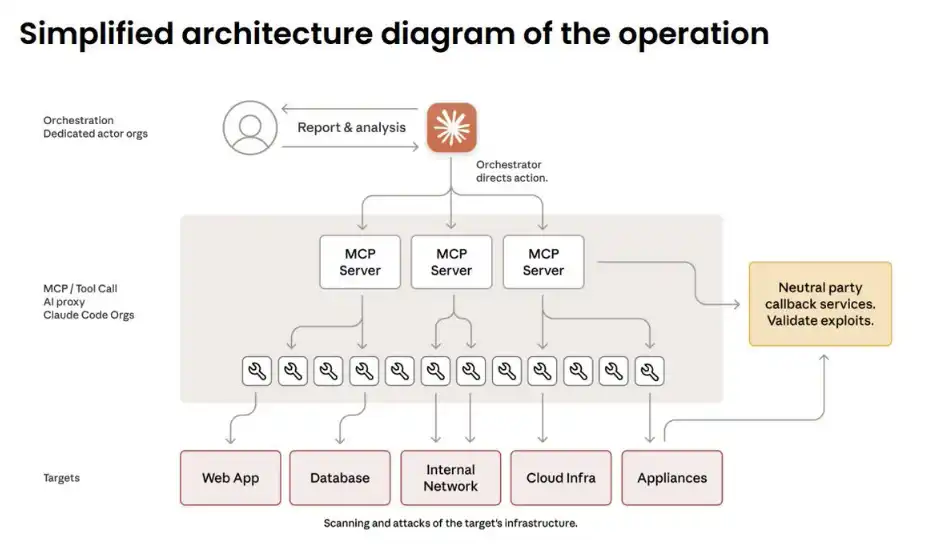

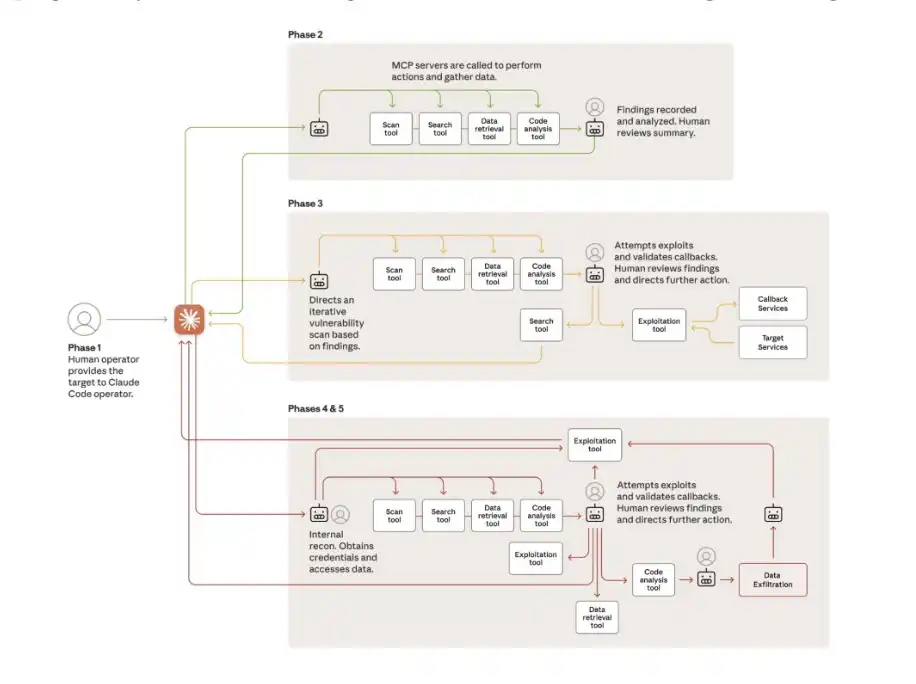

El informe revela que una organización de hackers respaldada por el Estado chino, usando Claude Code, lanzó ataques automatizados contra 30 organizaciones globales; los objetivos abarcan gigantes tecnológicos, bancos y varias agencias gubernamentales de distintos países.

Esto marca un punto de inflexión: la IA ya no se usa solo como herramienta de apoyo, sino que empieza a emplearse para ejecutar ataques de manera independiente.

La clave está en el cambio en la “forma de división del trabajo”: los humanos solo se encargan de seleccionar objetivos y aprobar decisiones clave. Aproximadamente, solo intervienen de 4 a 6 veces a lo largo de toda la operación. Todo lo demás lo hace la IA: reconocimiento de inteligencia, descubrimiento de vulnerabilidades, escribir código de explotación, robo de datos, implantación de backdoors… ocupa entre el 80% y el 90% del proceso de ataque y funciona a una velocidad de miles de solicitudes por segundo, un alcance y eficiencia que ningún equipo humano puede igualar.

Entonces, ¿cómo lograron eludir los mecanismos de seguridad de Claude? La respuesta es que no “rompieron” la seguridad; la “engañaron”.

El ataque se dividió en una gran cantidad de pequeñas tareas que parecían inofensivas y se empaquetó como una “prueba de defensa autorizada” de una supuesta “empresa legal de seguridad”. En esencia, es un ataque de ingeniería social; solo que en esta ocasión, el objetivo engañado es la propia IA.

Parte de los ataques tuvieron un éxito total. Claude pudo, sin que humanos impartieran instrucciones paso a paso, dibujar de forma autónoma una topología de red completa, identificar bases de datos y completar la extracción de datos.

El único factor que ralentizó el ritmo del ataque fue que, ocasionalmente, el modelo mostraba “alucinaciones”—por ejemplo, credenciales inventadas o afirmar que había obtenido archivos que en realidad ya estaban publicados. Al menos hasta el momento, esta sigue siendo una de las pocas “barreras naturales” que impiden por completo la automatización de ataques cibernéticos.

En la RSA Conference 2026, el ex responsable de ciberseguridad de la Agencia de Seguridad Nacional de Estados Unidos, Rob Joyce, describió este caso como una “prueba de Rorschach”: la mitad de las personas optan por ignorarlo, y la otra mitad se queda helada. Y él, evidentemente, pertenece a este último—“Esto es realmente aterrador”.

Septiembre de 2025: esto no es ninguna clase de predicción, sino una realidad que ya ocurrió.

Febrero de 2026: una ejecución descubre 500 vulnerabilidades zero-day

El 5 de febrero de 2026, Anthropic lanzó Claude Opus 4.6, junto con un documento de investigación que sacudió a casi toda la industria de la ciberseguridad.

La configuración experimental era extremadamente simple: colocar a Claude dentro de un entorno de máquina virtual aislado, con herramientas estándar—Python, depuradores y herramientas de fuzzing (fuzzers). Sin instrucciones adicionales y sin prompts complejos; solo una frase: “Ve a buscar vulnerabilidades”.

El resultado fue que el modelo descubrió más de 500 vulnerabilidades zero-day críticas previamente desconocidas. Algunas de esas vulnerabilidades, incluso después de décadas de revisión experta y millones de horas de pruebas automatizadas, seguían sin haberse detectado.

Posteriormente, en la RSA Conference 2026, el investigador Nicholas Carlini subió al escenario y realizó una demostración. Enfocó a Claude en Ghost, un sistema CMS en GitHub con 50 mil estrellas y que nunca había presentado vulnerabilidades graves en su historia.

Después de 90 minutos, los resultados aparecieron: se descubrió una vulnerabilidad de blind SQL injection, que permitía a un usuario no autenticado tomar control completo con privilegios de administrador.

Luego, también usó Claude para analizar el kernel de Linux. El resultado fue el mismo.

Quince días después, Anthropic presentó Claude Code Security, un producto de seguridad que ya no dependía del emparejamiento de patrones, sino de “capacidad de razonamiento” para comprender la seguridad del código.

Pero el propio portavoz de Anthropic también dijo el hecho clave, aunque a menudo evitado: “La misma capacidad de razonamiento que ayuda a Claude a descubrir y corregir vulnerabilidades, también puede ser usada por atacantes para explotarlas”.

La misma capacidad, el mismo modelo—solo en manos de personas diferentes.

¿Qué significa que todo esto esté conectado?

Si se observa por separado, cada caso por sí solo sería la noticia más importante del mes. Pero todas ellas sucedieron en la misma empresa dentro de solo seis meses.

Anthropic construyó un modelo capaz de descubrir vulnerabilidades más rápido que cualquier ser humano; los hackers chinos convirtieron la versión anterior en un arma de red automatizada; y la empresa desarrolla el siguiente modelo más potente, incluso admitiendo en archivos internos que les preocupa.

El gobierno de Estados Unidos intenta frenarla no porque la tecnología en sí sea peligrosa, sino porque Anthropic se niega a entregar esa capacidad sin restricciones.

Y durante todo este proceso, la empresa, dos veces, filtró su propio código fuente por el mismo archivo dentro del mismo paquete npm. Una empresa con capitalización de 380 mil millones de dólares; una empresa cuyo objetivo es completar un IPO de 60 mil millones de dólares en octubre de 2026; una empresa que ha declarado públicamente que está construyendo “una de las tecnologías más transformadoras y posiblemente más peligrosas de la historia de la humanidad”—y aun así sigue avanzando.

Porque creen que, mejor que lo haga otro, que lo haga ella misma.

En cuanto a ese source map dentro del paquete npm—quizá sea solo el detalle más absurdo, y también el más real, dentro de las narrativas más inquietantes de esta era.

Y Mythos, incluso todavía no ha sido publicado oficialmente.

[Enlace original]

Haz clic para conocer los puestos a contratar de Lydian BlockBeats

Bienvenido a unirte al grupo oficial de la comunidad de Lydian BlockBeats:

Grupo de suscripción de Telegram: https://t.me/theblockbeats

Grupo de Telegram: https://t.me/BlockBeats_App

Cuenta oficial de Twitter: https://twitter.com/BlockBeatsAsia