Legislador pregunta "¿Quién es responsable si la industria financiera cría langostas?" - Comisión Financiera: Los agentes de IA se incluirán en la supervisión

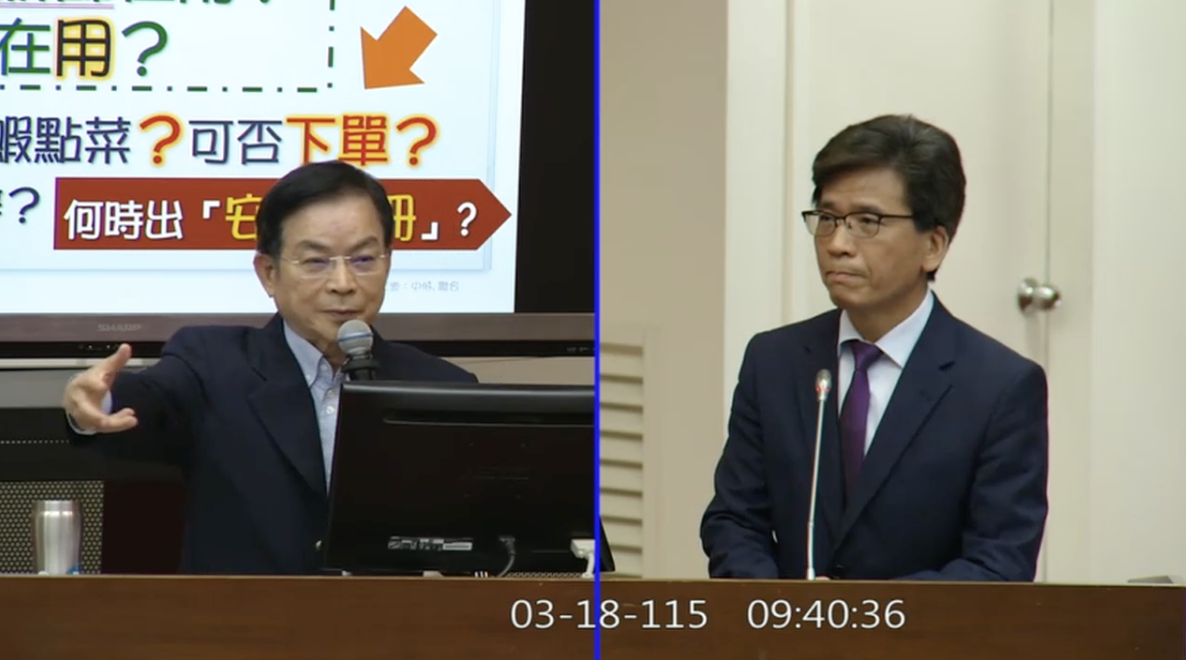

El legislador Lai Shih-po en la Comisión de Finanzas del Parlamento mencionó la herramienta de IA OpenClaw (comúnmente conocida como “Langosta”) y preguntó a la Comisión de Supervisión Financiera qué responsabilidad tendría si las instituciones financieras usaran IA para realizar órdenes automáticas y ocurriera un error. El presidente de la Comisión, Peng Jinlong, respondió que si esto afecta la seguridad operativa de las instituciones financieras, las autoridades regulatorias naturalmente incluirán esto en su supervisión. Además, en el futuro, las tecnologías de IA serán formalmente incorporadas en las directrices regulatorias.

(Resumen previo: Clawdbot, un asistente de IA 24/7 que hizo que Mac mini se agotara)

(Información adicional: Huang Renxun anunció que NVIDIA entrará en el campo del cómputo espacial: Vera Rubin Space-1 construirá un centro de datos orbital)

El 18 de marzo, en la Comisión de Finanzas del Parlamento, el legislador Lai Shih-po subió al podio con una captura de pantalla de una herramienta de IA con un dibujo de langosta roja. Se refería a OpenClaw, un software de IA de código abierto que puede tomar control del ordenador mediante instrucciones en lenguaje natural, leer navegadores y acceder a archivos locales, operando de manera muy diferente a los chatbots tradicionales.

Ahora surge la pregunta. Lai Shih-po señaló que ya hay analistas bursátiles y corredores en el país que están usando esta herramienta, y planteó una hipótesis a Peng Jinlong: “Supongamos que le digo que compre una acción de TSMC, y en realidad compra 10, ¿cómo se calcula esa responsabilidad?”

Comisión de Supervisión Financiera: Si afecta la seguridad operativa, se incluye en la supervisión

Peng Jinlong no evitó la pregunta. Indicó que si la aplicación de IA relacionada ya afecta la seguridad operativa de las instituciones financieras, “las autoridades regulatorias, por supuesto, la incluirán en su alcance de supervisión”. La Comisión de Supervisión Financiera publicó en junio de 2024 las “Directrices para el uso de IA en el sector financiero”, que cubren principios sobre gobernanza de datos, riesgos de modelos y seguridad de la información. Sin embargo, también admitió que la velocidad de evolución de las tecnologías de IA es muy rápida, por lo que las directrices actuales necesitan actualizarse.

Peng mantuvo una postura calmada, diciendo que primero se deben realizar estudios y pruebas cuidadosas para formar regulaciones precisas y factibles, enfatizando que no se establecerán reglas apresuradas, pero tampoco se permitirá la laissez-faire.

El “Manual de Seguridad para Criar Langostas” es en serio

Lai Shih-po, en tono de broma, mencionó que el Ministerio de Seguridad Nacional de China ya publicó oficialmente un “Manual de Seguridad para la Cría de Langostas”, y pidió que la Comisión de Supervisión Financiera también exija a las instituciones financieras que usen este tipo de herramientas que elaboren un documento de operación segura similar.

Lectura adicional: El Ministerio de Seguridad Nacional de China advierte sobre la “cría de langostas”: OpenClaw oculta cuatro minas terrestres de seguridad, tu dispositivo podría ser controlado

El logo de OpenClaw es una langosta roja. Huang Renxun en GTC 2026 dijo que es “el próximo ChatGPT”, y NVIDIA ya lanzó la versión empresarial NemoClaw. Desde Silicon Valley hasta el Parlamento, esta langosta avanza más rápido de lo que cualquiera esperaba.

La supervisión financiera frente a herramientas de IA como OpenClaw no enfrenta tanto desafíos tecnológicos, sino de responsabilidad. En última instancia, la industria financiera podría necesitar un mecanismo de responsabilidad humano-máquina para IA.