¡GPT-5.4 Mini en línea! Velocidad de ejecución duplicada, modelos pequeños más prácticos

OpenAI lanzó el 18 de marzo GPT-5.4 Mini y GPT-5.4 Nano, dos modelos ligeros diseñados para cargas de trabajo de IA de alta capacidad, que vuelven a iterar menos de dos semanas después del lanzamiento de la versión insignia GPT-5.4. GPT-5.4 Mini es el doble de rápido que su predecesor GPT-5 Mini, mientras que GPT-5.4 Nano está optimizado a menor costo para escenarios de conversación en tiempo real.

La lógica central de los modelos pequeños: la precisión no siempre es la limitación

OpenAI posiciona a GPT-5.4 Mini y Nano como “los modelos pequeños más potentes hasta la fecha”, pero esto no significa que sean versiones reducidas de la versión insignia. Son diseños basados en diferentes prioridades: cuando el cuello de botella real en una tarea es la velocidad y el costo, y no la profundidad de razonamiento, los modelos más pequeños suelen ser más prácticos.

Por ejemplo, en un sistema de atención al cliente: si se responden 200 preguntas diarias fijas, la ganancia marginal de tener capacidades de razonamiento de nivel doctorado es casi nula, mientras que la capacidad de responder en menos de un segundo y con un costo de fracciones de centavo por respuesta es clave para escalar el sistema.

Actualmente, un flujo de trabajo eficiente consiste en que el modelo insignia (como GPT-5.4) se encargue de la planificación y coordinación de tareas, mientras que Mini o Nano procesan en paralelo muchas tareas repetitivas —como búsquedas en bases de código, lectura de documentos o manejo de formularios. Jerry Ma, subdirector técnico de Perplexity, comentó tras las pruebas: “Mini tiene una fuerte capacidad de razonamiento, y Nano responde rápidamente y de manera eficiente, ideal para flujos de trabajo de conversación en tiempo real.”

Datos de referencia: Mini ya supera los estándares humanos en operación de computadoras

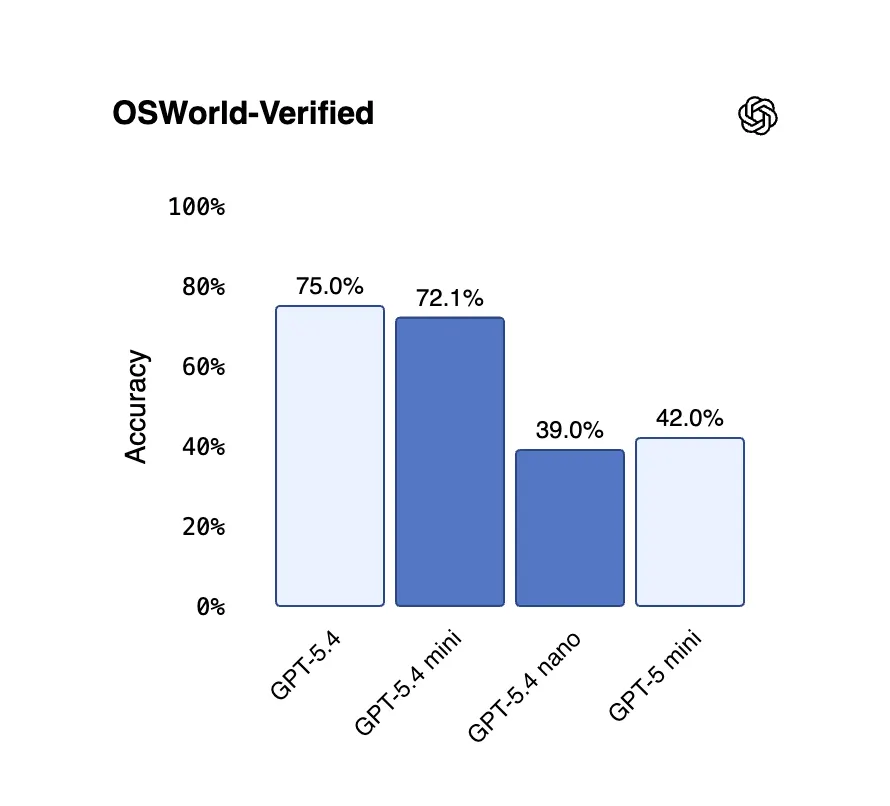

(Origen: OpenAI)

Según datos públicos de referencia, el rendimiento de GPT-5.4 Mini ya se acerca bastante a la versión insignia:

SWE-Bench Pro (evaluación de la capacidad para solucionar problemas reales de código en GitHub):

GPT-5.4 Mini obtiene 54.4%; la versión anterior GPT-5 Mini, 45.7%; GPT-5.4 insignia, 57.7%.

OSWorld-Verified (evaluación de la capacidad para operar en escritorio mediante capturas de pantalla):

Mini obtiene 72.1%; GPT-5.4 insignia, 75.0%; la línea base humana, 72.4% — Mini ya supera el estándar humano.

GPT-5.4 Nano:

SWE-Bench Pro 52.4%, OSWorld-Verified 39.0%, por debajo de Mini, pero aún un avance importante respecto a generaciones anteriores de Nano.

Estos datos muestran que, en escenarios que requieren manipulación de escritorio o procesamiento de código, Mini casi iguala el rendimiento de la versión insignia; aunque Nano tiene menor precisión, en escenarios que exigen respuesta inmediata, sigue siendo una opción con ventajas de costo y eficiencia.

Estructura de precios y disponibilidad: diferentes accesos para desarrolladores y usuarios comunes

Precios API:

GPT-5.4 Mini cuesta $0.75 por millón de tokens de entrada y $4.50 por millón de tokens de salida;

GPT-5.4 Nano, $0.20 por millón de tokens de entrada y $1.25 por millón de tokens de salida — el precio de entrada de Nano es aproximadamente una cuarta parte del de Mini.

Accesibilidad para usuarios:

GPT-5.4 Mini ya está disponible para usuarios de ChatGPT Free y Plan Go, accesible desde la opción “+” en el menú de ChatGPT bajo “Pensar”; cuando los usuarios de pago alcanzan el límite de uso de GPT-5.4, el sistema automáticamente cambia a Mini.

GPT-5.4 Nano actualmente solo está disponible vía API, dirigido a desarrolladores y no directamente a consumidores.

Preguntas frecuentes

¿Cuál es la principal diferencia entre GPT-5.4 Mini y GPT-5.4 insignia?

GPT-5.4 Mini es más de dos veces más rápido que la versión anterior GPT-5 Mini, con una puntuación de 72.1% en la prueba OSWorld-Verified, superando la línea base humana del 72.4%, y solo ligeramente por debajo del 75.0% de la versión insignia. La diferencia principal radica en la profundidad de razonamiento y la capacidad para tareas complejas, pero la velocidad y el costo más bajos hacen que Mini sea más práctico para tareas repetitivas en gran volumen.

¿Cuál es el mejor escenario de uso para GPT-5.4 Nano?

GPT-5.4 Nano está diseñado como herramienta para desarrolladores API, ideal para flujos de trabajo de conversación ligera que requieren respuestas en tiempo real, como sistemas de atención al cliente instantáneos o consultas automatizadas diarias a gran escala. Con un costo de entrada de solo $0.20 por millón de tokens, es económicamente viable para despliegues masivos en startups.

¿Cómo usar GPT-5.4 Mini en ChatGPT?

GPT-5.4 Mini ya está disponible para usuarios de ChatGPT Free y Plan Go, accesible desde la opción “+” en la interfaz de ChatGPT bajo “Pensar”. Cuando los usuarios de pago alcanzan el límite de uso de GPT-5.4, el sistema automáticamente cambia a Mini.