¿Cómo opera Theta EdgeCloud? Un desglose detallado de todo el flujo de trabajo de computación en el borde de IA

Los servicios tradicionales de IA en la nube suelen depender de grandes centros de datos centralizados. Si bien este modelo proporciona una gran potencia de cálculo, también conlleva altos costes de GPU, gestión centralizada de recursos y problemas de escalabilidad. Theta EdgeCloud aborda estos desafíos integrando nodos Edge con computación en la nube, agregando recursos GPU inactivos de todo el mundo en una red unificada para optimizar la utilización de recursos y mejorar la colaboración distribuida.

Con el aumento de la competencia en infraestructura de IA, Theta EdgeCloud se posiciona como referente en soluciones DePIN (Decentralized Physical Infrastructure Network) y redes distribuidas de GPU. Su objetivo no es sustituir por completo a las plataformas de nube tradicionales, sino ofrecer una colaboración más flexible de recursos para escenarios de inferencia de IA y computación edge.

Qué es Theta EdgeCloud

Theta EdgeCloud es una plataforma híbrida de IA en la nube desarrollada sobre el ecosistema de Theta Network. Su propuesta es combinar nodos Edge distribuidos con servicios tradicionales de GPU en la nube, creando una red unificada de recursos de computación.

A diferencia de los servicios de IA en la nube centralizados, Theta EdgeCloud obtiene recursos tanto de servidores en la nube como de nodos Edge Node operados por usuarios en todo el mundo. Estos nodos comparten GPU, CPU y ancho de banda inactivos para alimentar tareas de inferencia de IA, transcodificación de vídeo y renderizado.

Para los desarrolladores, Theta EdgeCloud es una capa de cómputo de IA que orquesta dinámicamente recursos distribuidos. Basta con enviar las tareas en la plataforma: el sistema gestiona automáticamente la asignación y ejecución de recursos, eliminando la gestión directa de nodos.

¿En qué se diferencia Theta EdgeCloud de los servicios tradicionales de IA en la nube?

Las plataformas de IA en la nube tradicionales suelen operar con grandes centros de datos y servicios centralizados de GPU, gestionando y programando los recursos desde el proveedor. Si bien es un modelo maduro y estable, resulta vulnerable a la escasez de GPU y al encarecimiento de los costes.

Theta EdgeCloud, por el contrario, impulsa el "compartir recursos edge". Los nodos Edge de todo el mundo pueden aportar GPU inactivas para su reutilización. Cuando se envía una tarea de IA, la plataforma asigna los recursos según las necesidades de la tarea, el estado de los nodos y la potencia de cálculo disponible.

Las principales diferencias entre Theta EdgeCloud y las plataformas tradicionales de IA en la nube son:

| Dimensión de comparación | Plataforma tradicional de IA en la nube | Theta EdgeCloud |

|---|---|---|

| Fuente de recursos | Centro de datos centralizado | Cloud GPU + Edge Node |

| Estructura de red | Centralizada | Distribuida |

| GPU Scheduling | Gestión centralizada de la plataforma | Colaboración dinámica de nodos |

| Participación de nodos | Proveedor de servicios en la nube | Recursos compartidos por usuarios |

| Mecanismo de incentivos | Tarifas de servicio | Mecanismo de Recompensa TFUEL |

Este modelo convierte a Theta EdgeCloud en una auténtica red distribuida de GPU, y no solo en una plataforma de computación en la nube convencional.

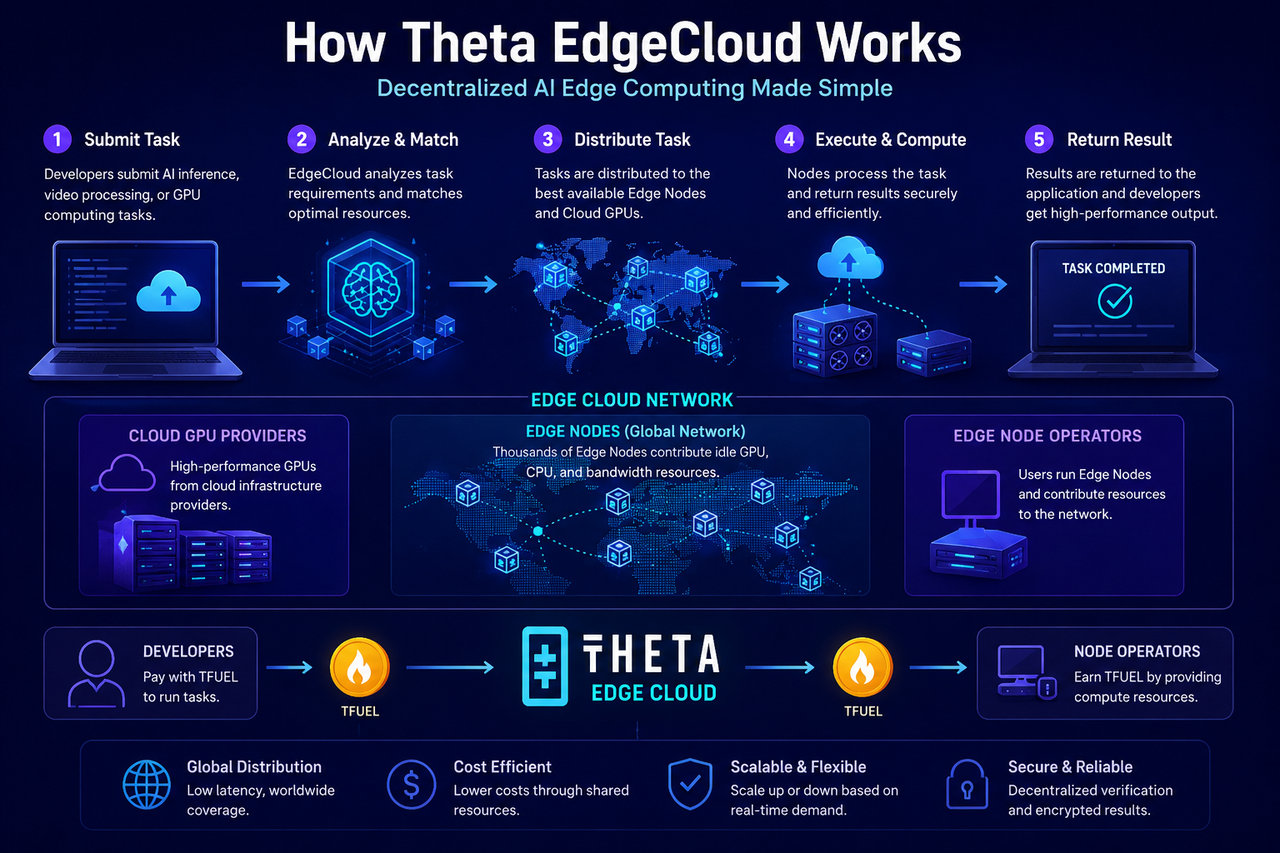

¿Qué ocurre cuando los usuarios envían tareas de IA?

Cuando desarrolladores o aplicaciones envían tareas de inferencia de IA, procesamiento de vídeo o renderizado, Theta EdgeCloud analiza primero los requisitos de recursos: tipo de GPU, memoria, tiempo de cálculo y ancho de banda.

Después, el sistema localiza los nodos adecuados en la red. Algunas tareas se procesan en GPU en la nube; otras, en nodos Edge distribuidos globalmente, para un procesamiento colaborativo. Todo el proceso es automatizado, sin que los desarrolladores tengan que seleccionar nodos manualmente.

Durante la ejecución, el sistema vigila continuamente el estado de los nodos y el progreso de la tarea. Si algún nodo se desconecta o no dispone de recursos, la plataforma reasigna las tareas para garantizar la estabilidad del cálculo.

Al concluir, los resultados se devuelven a la capa de aplicación y los nodos participantes obtienen recompensas TFUEL según su contribución.

En esencia, es un "sistema distribuido de programación de recursos" que unifica el uso de la capacidad de cálculo inactiva en la red.

¿Cómo contribuyen los nodos Edge a la computación GPU?

Los nodos Edge son parte esencial de Theta EdgeCloud. Al operar un Edge Node, los usuarios pueden conectar su GPU y recursos de cálculo locales a la red Theta.

Cuando la red detecta demanda de inferencia de IA, renderizado de vídeo o computación edge, asigna tareas a estos nodos. Una vez completadas, los nodos reciben recompensas TFUEL proporcionales a los recursos de cálculo aportados.

A diferencia de las máquinas de minería tradicionales, los nodos Edge de Theta no están orientados a la minería PoW, sino a ofrecer recursos computacionales reales. Por eso Theta se clasifica como un proyecto DePIN.

Para la mayoría de usuarios, los nodos Edge son la puerta de entrada a la red Theta y la base del mecanismo de compartición de recursos.

¿Cómo circula TFUEL en EdgeCloud?

TFUEL es el principal token de utilidad en Theta EdgeCloud y funciona tanto como método de pago como incentivo en la red.

Cuando los desarrolladores envían tareas de IA o vídeo, pagan TFUEL como tarifa de recursos. El sistema distribuye parte de ese TFUEL a los nodos Edge que ejecutan los cálculos, según la tarea realizada.

En EdgeCloud, TFUEL conecta:

-

Desarrolladores de aplicaciones de IA

-

Proveedores de recursos GPU

-

La red de nodos Edge

-

La infraestructura Theta

Así se genera un ciclo de "pago por tarea—ejecución de recursos—recompensa a nodos".

Principales escenarios de uso de Theta EdgeCloud

Theta EdgeCloud se enfoca principalmente en aplicaciones de computación de IA y procesamiento multimedia.

En IA, los casos de uso incluyen:

-

Inferencia de modelos de IA

-

Inferencia de grandes modelos de lenguaje

-

Generación de imágenes

-

Computación distribuida con GPU

En vídeo y medios, Theta EdgeCloud permite:

-

Transcodificación de vídeo

-

Renderizado de vídeo

-

Procesamiento de retransmisiones En vivo

-

Entrega de contenido edge

Como los nodos Edge están distribuidos globalmente, las tareas con altas exigencias de tiempo real pueden aprovechar la computación edge para reducir la latencia.

A medida que confluyen la infraestructura de IA y Web3, Theta EdgeCloud se convierte en una pieza estratégica en la expansión de Theta desde los ecosistemas de vídeo hacia el sector de la IA.

Retos para Theta EdgeCloud

Las redes distribuidas de GPU ofrecen compartición de recursos y escalabilidad, pero Theta EdgeCloud sigue enfrentando desafíos prácticos.

No todos los nodos Edge cuentan con capacidades de hardware uniformes; las diferencias en el rendimiento de GPU afectan la eficiencia de las tareas. Además, la naturaleza distribuida de la red incrementa la complejidad de la programación de recursos y la gestión de tareas.

Al mismo tiempo, la competencia en el mercado de infraestructura de IA se acelera, con plataformas tradicionales y otros proyectos de redes distribuidas de GPU disputando cuota de mercado en computación de IA.

La creciente demanda de GPU de alto rendimiento, impulsada por la IA generativa, convierte el acceso y la programación estables de recursos GPU en un reto permanente para EdgeCloud.

Resumen

Theta EdgeCloud, desarrollada por Theta Network como plataforma descentralizada de IA y computación edge, busca crear una red distribuida de computación de IA coordinando nodos Edge globales y GPU en la nube.

Frente a los servicios de IA en la nube centralizados, Theta EdgeCloud prioriza la compartición de recursos edge, la colaboración GPU y la programación distribuida. Los desarrolladores envían tareas de inferencia de IA y procesamiento de vídeo desde la plataforma, mientras nodos Edge globales las ejecutan y reciben recompensas TFUEL.

La demanda creciente de inferencia de IA y recursos GPU impulsa la transformación de Theta de plataforma de streaming de vídeo a solución integral de infraestructura de IA.

Preguntas frecuentes

¿Cómo funciona Theta EdgeCloud?

Cuando los desarrolladores envían tareas de IA o vídeo, el sistema las asigna automáticamente a GPU en la nube y nodos Edge para su procesamiento colaborativo, utilizando TFUEL como medio de pago y recompensa.

¿Qué función tienen los nodos Edge en EdgeCloud?

Los nodos Edge aportan recursos GPU y de cálculo para ejecutar tareas de inferencia de IA, renderizado de vídeo y computación edge.

¿En qué se diferencia Theta EdgeCloud de los servicios tradicionales de IA en la nube?

Los servicios tradicionales de IA en la nube dependen de centros de datos centralizados, mientras que Theta EdgeCloud combina nodos Edge y GPU en la nube para formar una red de recursos distribuida.

¿Para qué se utiliza TFUEL en EdgeCloud?

TFUEL se utiliza para pagar las tareas de IA y vídeo, y también es el token de recompensa para los nodos al completar tareas.

¿Es Theta EdgeCloud un proyecto DePIN?

Dado que su modelo se basa en compartir recursos GPU y de computación edge, Theta EdgeCloud suele catalogarse como proyecto DePIN y red distribuida de GPU.

Artículos relacionados

Tokenómica de RENDER: suministro, incentivos y captura de valor

La aplicación de Render en IA: cómo el hashrate descentralizado impulsa la inteligencia artificial

GateClaw y habilidades de IA: análisis detallado del marco de capacidades para agentes de IA en Web3

0x Protocol vs Uniswap: ¿Cómo se diferencian los protocolos de Libro de órdenes del modelo AMM?

Análisis en profundidad de Audiera GameFi: cómo Dance-to-Earn integra la IA con los juegos de ritmo