Суддя федерального суду США тимчасово блокує заборону Пентагону на Anthropic

Федеральний суддя США у Сан-Франциско задовольнив запит Anthropic на тимчасове зупинення після того, як Пентагон визначив компанію як ризик для ланцюга постачання.

У четвер суддя Ріта Лін з Окружного суду Північного округу Каліфорнії видав попередню заборону проти Пентагону щодо цього ярлика. Це також тимчасово зупиняє директиву президента США Дональда Трампа, яка наказує федеральним агентствам припинити використання чат-бота Anthropic, Клода.

«Нічого в діючому законодавстві не підтримує орвеллівську ідею про те, що американська компанія може бути позначена як потенційний супротивник і підривник США за вираження незгоди з урядом», — сказала суддя Лін.

Anthropic була провідним гравцем на ринку корпоративного ШІ з 32%, випереджаючи OpenAI з 25% станом на 2025 рік, згідно з даними Menlo Ventures. Урядова заборона на Anthropic призвела б до падіння цієї позиції.

Суддя зазначила, що ці «широкі покарання», вжиті проти Anthropic адміністрацією Трампа та міністром оборони Пітом Хегсетхом, виглядали «довільними, капризними та зловживанням дискрецією».

Наказ надійшов після того, як Anthropic подала позов до федерального суду Колумбії 9 березня, стверджуючи, що Хегсетх перевищив свої повноваження, коли визначив компанію як ризик для національної безпеки в ланцюгу постачання.

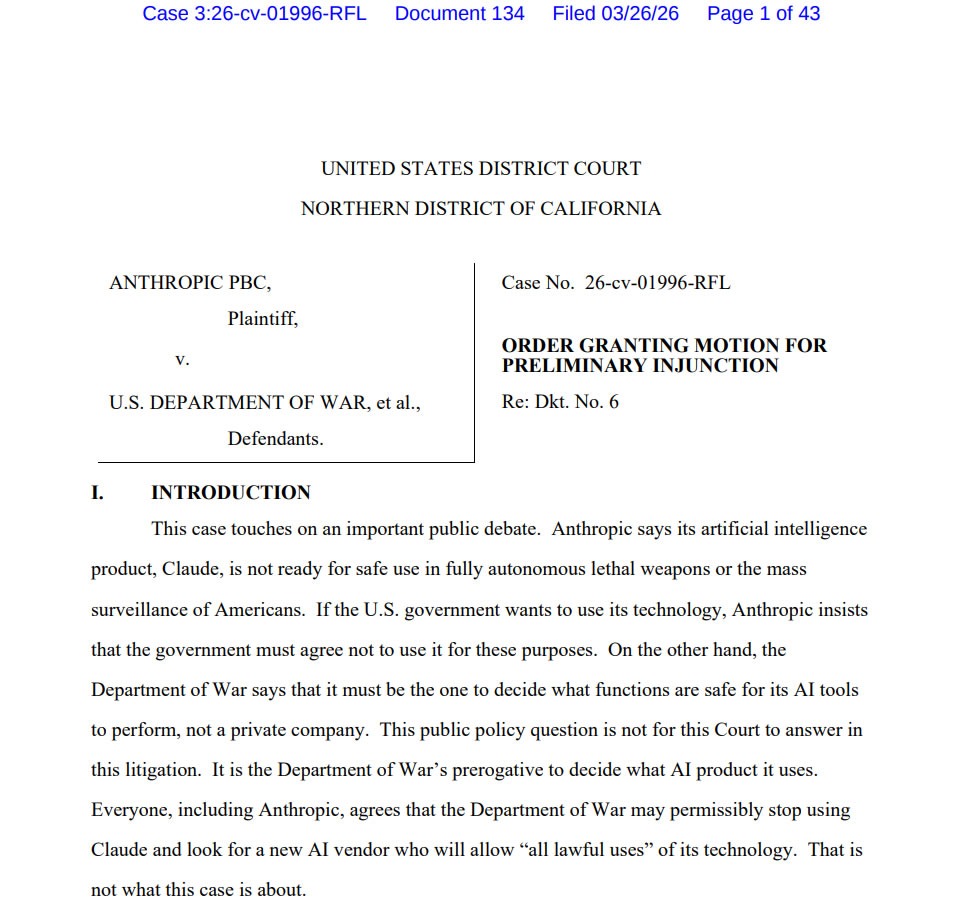

Скриншот з рішення суду. Джерело: Courtlistener

Anthropic виступала проти автономної зброї та масового внутрішнього спостереження

Суперечка виникла через угоду в липні 2025 року між компанією ШІ та Пентагоном щодо контракту на створення Клода, як першої прикордонної моделі ШІ, схваленої для використання у засекречених мережах.

Переговори зірвалися в лютому, коли Пентагон намагався перепідписати угоду, наполягаючи на тому, щоб Anthropic дозволила військове використання Клода «для всіх законних цілей» і без обмежень.

Anthropic наполягала, що її технології не повинні використовуватися для летальної автономної зброї та масового внутрішнього спостереження за американцями.

27 лютого Трамп наказав усім федеральним агентствам припинити використання продуктів Anthropic. «Ліві психи в Anthropic зробили КАТАСТРОФІЧНУ ПОМИЛКУ, намагаючись ТИСНУТИ на Міністерство оборони», — написав він у Truth Social.

90-хвилинне судове засідання відбулося у Сан-Франциско 24 березня, під час якого суддя Лін запитала урядових юристів, чи карається Anthropic за публічну критику Пентагону.

Класична незаконна помста за Першу поправку

«Карати Anthropic за привернення публічної уваги до позиції уряду щодо контрактування — це класична незаконна помста за Першу поправку», — йдеться у рішенні від 26 березня.

Anthropic заявила у заяві, що вона «вдячна суду за швидке реагування і рада, що вони погоджуються, що Anthropic, ймовірно, досягне успіху за суттю справи».

**Журнал: **__Ніхто не знає, чи буде працювати квантова криптографія

Cointelegraph прагне до незалежної, прозорої журналістики. Ця новинна стаття підготовлена відповідно до Редакційної політики Cointelegraph і має на меті надання точної та своєчасної інформації. Читачам рекомендується перевіряти інформацію самостійно. Ознайомтеся з нашою Редакційною політикою https://cointelegraph.com/editorial-policy

- #AI

- #Суд

- #Дональд Трамп

- #Регулювання