หัวข้อการบรรยาย GTC ฉบับเต็มของหวาง เหรินซวิน: ยุคแห่งการใช้เหตุผลมาถึงแล้ว ลอบสเตอร์คือระบบปฏิบัติการใหม่

แหล่งที่มา: 华尔街见闻

16 มีนาคม 2026 งาน GTC 2026 ของ英伟达เปิดฉากอย่างเป็นทางการ 黄仁勋 ผู้ก่อตั้งและ CEO กล่าวสุนทรพจน์หลัก

ในงานที่ถูกมองว่าเป็น “การแสวงบุญประจำปีของอุตสาหกรรม AI” นี้ 黄仁勋 ได้อธิบายถึงการเปลี่ยนแปลงของ英伟达 จากบริษัท “ชิปเซ็ต” สู่ “โครงสร้างพื้นฐานและโรงงาน AI” โดยในช่วงที่ตลาดให้ความสนใจอย่างสูงต่อความต่อเนื่องของผลประกอบการและโอกาสในการเติบโต 黄仁勋 ได้วิเคราะห์กลไกธุรกิจพื้นฐานที่ขับเคลื่อนการเติบโตในอนาคต — “เศรษฐศาสตร์โรงงาน Token”

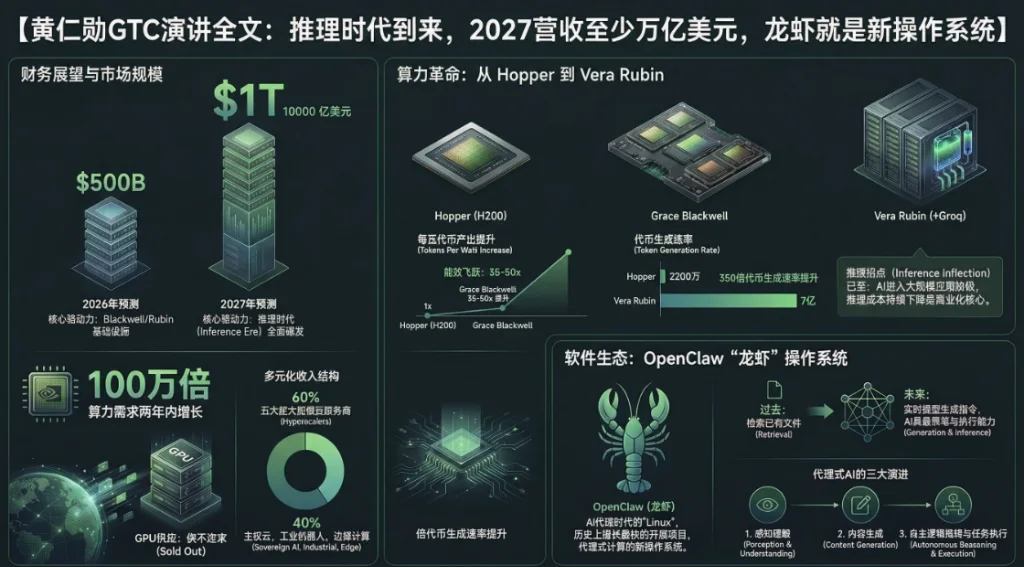

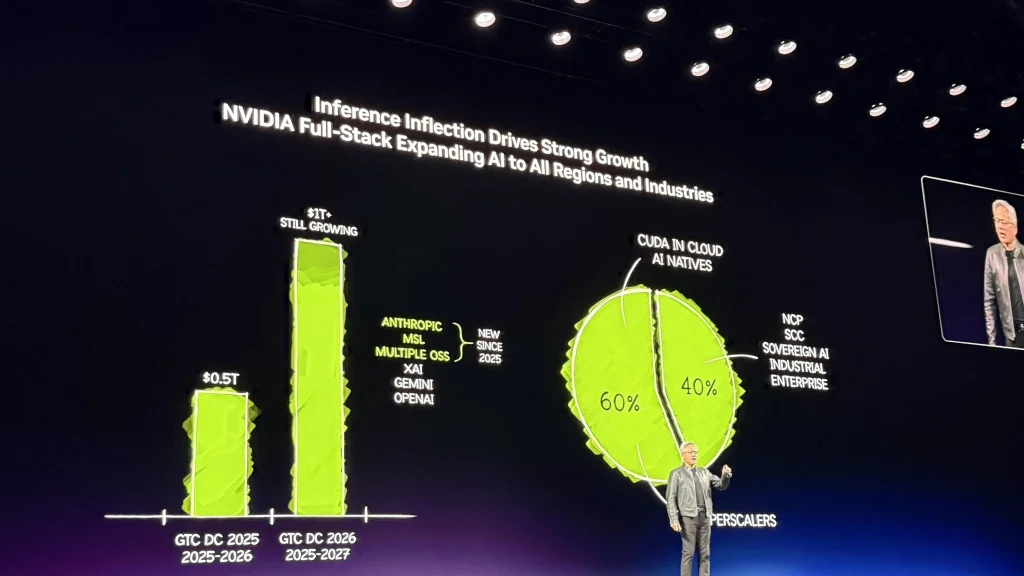

แนวทางผลประกอบการที่มองในแง่ดีสุด “ความต้องการอย่างน้อย 1 ล้านล้านดอลลาร์ในปี 2027”

ในสองปีที่ผ่านมา ความต้องการคำนวณ AI ทั่วโลกพุ่งสูงเป็นทวีคูณ เมื่อโมเดลขนาดใหญ่พัฒนาจาก “การรับรู้”, “การสร้าง” ไปสู่ “การสรุปผล” และ “การดำเนินการ (ปฏิบัติภารกิจ)” การใช้พลังคำนวณก็เพิ่มขึ้นอย่างรวดเร็ว 黄仁勋 ได้แสดงความคาดหวังที่แข็งแกร่งมากต่อแนวโน้มนี้

黄仁勋 กล่าวตรงๆ ในสุนทรพจน์ว่า:

เมื่อปีที่แล้ว ผมเคยพูดว่า เรามองเห็นความต้องการที่มั่นใจสูงถึง 5000 พันล้านดอลลาร์ ซึ่งครอบคลุม Blackwell และ Rubin จนถึงปี 2026 ตอนนี้ ณ จุดนี้ ณ เวลานี้ ผมเห็นความต้องการอย่างน้อย 1 ล้านล้านดอลลาร์ในปี 2027

ความคาดหวังนี้ของ黄仁勋 ทำให้ราคาหุ้น英伟达 พุ่งขึ้นกว่า 4.3%

นอกจากนี้ เขายังได้เสริมตัวเลขนี้ว่า:

นี่สมเหตุสมผลไหม? นี่คือสิ่งที่ผมจะพูดต่อไป จริงๆ แล้ว เรายังไม่สามารถตอบสนองความต้องการได้เพียงพอ ผมมั่นใจว่าความต้องการคำนวณจริงจะสูงกว่านี้มาก

黄仁勋 ชี้ให้เห็นว่า ระบบของ英伟达ในปัจจุบันได้พิสูจน์แล้วว่าเป็น “โครงสร้างพื้นฐานที่ต้นทุนต่ำที่สุดในโลก” เนื่องจาก英伟达 สามารถรันโมเดล AI ได้เกือบทุกด้าน ความสามารถนี้ทำให้การลงทุน 1 ล้านล้านดอลลาร์ของลูกค้าสามารถถูกใช้อย่างเต็มที่และมีอายุการใช้งานที่ยาวนาน

ปัจจุบัน ธุรกิจ 60% ของ英伟达 มาจากผู้ให้บริการคลาวด์ขนาดใหญ่ 5 ราย และอีก 40% กระจายอยู่ในกลุ่มคลาวด์อธิปไตย องค์กรอุตสาหกรรม หุ่นยนต์ และการคำนวณขอบเขตต่างๆ

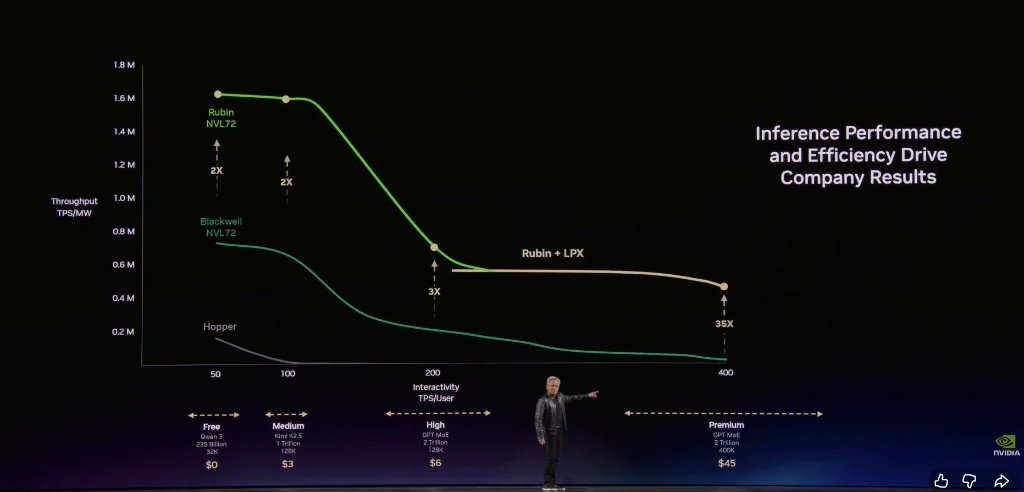

เศรษฐศาสตร์โรงงาน Token, กำลังวัตต์เดียวกำหนดชีวิตธุรกิจ

เพื่ออธิบายความสมเหตุสมผลของความต้องการ 1 ล้านล้านดอลลาร์นี้ 黄仁勋 ได้แสดงแนวคิดเชิงธุรกิจใหม่ให้กับ CEO ของบริษัททั่วโลก เขาชี้ว่า ศูนย์ข้อมูลในอนาคตจะไม่ใช่แค่คลังเก็บไฟล์อีกต่อไป แต่จะเป็น “โรงงาน” ผลิต Token (หน่วยพื้นฐานของ AI ที่สร้างขึ้น)

黄仁勋 เน้นย้ำว่า:

ทุกศูนย์ข้อมูล ทุกโรงงาน ตั้งแต่กำเนิด ก็ถูกจำกัดด้วยพลังงาน หนึ่งโรงงานที่ใช้ไฟ 1GW (กิกะวัตต์) จะไม่มีทางกลายเป็น 2GW ซึ่งเป็นกฎฟิสิกส์และอะตอม ในภายใต้พลังงานคงที่ ใครที่มีอัตราการผ่าน Token ต่อวัตต์สูงสุด ก็จะมีต้นทุนการผลิตต่ำที่สุด

黄仁勋 จัดแบ่งระดับบริการ AI ออกเป็นชั้นต่างๆ ดังนี้:

ฟรี (High Throughput, Low Speed)

ระดับกลาง (~3 ดอลลาร์ต่อหนึ่งล้าน Token)

ระดับสูง (~6 ดอลลาร์ต่อหนึ่งล้าน Token)

ความเร็วสูง (~45 ดอลลาร์ต่อหนึ่งล้าน Token)

ความเร็วสูงสุด (~150 ดอลลาร์ต่อหนึ่งล้าน Token)

เขาอธิบายว่า เมื่อโมเดลใหญ่ขึ้นและบริบทยาวขึ้น AI จะฉลาดขึ้น แต่การสร้าง Token จะช้าลง 黄仁勋 กล่าวว่า:

ในโรงงาน Token นี้ อัตราการผ่านและความเร็วในการสร้าง Token ของคุณ จะตรงกับรายได้ที่คุณจะได้รับในปีหน้า

黄仁勋 เน้นว่า สถาปัตยกรรมของ英伟达 ช่วยให้ลูกค้าสามารถทำ High Throughput ได้ในระดับสูงสุดในชั้นฟรี และในชั้นที่มีมูลค่าสูงสุดของการวิเคราะห์ (Inference) ก็สามารถเพิ่มประสิทธิภาพได้ถึง 35 เท่า

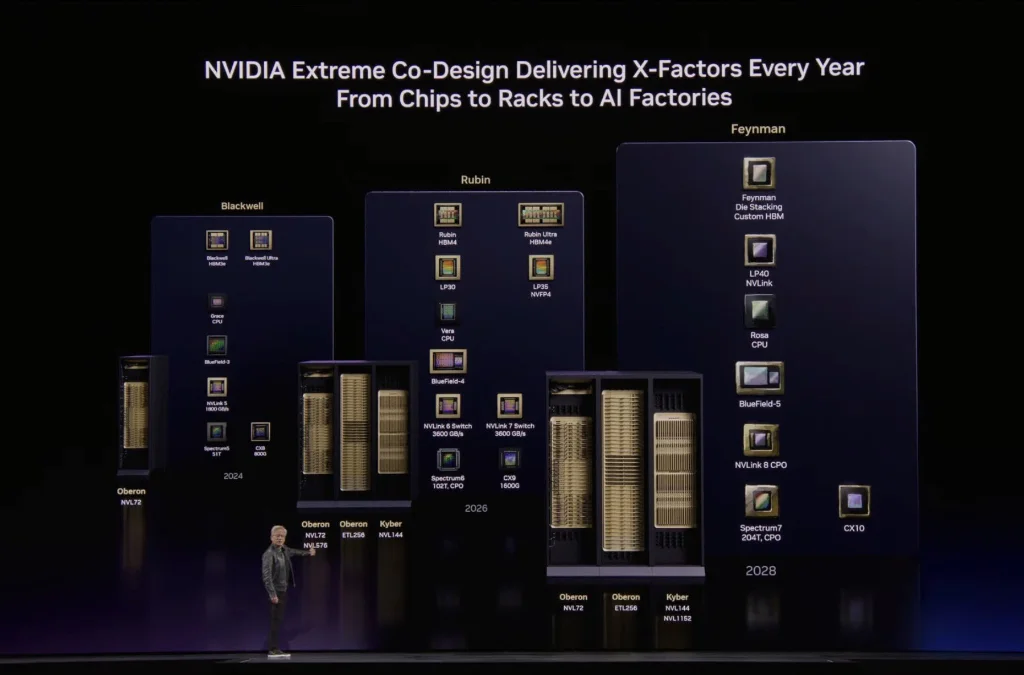

Vera Rubin ทำความเร็ว 350 เท่าในสองปี, Groq เติมเต็มความเร็วสูงสุดในการวิเคราะห์

ภายใต้ข้อจำกัดของกฎฟิสิกส์นี้ 英伟达 ได้แนะนำระบบคำนวณ AI ที่ซับซ้อนที่สุดในประวัติศาสตร์ Vera Rubin 黄仁勋 กล่าวว่า:

เมื่อพูดถึง Hopper ผมจะยกชิปขึ้นมา มันน่ารักดี แต่เมื่อพูดถึง Vera Rubin ทุกคนจะนึกถึงระบบทั้งระบบ ในระบบนี้ที่ใช้น้ำหล่อเย็นแบบ液冷 100% และไม่มีสายเคเบิลแบบเดิมอีกต่อไป โครงสร้างเดิมที่ใช้เวลาติดตั้งสองวัน ตอนนี้ใช้เวลาเพียงสองชั่วโมงเท่านั้น

黄仁勋 ชี้ให้เห็นว่า ด้วยการออกแบบซอฟต์แวร์และฮาร์ดแวร์แบบสุดขีด Vera Rubin สร้างความก้าวหน้าขนาดใหญ่ในศูนย์ข้อมูลเดียวกัน:

ในเวลาเพียงสองปี เราได้เพิ่มอัตราการสร้าง Token จาก 22 ล้านเป็น 700 ล้านต่อวินาที คิดเป็นการเติบโต 350 เท่า ซึ่งในช่วงเวลาเดียวกัน Moore’s Law ให้ผลประมาณ 1.5 เท่าเท่านั้น

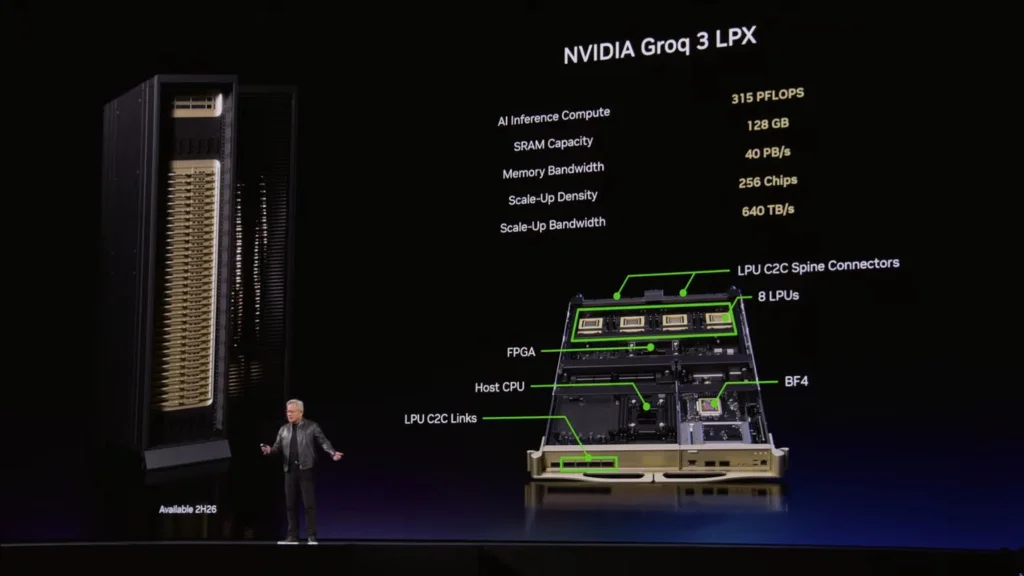

เพื่อแก้ปัญหาคอขวดด้านแบนด์วิดธ์ในกรณีการวิเคราะห์ความเร็วสูง (เช่น 1000 Token/วินาที) 英伟达 จัดให้มีการรวมระบบที่ซื้อกิจการ Groq เข้าด้วยกันในแนวทางสุดท้าย: การแยกการวิเคราะห์แบบไม่สมมาตร 黄仁勋 อธิบายว่า:

ลักษณะเด่นของสองตัวประมวลผลนี้แตกต่างกันอย่างสิ้นเชิง ชิป Groq มี SRAM 500MB ในขณะที่ Rubin มีหน่วยความจำ 288GB

黄仁勋 ชี้ให้เห็นว่า ด้วยระบบซอฟต์แวร์ Dynamo ของ英伟达 การแบ่งงานระหว่างการเติมข้อมูลล่วงหน้า (Pre-fill) และการ decode ที่ไวต่อความล่าช้า (decode stage) ให้ Vera Rubin ทำหน้าที่นี้ ส่วนการ decode ที่ต้องการความเร็วสูงมาก เช่น การสร้าง Token ก็ให้ Groq ทำหน้าที่นี้ 黄仁勋 ยังแนะนำการปรับแต่งการจัดสรรทรัพยากรในศูนย์ข้อมูล:

ถ้างานของคุณเน้น throughput สูง ให้ใช้ Vera Rubin 100% แต่ถ้าคุณมีความต้องการสร้าง Token ที่มีมูลค่าสูงมาก เช่น การสร้างโค้ด ให้จัดสรร 25% ของศูนย์ข้อมูลให้กับ Groq

ข้อมูลจาก Samsung ที่ผลิตชิป Groq LP30 อยู่ในสายการผลิตแล้ว คาดว่าจะเริ่มส่งมอบในไตรมาส 3 และ Vera Rubin ตัวแรกก็ทำงานบนคลาวด์ Azure ของ Microsoft แล้ว

นอกจากนี้ 黄仁勋 ยังแสดงเทคโนโลยีการเชื่อมต่อด้วย光互联 ซึ่งเป็นการแสดง Spectrum X ซึ่งเป็นสวิตช์光学 (CPO) รุ่นแรกของโลกที่ผลิตจำนวนมาก และได้คลายความกังวลของตลาดเกี่ยวกับแนวทาง “ทองแดงถอยหลัง เข้าสู่光” ด้วยคำพูดว่า:

เราต้องการกำลังการผลิตสายทองแดงมากขึ้น กำลังการผลิตชิป光มากขึ้น และกำลังการผลิต CPO มากขึ้น

Agent ยุติ SaaS แบบเดิม, “เงินเดือน + Token” กลายเป็นมาตรฐานของ Silicon Valley

นอกจากฮาร์ดแวร์ 黄仁勋 ยังใช้เวลาส่วนใหญ่กับการปฏิวัติซอฟต์แวร์ AI และระบบนิเวศ โดยเฉพาะการระเบิดของ Agent (ตัวแทนสมองกล)

เขาเปรียบโครงการโอเพนซอร์ส OpenClaw ว่าเป็น “โครงการโอเพนซอร์สที่ได้รับความนิยมที่สุดในประวัติศาสตร์มนุษยชาติ” ซึ่งใช้เวลาเพียงไม่กี่สัปดาห์ ก็แซงหน้าความสำเร็จของ Linux ตลอด 30 ปีที่ผ่านมา 黄仁勋 กล่าวตรงๆ ว่า OpenClaw เป็น “ระบบปฏิบัติการ” ของคอมพิวเตอร์ Agent

黄仁勋 ยืนยันว่า:

ทุกบริษัท SaaS จะกลายเป็นบริษัท AaaS (Agent-as-a-Service) อย่างไม่ต้องสงสัย เพื่อให้ Agent ที่สามารถเข้าถึงข้อมูลสำคัญและรันโค้ดได้ปลอดภัย 英伟达 จัดทำ NeMo Claw เป็นแบบอย่างสำหรับการออกแบบอ้างอิงระดับองค์กร เพิ่มกลไกนโยบายและเราท์เตอร์ความเป็นส่วนตัว

สำหรับคนธรรมดาในสายงาน 黄仁勋 วาดภาพอนาคตของที่ทำงานไว้ว่า:

ในอนาคต พนักงานวิศวกรของบริษัทแต่ละคนจะมีงบ Token รายปี รายได้พื้นฐานอาจเป็นหลายแสนดอลลาร์ ผมจะจัดสรรประมาณครึ่งหนึ่งของเงินเดือนเป็น Token ให้พวกเขา เพื่อให้พวกเขาทำงานได้ 10 เท่า นี่คือกลยุทธ์การรับสมัครงานใหม่ของ Silicon Valley: ในข้อเสนอของคุณมี Token เท่าไหร่?

ในช่วงท้าย สุนทรพจน์ 黄仁勋 ยัง “เปิดเผย” โครงสร้างการคำนวณรุ่นต่อไป Feynman ซึ่งจะเป็นครั้งแรกที่รองรับการขยายระดับร่วมกันของทองแดงและ CPO และที่น่าตื่นเต้นยิ่งกว่านั้น 英伟达 กำลังพัฒนาและวางแผนระบบคอมพิวเตอร์ในอวกาศ “Vera Rubin Space-1” ซึ่งจะเปิดโอกาสให้ AI คำนวณในอวกาศอย่างเต็มที่

全文演讲:

主持人: ยินดีต้อนรับสู่เวทีของ黄仁勋 ผู้ก่อตั้งและซีอีโอของ英伟达

黄仁勋:

ยินดีต้อนรับเข้าสู่ GTC ผมอยากเตือนทุกคนว่านี่คือการประชุมด้านเทคโนโลยี ผมดีใจมากที่เห็นผู้คนต่อแถวเข้าร่วมตั้งแต่เช้า และได้เห็นทุกท่านในที่นี้

ใน GTC เราจะเน้นสามหัวข้อหลัก: เทคโนโลยี, แพลตฟอร์ม และระบบนิเวศ 英伟达 ปัจจุบันมีสามแพลตฟอร์มหลัก: CUDA-X, ระบบแพลตฟอร์ม และแพลตฟอร์มโรงงาน AI รุ่นล่าสุดของเรา

ก่อนเริ่ม ผมขอขอบคุณพิธีกรในช่วงเปิดตัว — Sarah Guo จาก Conviction, Alfred Lin จาก Sequoia (นักลงทุนรายแรกของ英伟达), และ Gavin Baker ซึ่งเป็นนักลงทุนหลักรายแรกของเรา ทั้งสามมีความเข้าใจลึกซึ้งด้านเทคโนโลยีและมีอิทธิพลในระบบนิเวศเทคโนโลยีอย่างกว้างขวาง แน่นอน ผมยังขอขอบคุณแขกผู้มีเกียรติทุกท่านที่ได้รับเชิญด้วยตัวเองจากผม ขอบคุณทีมดาราในวันนี้

ผมยังขอขอบคุณบริษัทต่างๆ ที่เข้าร่วมงานนี้ ตัว英伟达 เป็นบริษัทแพลตฟอร์ม เรามีเทคโนโลยี แพลตฟอร์ม และระบบนิเวศที่หลากหลาย ตัวแทนจากบริษัทในอุตสาหกรรมมูลค่ากว่า 100 ล้านล้านดอลลาร์ เข้าร่วมงานนี้กว่า 450 บริษัท ขอแสดงความขอบคุณอย่างสุดซึ้ง

งานนี้มีการบรรยายเทคนิค 1,000 หัวข้อ โดยมีวิทยากร 2,000 คน ครอบคลุมทุกชั้นของสถาปัตยกรรม “ห้าชั้นของ AI” — ตั้งแต่โครงสร้างพื้นฐาน เช่น ที่ดิน, ไฟฟ้า, ศูนย์ข้อมูล ไปจนถึงชิป, แพลตฟอร์ม, โมเดล และสุดท้ายคือแอปพลิเคชันที่ผลักดันอุตสาหกรรมให้เติบโต

CUDA: สะสมความรู้ 20 ปี

จุดเริ่มต้นอยู่ที่นี่ ปีนี้เป็นครบรอบ 20 ปีของ CUDA

ตลอด 20 ปีที่ผ่านมา เรามุ่งมั่นพัฒนาสถาปัตยกรรมนี้ CUDA เป็นนวัตกรรมปฏิวัติ — เทคโนโลยี SIMT (Single Instruction Multiple Thread) ช่วยให้นักพัฒนาสามารถเขียนโปรแกรมด้วยโค้ดแบบสเกลาร์ แล้วขยายเป็นแอปพลิเคชันมัลติเทรด ซึ่งง่ายกว่าการใช้สถาปัตยกรรม SIMD เดิมมาก ล่าสุด เรายังเพิ่มฟีเจอร์ Tiles เพื่อช่วยให้นักพัฒนาสามารถเขียนโปรแกรม Tensor Core ได้ง่ายขึ้น รวมถึงโครงสร้างคณิตศาสตร์ต่างๆ ที่ AI ต้องการ ปัจจุบัน CUDA มีเครื่องมือ คอมไพเลอร์ เฟรมเวิร์ก และไลบรารีนับหมื่นรายการ ในชุมชนโอเพนซอร์สมีโปรเจกต์เปิดเผยเป็นแสนรายการ และได้ฝังตัวเข้าไปในทุกระบบนิเวศเทคโนโลยี

แผนภาพนี้แสดงกลยุทธ์ 100% ของ英伟达 ซึ่งผมได้อธิบายมาตลอด จุดที่ยากที่สุดและสำคัญที่สุด คือ “ปริมาณการติดตั้ง” ที่สะสมมานาน 20 ปี เรามี GPU และระบบคำนวณที่รัน CUDA อยู่ในทั่วโลกนับร้อยล้านชิ้น

GPU ของเรา ครอบคลุมทุกคลาวด์แพลตฟอร์ม ให้บริการกับผู้ผลิตคอมพิวเตอร์และอุตสาหกรรมเกือบทุกแห่ง ปริมาณการติดตั้งนี้เป็นแรงผลักดันให้วงจรนี้หมุนเร็วขึ้น นักพัฒนาสร้างอัลกอริธึมใหม่ๆ และบรรลุความก้าวหน้า ตลาดใหม่เกิดขึ้น ระบบนิเวศใหม่ก็เกิดขึ้นตาม ปริมาณการติดตั้งก็เพิ่มขึ้นเรื่อยๆ — วงจรนี้กำลังเร่งตัวขึ้นเรื่อยๆ

ยอดดาวน์โหลดไลบรารีของ英伟达 เพิ่มขึ้นอย่างรวดเร็วและต่อเนื่อง วงจรนี้ทำให้แพลตฟอร์มคำนวณของเรา รองรับแอปพลิเคชันจำนวนมหาศาลและความก้าวหน้าใหม่ๆ อย่างไม่หยุดยั้ง

ที่สำคัญที่สุด มันยังให้อายุการใช้งานของโครงสร้างพื้นฐานเหล่านี้ยาวนานมาก เพราะแอปพลิเคชันบน NVIDIA CUDA มีความหลากหลาย ครอบคลุมทุกช่วงของวงจรชีวิต AI, แพลตฟอร์มข้อมูล และตัวแก้สมการทางวิทยาศาสตร์ ดังนั้น เมื่อคุณติดตั้ง GPU ของ英伟达 แล้ว มูลค่าการใช้งานจริงสูงมาก นี่คือเหตุผลที่ GPU ของเรา ซึ่งเปิดตัวเมื่อหกปีก่อนในสถาปัตยกรรม Ampere ราคาบนคลาวด์ กลับเพิ่มขึ้นในช่วงหลายปีที่ผ่านมา

ทั้งหมดนี้เกิดจากปริมาณการติดตั้งที่มาก วงจรที่แข็งแกร่ง และระบบนิเวศที่กว้างขวาง เมื่อปัจจัยเหล่านี้ทำงานร่วมกัน พร้อมกับการอัปเดตซอฟต์แวร์อย่างต่อเนื่อง ต้นทุนการคำนวณจะลดลงเรื่อยๆ การเร่งความเร็วในการคำนวณช่วยเพิ่มประสิทธิภาพแอปพลิเคชันอย่างมาก และเมื่อเราบำรุงรักษาและปรับปรุงซอฟต์แวร์อย่างต่อเนื่อง ผู้ใช้จะได้รับประโยชน์จากการเพิ่มขึ้นของประสิทธิภาพในช่วงแรก และยังคงลดต้นทุนการคำนวณได้ในระยะยาว เราพร้อมสนับสนุน GPU ทุกชิ้นทั่วโลกในระยะยาว เพราะโครงสร้างนี้เข้ากันได้อย่างสมบูรณ์

เหตุผลที่เรายังทำเช่นนี้ เพราะปริมาณการติดตั้งมหาศาล — ทุกครั้งที่เราอัปเดตซอฟต์แวร์ จะเป็นประโยชน์ต่อผู้ใช้หลายล้านคน วงจรนี้ทำให้สถาปัตยกรรม英伟达 ขยายการครอบคลุมอย่างต่อเนื่อง เร่งการเติบโตของตัวเอง และลดต้นทุนการคำนวณลงในที่สุด ซึ่งเป็นแรงผลักดันให้เกิดการเติบโตใหม่ CUDA จึงเป็นหัวใจสำคัญของทุกสิ่งนี้

จาก GeForce สู่ CUDA: 25 ปีแห่งวิวัฒนาการ

เส้นทางของเรากับ CUDA เริ่มต้นตั้งแต่ 25 ปีก่อน

GeForce — เชื่อว่าทุกคนในนี้เติบโตมากับ GeForce เป็นโครงการส่งเสริมการตลาดที่ประสบความสำเร็จที่สุดของ英伟达 เราเริ่มสร้างฐานลูกค้าในช่วงที่คุณยังซื้อสินค้าไม่ไหว — พ่อแม่ของคุณแทนคุณกลายเป็นผู้ใช้英伟达 รายแรกๆ ซื้อผลิตภัณฑ์ของเราเป็นปีๆ จนวันหนึ่ง คุณเติบโตเป็นนักวิทยาศาสตร์คอมพิวเตอร์ที่เก่งกาจ กลายเป็นลูกค้าและนักพัฒนาตัวจริง

นี่คือรากฐานที่ GeForce วางไว้ 25 ปีที่ผ่านมา 25 ปีที่แล้ว เราคิดค้น “Shader Program” ซึ่งเป็นนวัตกรรมที่เปลี่ยนเกมให้กลายเป็นอุปกรณ์เร่งความเร็วที่สามารถเขียนโปรแกรมได้ — เป็นอุปกรณ์เร่งความเร็วแบบโปรแกรมได้ตัวแรกของโลก นั่นคือ Pixel Shader สองสามปีต่อมา เราได้สร้าง CUDA ซึ่งเป็นการลงทุนที่สำคัญที่สุดของเราในประวัติศาสตร์ ตอนนั้นบริษัทมีงบประมาณจำกัด แต่เราทุ่มเทกำไรส่วนใหญ่ให้กับมัน เพื่อขยาย CUDA จาก GeForce ไปสู่ทุกคอมพิวเตอร์ เราเชื่อมั่นในศักยภาพของมัน แม้ในช่วงแรกจะลำบาก แต่เรายืนหยัดในความเชื่อนี้เป็นเวลา 13 รุ่น รวม 20 ปี ปัจจุบัน CUDA ได้กลายเป็นสิ่งที่แพร่หลายอย่างไม่หยุดยั้ง

Pixel Shader ได้ผลักดันให้ GeForce ปฏิวัติวงการ และประมาณ 8 ปีที่แล้ว เราเปิดตัว RTX ซึ่งเป็นการปฏิวัติสถาปัตยกรรมกราฟิกคอมพิวเตอร์ยุคใหม่ GeForce ทำให้ CUDA เข้าถึงทั่วโลก และจากนั้น นักวิชาการอย่าง Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton, Andrew Ng ก็พบว่า GPU สามารถเป็นเครื่องมือเร่งความเร็วในการเรียนรู้เชิงลึก จนเกิดปรากฏการณ์ AI ระลอกใหญ่เมื่อสิบปีก่อน

สิบปีที่แล้ว เราตัดสินใจผสมผสานการเร่งความเร็วแบบโปรแกรมได้เข้ากับแนวคิดใหม่สองอย่าง: หนึ่งคือ การติดตามแสงแบบ Ray Tracing ซึ่งเป็นเทคโนโลยีที่ท้าทายมาก สองคือ แนวคิดล่วงหน้าที่มองว่า AI จะเปลี่ยนแปลงการสร้างภาพคอมพิวเตอร์อย่างสิ้นเชิง เมื่อ GeForce ทำให้ AI เข้าถึงทั่วโลก AI ก็จะกลับมาปรับเปลี่ยนวิธีการสร้างภาพคอมพิวเตอร์ใหม่ทั้งหมด

วันนี้ ผมจะนำเสนออนาคต นั่นคือเทคโนโลยีกราฟิกรุ่นใหม่ของเรา ซึ่งเราเรียกว่า Neural Rendering — การผสมผสานลึกซึ้งระหว่าง 3D Graphics กับ AI นั่นคือ DLSS 5 ดูกันเลย

Neural Rendering: การผสมผสานข้อมูลเชิงโครงสร้างและ Generative AI

นี่เป็นสิ่งที่น่าทึ่งไหม? กราฟิกคอมพิวเตอร์จะฟื้นคืนชีพอีกครั้ง

เราทำอะไร? เราผสมผสาน 3D ที่สามารถควบคุมได้ (พื้นฐานของโลกเสมือน) กับข้อมูลเชิงโครงสร้าง แล้วผนวกกับ Generative AI และการคำนวณแบบความน่าจะเป็น หนึ่งคือความแน่นอน อีกหนึ่งคือความสมจริงสูง — เรารวมสองแนวคิดนี้เข้าด้วยกัน โดยใช้ข้อมูลเชิงโครงสร้างเพื่อความแม่นยำและควบคุมได้อย่างแม่นยำ ในขณะเดียวกันก็สร้างเนื้อหาแบบเรียลไทม์ ผลลัพธ์คือ เนื้อหาที่สวยงามและน่าทึ่ง แต่ก็สามารถควบคุมได้อย่างสมบูรณ์

แนวคิดการผสมผสานข้อมูลเชิงโครงสร้างและ Generative AI นี้ จะถูกนำไปใช้ในอุตสาหกรรมต่างๆ อย่างต่อเนื่อง ข้อมูลเชิงโครงสร้างเป็นรากฐานของ AI ที่เชื่อถือได้

แพลตฟอร์มเร่งความเร็วสำหรับข้อมูลเชิงโครงสร้างและไม่เชิงโครงสร้าง

ตอนนี้ ผมจะพาทุกท่านดูภาพสถาปัตยกรรมเทคโนโลยี

ข้อมูลเชิงโครงสร้าง — คุ้นเคยกันดีใน SQL, Spark, Pandas, Velox รวมถึงแพลตฟอร์มสำคัญอย่าง Snowflake, Databricks, Amazon EMR, Azure Fabric, Google BigQuery — ทั้งหมดนี้จัดการกับ Data Frame ซึ่งเป็นเหมือนตารางอิเล็กทรอนิกส์ขนาดใหญ่ที่บรรจุข้อมูลสำคัญของธุรกิจ เป็นความจริงพื้นฐานขององค์กร

ในยุค AI เราต้องทำให้ AI ใช้ข้อมูลเชิงโครงสร้างเหล่านี้ได้อย่างรวดเร็วที่สุด ในอดีต การเร่งความเร็วการประมวลผลข้อมูลเชิงโครงสร้างเพื่อให้ธุรกิจดำเนินไปอย่างมีประสิทธิภาพ แต่ในอนาคต AI จะใช้ข้อมูลเหล่านี้ด้วยความเร็วที่เหนือกว่ามนุษย์อย่างมาก และ Agent ก็จะเรียกใช้ฐานข้อมูลเชิงโครงสร้างจำนวนมาก

ด้านข้อมูลไม่เชิงโครงสร้าง เช่น ฐานข้อมูลเวกเตอร์ PDF วิดีโอ เสียง ฯลฯ เป็นข้อมูลส่วนใหญ่ของโลก — ในแต่ละปี ข้อมูลไม่เชิงโครงสร้างคิดเป็นประมาณ 90% ของข้อมูลทั้งหมด ในอดีต ข้อมูลเหล่านี้แทบจะไม่สามารถใช้งานได้เลย เราอ่านเข้าไป จัดเก็บไว้ในไฟล์เท่านั้น ไม่มีการค้นหา ไม่มีการดึงข้อมูล เนื่องจากข้อมูลไม่เชิงโครงสร้างขาดวิธีการทำดัชนีง่ายๆ ต้องเข้าใจความหมายและบริบทของมัน แต่ตอนนี้ AI ทำได้แล้ว — ด้วยเทคโนโลยีการรับรู้และเข้าใจแบบมัลโมดัล AI สามารถอ่าน PDF เข้าใจความหมาย และฝังเข้าไปในโครงสร้างที่สามารถค้นหาได้

英伟达 จัดสร้างไลบรารีพื้นฐานสองตัว:

- cuDF: สำหรับการเร่งความเร็วการจัดการ Data Frame และข้อมูลเชิงโครงสร้าง

- cuVS: สำหรับการจัดเก็บเวกเตอร์ ข้อมูลเชิงความหมาย และข้อมูล AI ไม่เชิงโครงสร้าง

สองแพลตฟอร์มนี้จะกลายเป็นหนึ่งในแพลตฟอร์มพื้นฐานสำคัญในอนาคต

วันนี้ เรายังประกาศความร่วมมือกับหลายบริษัท IBM — ผู้คิดค้นภาษา SQL จะใช้ cuDF เร่งความเร็วแพลตฟอร์ม WatsonX Data ของตน Dell ร่วมกับเรา สร้างแพลตฟอร์มข้อมูล AI ของ Dell รวมทั้งปรับปรุงประสิทธิภาพในโครงการจริงของ NTT Data Google Cloud — เราเร่งความเร็วทั้ง Vertex AI และ BigQuery และร่วมกับ Snapchat ลดต้นทุนการคำนวณลงเกือบ 80%

การเร่งความเร็วในการคำนวณให้ประโยชน์สามประการ: ความเร็ว, ขนาด, ต้นทุน ซึ่งเป็นแนวคิดเดียวกับกฎของ Moore — การเร่งความเร็วในการคำนวณ ทำให้ประสิทธิภาพเพิ่มขึ้น และปรับปรุงอัลกอริธึมอย่างต่อเนื่อง ทำให้ทุกคนสามารถลดต้นทุนการคำนวณได้อย่างต่อเนื่อง

英伟达 สร้างแพลตฟอร์มการคำนวณเร่งความเร็ว ซึ่งรวบรวมไลบรารีต่างๆ เช่น RTX, cuDF, cuVS เป็นต้น ไลบรารีเหล่านี้ถูกรวมเข้าในคลาวด์และ OEM ทั่วโลก เพื่อให้เข้าถึงผู้ใช้ทั่วโลก

ความร่วมมือเชิงลึกกับผู้ให้บริการคลาวด์

ความร่วมมือกับผู้ให้บริการคลาวด์หลัก

Google Cloud: เราเร่งความเร็ว Vertex AI และ BigQuery ผนวกกับ JAX/XLA ซึ่ง英伟达 เป็นเพียงผู้เดียวที่ทำงานได้ดีทั้งใน PyTorch และ JAX/XLA เรานำลูกค้าเช่น Base10, CrowdStrike, Puma, Salesforce เข้าสู่ระบบนิเวศของ Google Cloud

AWS: เราเร่งความเร็ว EMR, SageMaker และ Bedrock ซึ่งมีความลึกซึ้งในความร่วมมือ ปีนี้ผมรู้สึกตื่นเต้นมาก เพราะเราจะนำ OpenAI เข้าสู่ AWS ซึ่งจะช่วยผลักดันการใช้คลาวด์ของ AWS ให้เติบโตอย่างมาก ช่วยให้ OpenAI ขยายการให้บริการในภูมิภาคและขยายขนาดการคำนวณ

Microsoft Azure: 超算 100 PFLOPS ของ英伟达 เป็น超算เครื่องแรกที่สร้างขึ้น และเป็น超算เครื่องแรกที่ติดตั้งบน Azure ซึ่งเป็นรากฐานสำคัญของความร่วมมือกับ OpenAI เราเร่งความเร็วบริการคลาวด์ Azure และ AI Foundry ร่วมกันขยายพื้นที่ให้บริการ Azure และทำงานร่วมกันใน Bing Search ซึ่งความสามารถ Confidential Computing ของเรา — ทำให้แม้แต่ผู้ให้บริการก็ไม่สามารถดูข้อมูลและโมเดลของผู้ใช้ได้ — GPU ของ英伟达 เป็น GPU ตัวแรกที่รองรับ Confidential Computing ซึ่งสามารถรองรับการติดตั้งโมเดลของ OpenAI และ Anthropic ในคลาวด์ทั่วโลก ตัวอย่างเช่น การเร่งความเร็ว EDA และ CAD ของ Synopsys ก็ทำบน Azure

Oracle: เราเป็นลูกค้ารายแรกของ Oracle ในด้าน AI ผมภูมิใจที่ได้อธิบายแนวคิด AI Cloud ให้ Oracle ฟัง จากนั้น Oracle ก็เติบโตอย่างรวดเร็ว เราก็นำ Cohere, Fireworks, OpenAI และพันธมิตรอื่นๆ เข้าสู่ระบบของพวกเขา

CoreWeave: คลาวด์ AI ที่เป็นเจ้าของโดยเน้น GPU เป็นหลัก มีลูกค้าชั้นนำและเติบโตอย่างรวดเร็ว

Palantir + Dell: ร่วมกันสร้างแพลตฟอร์ม AI ใหม่ ซึ่งอิงกับแพลตฟอร์ม Ontology ของ Palantir และแพลตฟอร์ม AI ที่สามารถติดตั้งในทุกประเทศ ทุกสภาพแวดล้อมแบบแยกอากาศ (air-gapped) ได้อย่างสมบูรณ์ ตั้งแต่การประมวลผลข้อมูล (เวกเตอร์หรือเชิงโครงสร้าง) ไปจนถึงการเร่งความเร็ว AI ทั้งหมด

英伟达 ได้สร้างความสัมพันธ์เชิงลึกกับผู้ให้บริการคลาวด์ทั่วโลก — นำลูกค้าเข้าสู่คลาวด์ เป็นระบบนิเวศที่เป็นประโยชน์ร่วมกัน

การบูรณาการแนวตั้งและการเปิดกว้างแนวนอน: กลยุทธ์หลักของ英伟达

英伟达 เป็นบริษัทแรกในโลกที่บูรณาการแนวตั้งและเปิดกว้างแนวนอน

โมเดลนี้มีเหตุผลง่ายๆ: การเร่งความเร็วในการคำนวณไม่ใช่แค่ปัญหาเกี่ยวกับชิปหรือระบบ แต่คือการเร่งความเร็วของแอปพลิเคชัน เทคโนโลยี CPU ช่วยให้คอมพิวเตอร์ทำงานได้เร็วขึ้น แต่ตอนนี้ถึงจุดอิ่มตัวแล้ว ในอนาคต การเร่งความเร็วเฉพาะด้านหรือเฉพาะกลุ่ม จะเป็นกุญแจสำคัญในการสร้างความก้าวหน้าและลดต้นทุนอย่างต่อเนื่อง

นี่คือเหตุผลที่英伟达 ต้องลงลึกในแต่ละไลบรารี แต่ละอุตสาหกรรม แต่ละภาคส่วน เราเป็นบริษัทที่บูรณาการแนวตั้งอย่างเต็มที่ ไม่มีทางเลือกอื่น เราต้องเข้าใจแอปพลิเคชัน เข้าใจอุตสาหกรรม และเข้าใจอัลกอริธึมอย่างลึกซึ้ง แล้วสามารถนำไปใช้ในทุกบริบท — ทั้งศูนย์ข้อมูล, คลาวด์, ระบบในเครื่อง, ขอบเขต และหุ่นยนต์

ในเวลาเดียวกัน เราก็เปิดกว้างในแนวนอน พร้อมที่จะบูรณาการเทคโนโลยีของเราเข้าสู่แพลตฟอร์มของพันธมิตร เพื่อให้ทุกคนทั่วโลกได้รับประโยชน์จากการเร่งความเร็วในการคำนวณ

โครงสร้างผู้เข้าร่วมงาน GTC ครั้งนี้ สะท้อนให้เห็นสิ่งนี้อย่างชัดเจน ในกลุ่มผู้เข้าร่วมสูงสุดคือกลุ่มบริการทางการเงิน — ซึ่งเป็นกลุ่มนักพัฒนามากกว่าผู้เทรด ระบบนิเวศของเรา ครอบคลุมห่วงโซ่อุปทานทั้งบนและล่าง ไม่ว่าจะเป็นบริษัทที่ก่อตั้งมานาน 50, 70 หรือ 150 ปี ก็มีปีที่ดีที่สุดในประวัติศาสตร์เมื่อปีที่แล้ว เราอยู่จุดเริ่มต้นของสิ่งที่สำคัญมากๆ

CUDA-X: เครื่องยนต์เร่งความเร็วในแต่ละอุตสาหกรรม

ในแต่ละภาคส่วน 英伟达 ได้วางรากฐานอย่างลึกซึ้งแล้ว:

- ยานยนต์อัตโนมัติ: ครอบคลุมกว้างขวางและมีผลกระทบลึกซึ้ง

- การเงิน: การลงทุนเชิงปริมาณเปลี่ยนจากการสร้างคุณลักษณะด้วยมือ ไปสู่การใช้ Deep Learning ขับเคลื่อนด้วยซูเปอร์คอมพิวเตอร์ ซึ่งเข้าสู่ “Transformer Era”

- การแพทย์และสุขภาพ: กำลังเข้าสู่ “ช่วงเวลา ChatGPT” ของตัวเอง ครอบคลุม AI ช่วยค้นพบยา, AI ช่วยวินิจฉัย, บริการลูกค้าในด้านสุขภาพ ฯลฯ

- อุตสาหกรรม: การสร้างขนาดใหญ่ที่สุดในโลก กำลังเกิดขึ้น โรงงาน AI, โรงงานชิป, ศูนย์ข้อมูล ต่างก็เริ่มใช้งานแล้ว

- ความบันเทิงและเกม: แพลตฟอร์ม AI แบบเรียลไทม์ รองรับการแปลภาษา, ถ่ายทอดสด, โต้ตอบในเกม, ตัวแทนช็อปปิ้งอัจฉริยะ

- หุ่นยนต์: พัฒนามากว่า 10 ปี โครงสร้างคอมพิวเตอร์ 3 แบบ (ฝึก, จำลอง, บรรทุก) รวมกันในงานนี้ มีหุ่นยนต์ 110 รุ่นปรากฏตัว

- โทรคมนาคม: อุตสาหกรรมมูลค่า 2 ล้านล้านดอลลาร์ สถานีฐานจะเปลี่ยนจากแค่การสื่อสารเป็นแพลตฟอร์มโครงสร้างพื้นฐาน AI ซึ่งชื่อแพลตฟอร์มคือ Aerial ร่วมมือกับ Nokia, T-Mobile ฯลฯ

ทุกภาคส่วนนี้ ล้วนใช้ไลบรารี CUDA-X ซึ่งเป็นรากฐานของ英伟达 ในฐานะบริษัทด้านอัลกอริธึม ไลบรารีเหล่านี้คือสินทรัพย์หลักของบริษัท ทำให้แพลตฟอร์มคำนวณสามารถสร้างคุณค่าในแต่ละอุตสาหกรรมได้จริง

หนึ่งในไลบรารีสำคัญที่สุด คือ cuDNN (CUDA Deep Neural Network Library) ซึ่งปฏิวัติวงการ AI และเป็นจุดเริ่มต้นของ AI ยุคใหม่

(เล่นวิดีโอสาธิต CUDA-X)

ทุกสิ่งที่คุณเห็นเป็นการจำลอง — รวมถึงตัวแก้สมการทางฟิสิกส์ โมเดล AI สำหรับจำลองทางฟิสิกส์ และโมเดลหุ่นยนต์ทางฟิสิกส์ ทั้งหมดเป็นการจำลอง ไม่มีอนิเมชันหรือการผูกมัดข้อต่อใดๆ นี่คือความสามารถหลักของ英伟达: การเข้าใจลึกซึ้งในอัลกอริธึมและการผสานกับแพลตฟอร์มคำนวณอย่างเป็นระบบ ปลดล็อกโอกาสเหล่านี้

องค์กรธุรกิจ AI แบบเนทีฟและยุคใหม่ของการคำนวณ

คุณเพิ่งเห็น Walmart, L’Oréal, JPMorgan, Roche, Toyota และบริษัทชั้นนำอื่นๆ รวมถึงบริษัทที่คุณไม่เคยได้ยินชื่อ — เราเรียกพวกเขาว่า “องค์กร AI แบบเนทีฟ” รายชื่อนี้ใหญ่มาก มีทั้ง OpenAI, Anthropic และบริษัทใหม่ในแต่ละภาคส่วน

ในสองปีที่ผ่านมา อุตสาหกรรมนี้เติบโตอย่างรวดเร็ว การลงทุนในสตาร์ทอัพสูงถึง 150 พันล้านดอลลาร์ ซึ่งเป็นสถิติสูงสุดในประวัติศาสตร์ ยิ่งไปกว่านั้น การลงทุนรายเดียวก็เปลี่ยนจากหลักแสนดอลลาร์ เป็นหลักล้าน หลักสิบล้าน ดอลลาร์ เหตุผลเดียวคือ นี่เป็นครั้งแรกในประวัติศาสตร์ที่ทุกบริษัทในกลุ่มนี้ ต้องการการคำนวณจำนวนมาก และ Token ก็เป็นทั้งสิ่งที่สร้างและเพิ่มมูลค่าให้กับ AI ของพวกเขา

เช่นเดียวกับการปฏิวัติ PC, อินเทอร์เน็ต, โมบายล์ คอมพิวติ้ง ที่สร้างบริษัทยุคใหม่ขึ้นมา อุตสาหกรรมการคำนวณยุคนี้ก็จะสร้างบริษัทที่มีอิทธิพลในอนาคตเช่นกัน

สามความก้าวหน้าทางประวัติศาสตร์ที่ขับเคลื่อนทุกสิ่ง

สองปีที่ผ่านมา เกิดอะไรขึ้นบ้าง? มีสามเหตุการณ์สำคัญ

หนึ่ง: ChatGPT เปิดยุค Generative AI (ปลายปี 2022 ถึง 2023)

มันไม่ใช่แค่การรับรู้และเข้าใจ แต่สามารถสร้างเนื้อหาเฉพาะตัวได้ ผมแสดงให้เห็นว่าการผสมผสาน Generative AI กับกราฟิกคอมพิวเตอร์ เปลี่ยนแปลงวิธีการคำนวณอย่างรุนแรง — จากการค้นหาเป็นการสร้าง ซึ่งส่งผลต่อสถาปัตยกรรม, การปรับใช้ และความหมายโดยรวม

สอง: AI ที่สามารถสรุปผล (Reasoning AI), ตัวอย่างเช่น o1

ความสามารถในการสรุปผล ทำให้ AI สามารถสะท้อนความคิด วางแผน แยกแยะปัญหา — แบ่งปัญหาที่เข้าใจไม่ได้ให้เป็นขั้นตอนที่จัดการได้ง่ายขึ้น o1 ทำให้ Generative AI มีความน่าเชื่อถือ สามารถอ้างอิงข้อมูลจริงได้ เพื่อให้ทำเช่นนี้ ต้องใช้ Token สำหรับบริบทและผลลัพธ์ในการคิดมากขึ้น การคำนวณก็เพิ่มขึ้นอย่างมาก

สาม: Claude Code, โมเดล Agent ตัวแรก

มันสามารถอ่านไฟล์ เขียนโค้ด คอมไพล์ ทดสอบ และปรับปรุงใหม่ได้อย่างสมบูรณ์ Claude Code ปฏิวัติวิศ