BlockSec: AI еще не может заменить человека в аудите смарт-контрактов

Компания по безопасности BlockSec провела повторную проверку стандарта оценки аудита смарт-контрактов с помощью ИИ под названием EVMBench, разработанного OpenAI и Paradigm. Результаты показали, что боты ИИ значительно менее эффективны при столкновении с реальными сценариями эксплуатации.

Исследовательская группа расширила тестовую среду, добавив больше конфигураций моделей, а также включила новые недавние инциденты безопасности — данные, ранее не встречавшиеся в обучающей выборке моделей ИИ.

Хотя ИИ пока не может полностью заменить специалистов по безопасности, в отчёте подчеркивается, что машинный интеллект может играть естественную вспомогательную роль в процессе проверки кода человеком.

Первоначальные результаты EVMBench могут быть слишком оптимистичными

Ранее EVMBench оценивал задачи безопасности смарт-контрактов, такие как обнаружение, исправление ошибок и эксплуатация уязвимостей, с очень впечатляющими результатами. Согласно отчету, ИИ может эксплуатировать 72% уязвимостей и обнаруживать около 45%, на основе 120 выбранных образцов из аудитов Code4rena.

Однако BlockSec считает, что начальные условия тестирования могли исказить результаты. Соучредитель Йаjin Чжоу отметил, что при повторных испытаниях с большим числом конфигураций и 22 реальными инцидентами успешность эксплуатации ИИ составила 0%.

Расширение конфигураций и устранение «загрязнения данных»

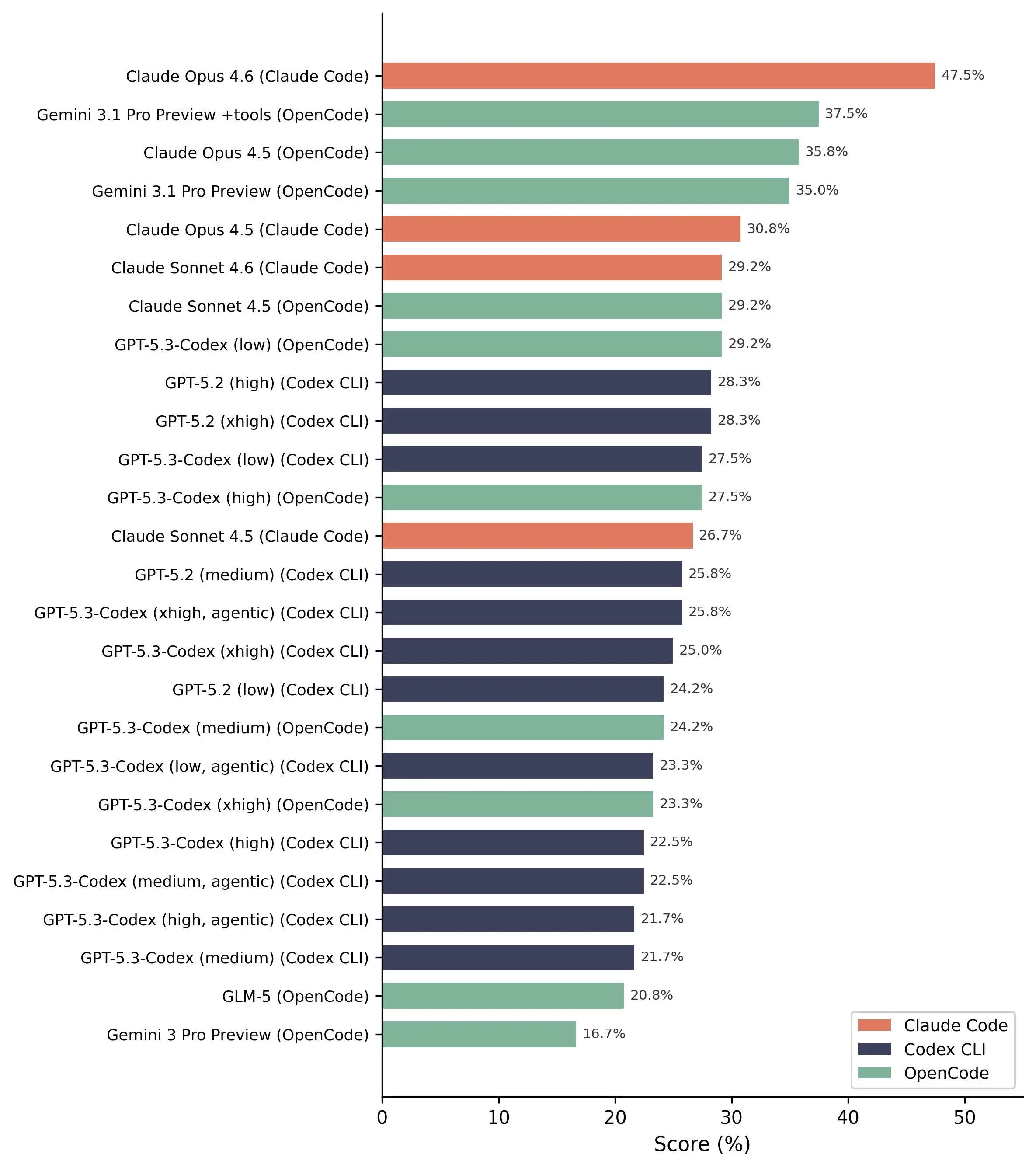

Исследование увеличило число конфигураций моделей с 14 до 26, гибко комбинируя ботов с разными «скелетами», а не ограничиваясь экосистемой одного поставщика. По словам исследовательской группы, старый подход затруднял различение эффективности, обусловленной возможностями модели или архитектурными преимуществами.

Кроме того, BlockSec усомнилась в явлении «загрязнения данных», поскольку EVMBench использовал уязвимости, опубликованные ранее — возможно, входившие в обучающие данные ИИ. Для устранения этого проблема команда протестировала 22 инцидента безопасности, произошедших после февраля 2026 года, которые выходили за рамки «окна знаний» моделей.

Полный провал ИИ в реальной эксплуатации

Самый заметный результат: из 110 пар тестов между агентами и инцидентами (5 агентов при 22 сценариях) ни один не завершился полностью успешной эксплуатацией. Это показывает, что даже самые передовые ИИ сегодня еще очень далеки от возможности осуществлять реальные атаки.

Тем не менее, в области обнаружения уязвимостей результаты остаются относительно положительными. Модель Claude Opus 4.6 показала лучший результат, обнаружив 13 из 20 уязвимостей в реальных сценариях.

Распространённые, хорошо известные уязвимости ИИ обнаруживает легко, а более сложные случаи почти полностью пропускает.

Будущее — это сотрудничество ИИ и человека

Исследование пришло к выводу, что ИИ пока не способен заменить человека в аудите безопасности, и более важный вопрос — как эффективно взаимодействовать двум сторонам.

ИИ обладает преимуществами в охвате и возможности сканировать крупные системы, тогда как человек превосходит в глубоком аналитическом мышлении, понимании протоколов и логическом выводе. Эти два элемента дополняют друг друга.

По мнению BlockSec, правильный путь — не замена человека ИИ, а создание модели сотрудничества для достижения более всесторонней эффективности аудита.