Juiz federal dos EUA bloqueia temporariamente a proibição da Anthropic pelo Pentágono.

Um juiz federal dos EUA em São Francisco concedeu o pedido da Anthropic por um alívio temporário após a designação da empresa pelo Pentágono como um risco para a cadeia de abastecimento.

Numa ordem na quinta-feira, a juíza Rita Lin do Tribunal de Distrito do Norte da Califórnia ordenou uma liminar contra o Pentágono sobre o rótulo. Também suspende temporariamente uma diretiva do Presidente dos EUA, Donald Trump, ordenando que as agências federais deixem de usar o chatbot da Anthropic, Claude.

“Nada na legislação vigente apoia a noção orwelliana de que uma empresa americana pode ser rotulada como um adversário potencial e saboteur dos EUA por expressar desacordo com o governo,” disse a juíza Lin.

A Anthropic era o principal jogador nos mercados de IA empresarial com 32%, à frente da OpenAI com 25%, em 2025, de acordo com a Menlo Ventures. Uma proibição em todo o governo sobre a Anthropic faria esta posição despencar.

A juíza disse que essas “amplas medidas punitivas” tomadas contra a Anthropic pela administração Trump e pelo Secretário de Defesa Pete Hegseth pareciam “arbitrárias, caprichosas, [e] um abuso de discrição.”

A ordem veio após a Anthropic ter apresentado uma ação judicial em um tribunal federal de Columbia no dia 9 de março, alegando que Hegseth ultrapassou sua autoridade ao designar a empresa como um risco de cadeia de abastecimento de segurança nacional.

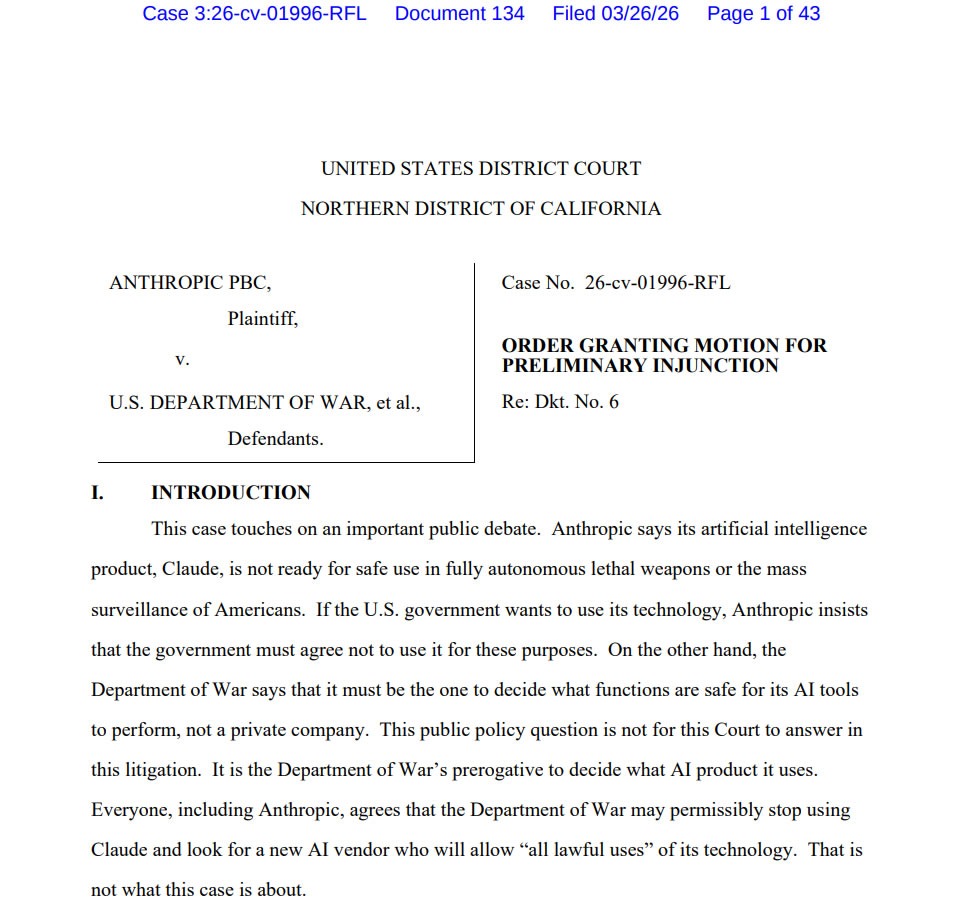

Captura de tela da decisão do tribunal. Fonte: Courtlistener

A Anthropic opôs-se a armas autônomas e vigilância em massa

A disputa decorre de um acordo em julho de 2025 entre a empresa de IA e o Pentágono sobre um contrato para tornar Claude o primeiro modelo de IA de fronteira aprovado para uso em redes classificadas.

As negociações desmoronaram em fevereiro, com o Pentágono buscando renegociar, insistindo que a Anthropic permitisse o uso militar de Claude “para todos os fins legais” e sem restrições.

A Anthropic manteve que sua tecnologia não deveria ser usada para armas autônomas letais e vigilância doméstica em massa de americanos.

No dia 27 de fevereiro, Trump ordenou que todas as agências federais cessem de usar produtos da Anthropic. “Os malucos de esquerda da Anthropic cometeram um ERRO DESASTROSO tentando FORÇAR o Departamento de Guerra,” ele escreveu no Truth Social.

Uma audiência judicial de 90 minutos ocorreu em São Francisco no dia 24 de março, durante a qual a juíza Lin pressionou os advogados do governo sobre se a Anthropic estava sendo punida por criticar publicamente o Pentágono.

Retaliação clássica ilegal da Primeira Emenda

“Punir a Anthropic por trazer escrutínio público à posição de contratação do governo é uma retaliação clássica ilegal da Primeira Emenda,” afirmou a decisão de 26 de março.

A Anthropic disse em um comunicado que estava “grata ao tribunal por agir rapidamente, e satisfeita por concordarem que a Anthropic é provável que tenha sucesso no mérito.”

**Revista: **__Ninguém sabe se a criptografia segura quântica funcionará

A Cointelegraph está comprometida com o jornalismo independente e transparente. Este artigo de notícias é produzido de acordo com a Política Editorial da Cointelegraph e visa fornecer informações precisas e oportunas. Os leitores são encorajados a verificar as informações de forma independente. Leia nossa Política Editorial https://cointelegraph.com/editorial-policy

- #IA

- #Tribunal

- #Donald Trump

- #Regulação