A AGI já está aqui? Nem perto disso, sugere novo benchmark de IA

Resumo

- ARC-AGI-3 revela uma enorme lacuna entre as alegações de AGI e a realidade, com os principais modelos de IA a pontuar abaixo de 1%, enquanto os humanos alcançam desempenho perfeito.

- O benchmark testa a verdadeira generalização — exigindo que os agentes explorem, planejem e aprendam do zero em ambientes desconhecidos, em vez de apenas recordar padrões treinados.

- Apesar do hype da indústria, os sistemas atuais de IA ainda estão longe de ser AGI, faltando-lhes o raciocínio e a adaptabilidade que até jovens humanos demonstram naturalmente.

O CEO da Nvidia, Jensen Huang, participou na semana passada no podcast de Lex Fridman e afirmou, claramente, “Acredito que alcançámos a AGI.” Dois dias depois, o teste mais rigoroso em pesquisa de IA lançou o seu mais recente benchmark de inteligência geral artificial — e todos os modelos de ponta pontuaram abaixo de 1%. A Fundação Prémio ARC lançou esta semana o ARC-AGI-3, e os resultados são brutais. O Gemini 3.1 Pro do Google liderou com 0,37%. O GPT-5.4 da OpenAI obteve 0,26%. O Claude Opus 4.6 da Anthropic conseguiu 0,25%, enquanto o Grok-4.20 da xAI pontuou exatamente zero. Os humanos, por outro lado, resolveram 100% dos ambientes. Isto não é um teste de trivialidades ou exame de codificação, nem mesmo perguntas ultra-difíceis de PhD. O ARC-AGI-3 é algo completamente diferente de tudo que a indústria de IA enfrentou antes.

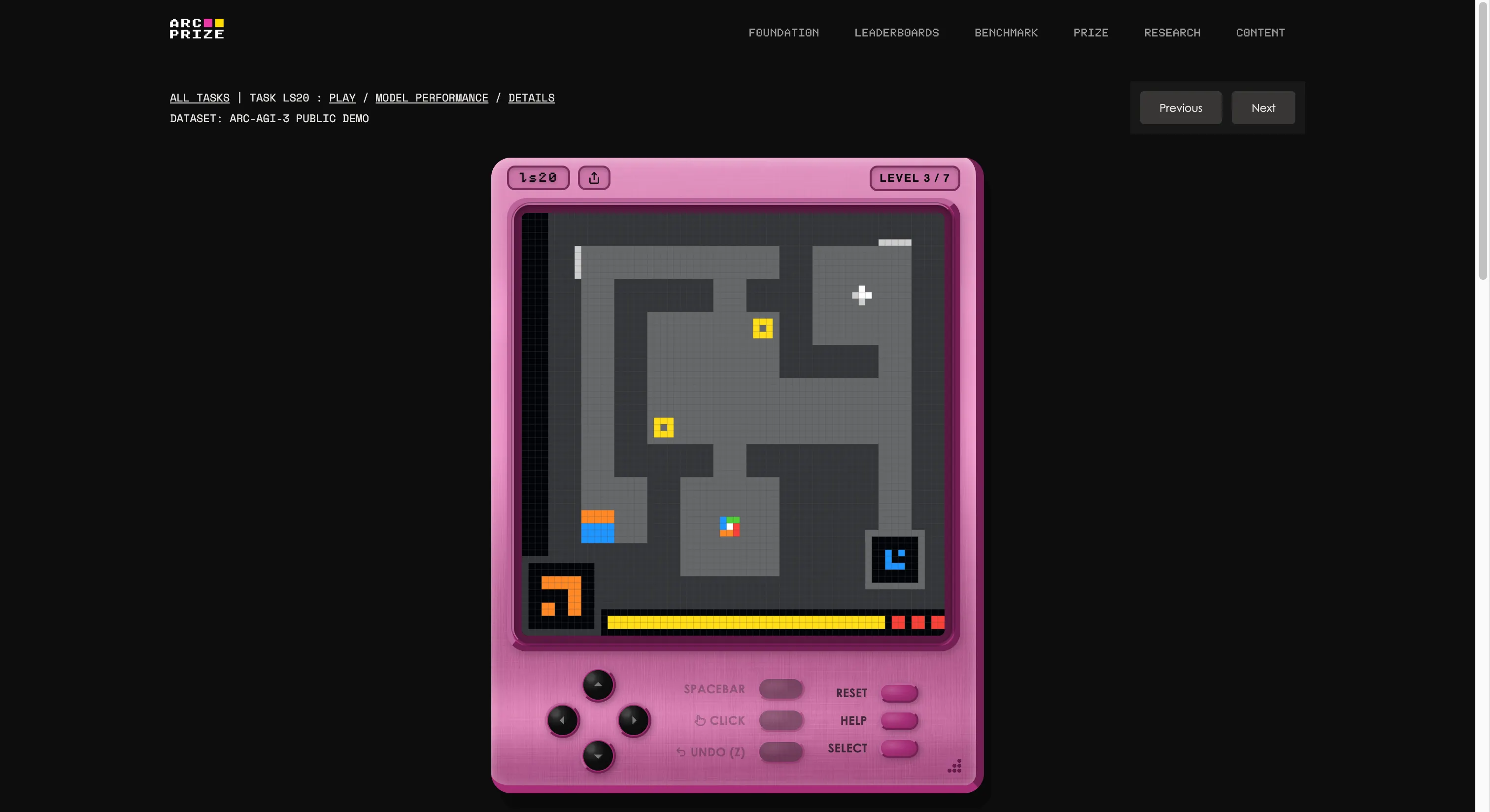

O benchmark foi criado pela fundação de François Chollet e Mike Knoop, que montaram um estúdio de jogos interno e criaram 135 ambientes interativos originais do zero. A ideia é colocar um agente de IA num mundo semelhante a um jogo, desconhecido, sem instruções, sem objetivos declarados e sem descrição das regras. O agente deve explorar, descobrir o que deve fazer, formar um plano e executá-lo. Se isso parece algo que qualquer criança de cinco anos consegue fazer, estás a começar a entender o problema. Se queres ver se és melhor que a IA, podes jogar os mesmos jogos utilizados no teste clicando neste link. Tentámos um; foi estranho à primeira, mas após alguns segundos, percebes facilmente como jogar.

Este é também o exemplo mais claro do que significa o “G” em AGI. Quando generalizas, és capaz de criar novo conhecimento (como funciona um jogo estranho) sem ter sido treinado previamente nele.

Versões anteriores do ARC testaram puzzles visuais estáticos — mostrar um padrão, prever o próximo. Eram difíceis no início. Depois, os laboratórios investiram poder computacional e treino até que os benchmarks se tornaram praticamente irrelevantes. O ARC-AGI-1, lançado em 2019, foi superado por modelos de treino e raciocínio em tempo de teste. O ARC-AGI-2 durou cerca de um ano até que o Gemini 3.1 Pro atingiu 77,1%. Os laboratórios são muito bons em saturar benchmarks contra os quais podem treinar. A versão 3 foi especificamente desenhada para impedir isso. Com 110 dos 135 ambientes mantidos privados — 55 semi-privados para testes de API, 55 totalmente bloqueados para competição — não há conjunto de dados para memorizar. Não é possível forçar uma solução através de lógica de jogo nova que nunca viste. A pontuação também não é de passar ou falhar. O ARC-AGI-3 usa o que a fundação chama RHAE — Eficiência Relativa de Ação Humana. A linha de base é o segundo melhor desempenho humano na primeira tentativa. Uma IA que precisa de dez vezes mais ações que um humano pontua 1% nesse nível, não 10%. A fórmula eleva ao quadrado a penalização pela ineficiência. Andar à volta, recuar e adivinhar o caminho para uma resposta é severamente punido. O melhor agente de IA na pré-visualização de um mês de duração obteve 12,58%. Os LLMs de ponta testados via API oficial, sem ferramentas personalizadas, não conseguiram passar de 1%. Os humanos comuns resolveram todos os 135 ambientes sem treino prévio nem instruções. Se esse é o padrão, então os modelos atuais ainda não o estão a atingir. Existe aqui um debate metodológico real. O relatório do ARC afirma que uma implementação personalizada construída na Duke levou o Claude Opus 4.6 de 0,25% para 97,1% numa única variante do ambiente chamada TR87. Isso não significa que o Claude tenha pontuado 97,1% no ARC-AGI-3 globalmente; a sua pontuação oficial no benchmark permaneceu em 0,25%, mas a mudança é digna de nota. O benchmark oficial fornece aos agentes código JSON, não visuais. Isso é uma falha metodológica ou uma demonstração de que os modelos atuais são melhores a processar informações amigáveis ao humano do que dados estruturados brutos. A fundação de Chollet reconheceu o debate, mas não vai alterar o formato. “Percepção do conteúdo do quadro e formato da API não são fatores limitantes para o desempenho dos modelos de ponta no ARC-AGI-3,” lê-se no documento. Em outras palavras, parecem rejeitar a ideia de que os modelos falham porque “não conseguem ver” as tarefas corretamente, argumentando que a percepção já é suficiente — e que a verdadeira lacuna está no raciocínio e na generalização.

O teste de realidade da AGI chegou numa semana em que a máquina de hype estava a todo vapor. Além do comentário de Huang, a Arm nomeou o seu novo chip de centro de dados como “CPU AGI”. O Sam Altman da OpenAI afirmou que eles “basicamente construíram a AGI”, e a Microsoft já está a promover um laboratório focado na construção de uma ASI: uma evolução do que vem depois de alcançar a AGI. O termo está a ser esticado até passar a significar qualquer coisa conveniente comercialmente, parece. A posição de Chollet é mais simples. Se um humano normal, sem instruções, consegue fazer, e o teu sistema não consegue, então não tens AGI — tens uma previsão de texto muito cara que precisa de muita ajuda. O ARC Prize 2026 oferece 2 milhões de dólares em três categorias de competição, todas hospedadas no Kaggle. Cada solução vencedora deve ser de código aberto. O tempo está a correr e, neste momento, as máquinas nem sequer estão perto disso.