Os três momentos de Anthropic: fuga de código, confronto com o governo e militarização

Título original: Anthropic: The Leak, The War, The Weapon

Autor original: BuBBliK

Compilação: Peggy,BlockBeats

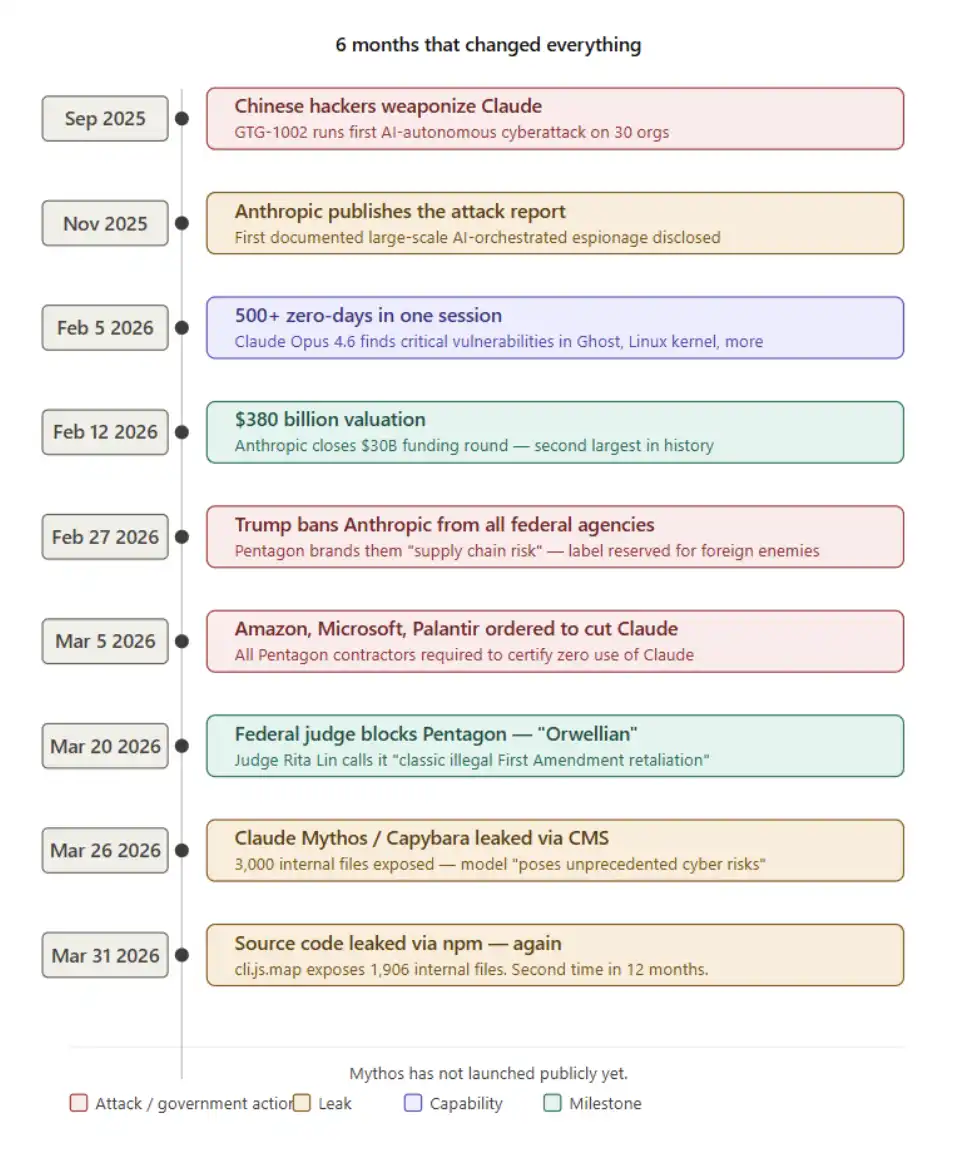

Nota do editor: Nos últimos seis meses, a Anthropic tem-se visto sucessivamente envolvida numa série de acontecimentos que parecem independentes entre si, mas que, na realidade, se apontam e convergem: um salto na capacidade dos modelos, ataques automatizados no mundo real, reações intensas dos mercados de capitais, confrontos públicos com o governo e, por várias vezes, fugas de informação desencadeadas por erros em configurações base. Ao colocar estas pistas lado a lado, elas desenham em conjunto uma direção de mudança mais clara.

Este artigo, ao tomar estes acontecimentos como ponto de entrada, percorre a trajetória contínua de uma empresa de IA na ultrapassagem tecnológica, na exposição aos riscos e na disputa pela governação, tentando responder a uma questão mais profunda: quando a capacidade de “descobrir vulnerabilidades” é amplificada ao máximo e se vai disseminando gradualmente, a própria cibersegurança consegue ainda manter a lógica de funcionamento original?

No passado, a segurança assentava na escassez de capacidades e nas limitações da mão de obra; mas, nas novas condições, a defesa e o ataque estão a girar em torno do mesmo conjunto de capacidades do modelo, e as fronteiras ficam cada vez mais difusas. Entretanto, as reações das instituições, dos mercados e das organizações continuam presas nos quadros antigos, não conseguindo acolher atempadamente esta mudança.

O foco deste artigo não é apenas a Anthropic em si, mas sim uma realidade maior que ela reflete: a IA não está apenas a mudar as ferramentas — está a mudar também os pressupostos sobre como a “segurança” se constitui.

A seguir, o texto original:

Quando uma empresa com uma avaliação de 380 mil milhões de dólares, que está em disputa com o Pentágono e ainda assim sai por cima, sobrevive ao primeiro ataque cibernético da história lançado por uma IA autónoma, e ainda revela internamente um modelo que até os próprios programadores dizem temer, chegando mesmo “por acidente” a publicar o código-fonte completo — somando tudo isto, o que é que aconteceria?

A resposta é precisamente o que está a acontecer agora. E o que é ainda mais inquietante é que a parte verdadeiramente mais perigosa, talvez, ainda não tenha ocorrido.

Revisão dos acontecimentos

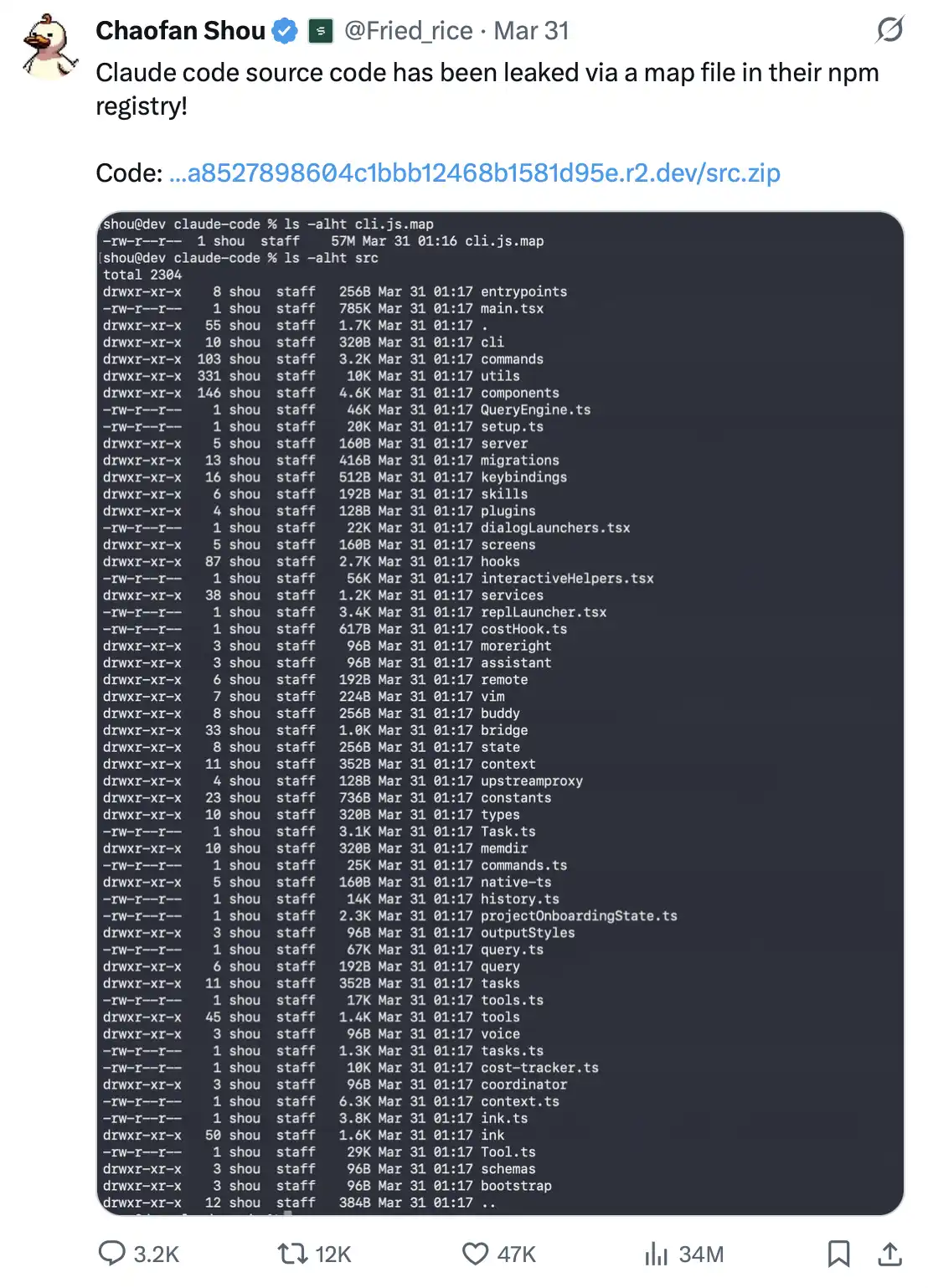

A Anthropic volta a vazar o seu próprio código

A 31 de março de 2026, o investigador de segurança Shou Chaofan, da empresa de blockchain Fuzzland, ao verificar o pacote npm Claude Code publicado oficialmente, encontrou o facto de que este contém, inclusivamente, de forma explícita, um ficheiro chamado cli.js.map.

Este ficheiro tem 60MB de tamanho, mas o conteúdo é ainda mais surpreendente. Quase contém todo o código-fonte TypeScript completo do produto. Apenas com este ficheiro, qualquer pessoa consegue reconstruir até 1906 ficheiros internos de código-fonte: incluindo o desenho da API interna, o sistema de telemetria, ferramentas de encriptação, lógica de segurança, sistema de plugins — quase todos os componentes centrais estão à vista. Mais importante ainda: estes conteúdos podem ser descarregados diretamente, em formato zip, a partir do próprio bucket R2 da Anthropic.

A descoberta espalhou-se rapidamente pelas redes sociais: em poucas horas, os posts relacionados atingiram 754 mil visualizações e quase 1000 partilhas; ao mesmo tempo, múltiplos repositórios GitHub com código reconstruído foram criados e publicados de imediato.

O chamado source map (ficheiro de mapeamento de origem) é, na essência, apenas um ficheiro auxiliar para depuração em JavaScript; o seu papel é reconstituir o código original a partir do código comprimido e compilado, para facilitar a identificação de problemas por parte dos programadores.

Mas existe um princípio básico: ele nunca deve ser incluído no pacote de publicação em ambiente de produção.

Isto não é nenhum tipo de ataque sofisticado, mas sim um problema mais básico de normas de engenharia — “Construção Configuração 101”, e até algo que os programadores aprendem na primeira semana. Se for embalado por engano para o ambiente de produção, um source map equivale frequentemente a “oferecer” o código-fonte a todos.

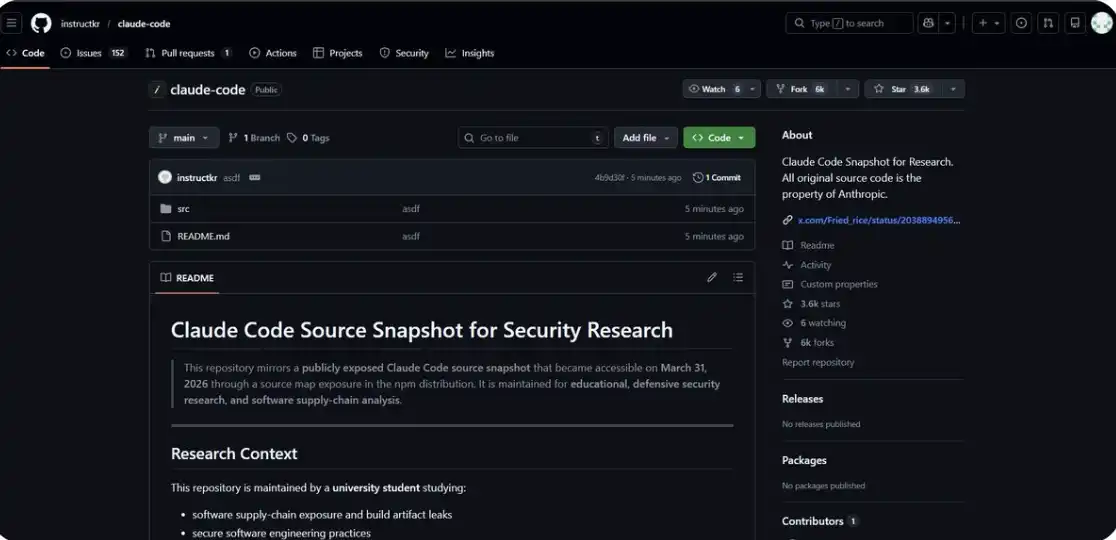

Também pode ver diretamente o código relacionado aqui: https://github.com/instructkr/claude-code

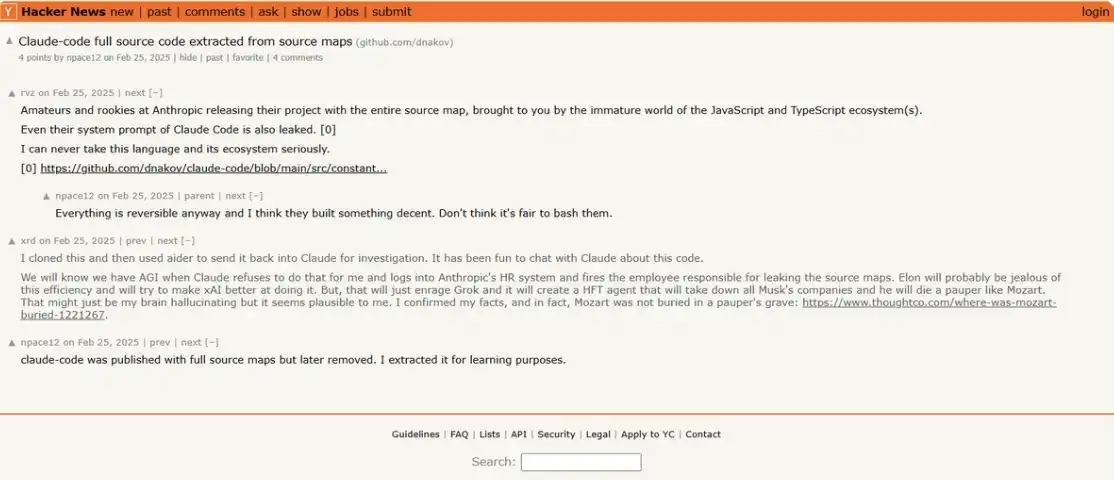

Mas o que torna a situação realmente absurda é o seguinte: isto já aconteceu uma vez.

Em fevereiro de 2025, exatamente um ano antes, ocorreu um vazamento quase idêntico: o mesmo ficheiro, o mesmo tipo de erro. Na altura, a Anthropic removeu a versão antiga do npm, retirou o source map e republicou uma nova versão, e o caso acabou por se acalmar.

O resultado: na versão v2.1.88, este ficheiro voltou a ser empacotado e publicado.

Uma empresa com uma avaliação de 380 mil milhões de dólares, a construir um dos sistemas de deteção de vulnerabilidades mais avançados do mundo, comete duas vezes, no espaço de um ano, o mesmo erro base. Não houve ataque de hackers, nem percursos de exploração complexos — foi apenas um problema no processo de construção que deveria funcionar normalmente.

Esta ironia quase tem um certo “cunho poético”.

A IA que consegue descobrir 500 zero-days numa única execução; o modelo usado para lançar ataques automatizados contra 30 instituições globais — e, ao mesmo tempo, a Anthropic “oferece em pacote” o seu próprio código-fonte, diretamente, a qualquer pessoa disposta a dar uma vista de olhos ao pacote npm.

Dois vazamentos, com apenas sete dias de diferença.

Mas as razões são as mesmas: o erro de configuração mais básico. Não exige qualquer limiar técnico, nem um percurso de exploração complexo. Basta saber onde procurar para qualquer pessoa obter gratuitamente.

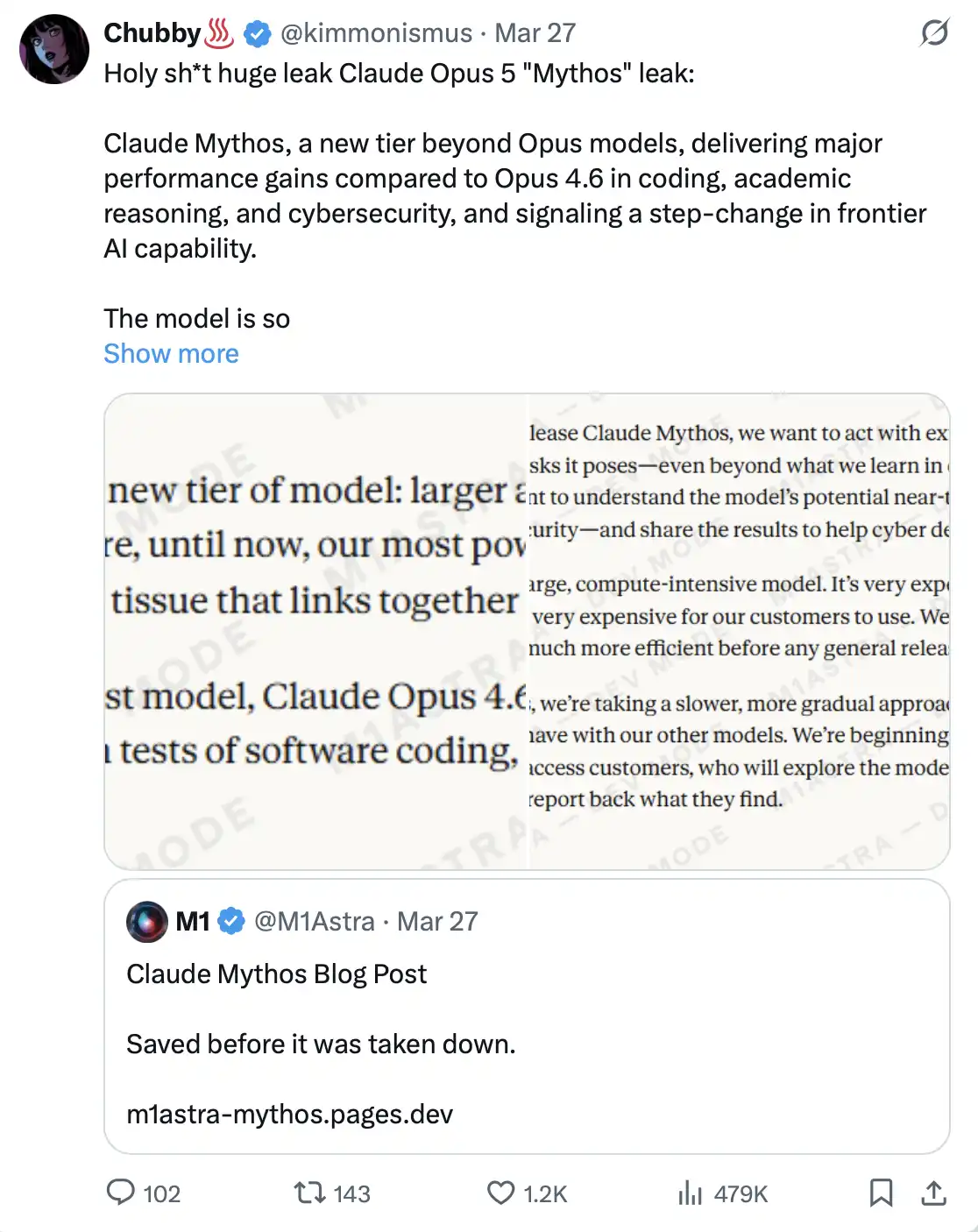

Há uma semana: exposição acidental do “modelo perigoso” interno

A 26 de março de 2026, investigadores de segurança da LayerX Security, Roy Paz, e Alexandre Pauwels, da University of Cambridge, descobriram um problema na configuração do CMS no site oficial da Anthropic, que levou a que cerca de 3000 documentos internos ficassem acessíveis.

Esses documentos incluem: rascunhos de blogues, PDFs, documentos internos, materiais de apresentação — todos expostos num repositório de dados sem proteção e pesquisável. Sem ataque de hackers, e sem necessidade de quaisquer meios técnicos.

Entre estes documentos, há dois rascunhos de blogue quase completamente idênticos, com a única diferença sendo o nome do modelo: um escrito como “Mythos” e o outro como “Capybara”.

Isto significa que, naquela altura, a Anthropic estava a escolher entre dois nomes para o mesmo projeto secreto. A empresa confirmou posteriormente: o treino desse modelo já estava concluído e tinha começado a ser testado com parte dos primeiros clientes.

Isto não foi uma atualização convencional do Opus, mas sim um novo modelo de “nível quatro”, cujo posicionamento é até acima do próprio Opus, segundo a sua descrição.

Nos próprios rascunhos da Anthropic, ele é descrito como: “Maior e mais inteligente do que os nossos modelos Opus — e o Opus continua a ser, até agora, o nosso modelo mais forte.” Em capacidades de programação, raciocínio académico e cibersegurança, entre outras áreas, registou avanços significativos. Um porta-voz referiu-o como “um salto qualitativo”, e também como “o modelo mais forte que já construímos”.

Mas o que realmente merece atenção não são, em si, estas descrições de desempenho.

Nos rascunhos vazados, a avaliação da Anthropic sobre este modelo é a seguinte: ele “introduz riscos de cibersegurança sem precedentes”, “supera, em capacidades de rede, qualquer outro modelo de IA”, e “antecipa uma vaga de modelos prestes a chegar — e a sua capacidade de explorar vulnerabilidades excederá muito a velocidade de resposta dos defensores”.

Por outras palavras, num rascunho de blog oficial ainda não publicado, a Anthropic já expressou de forma clara uma posição rara: está inquieta com o produto que está a construir.

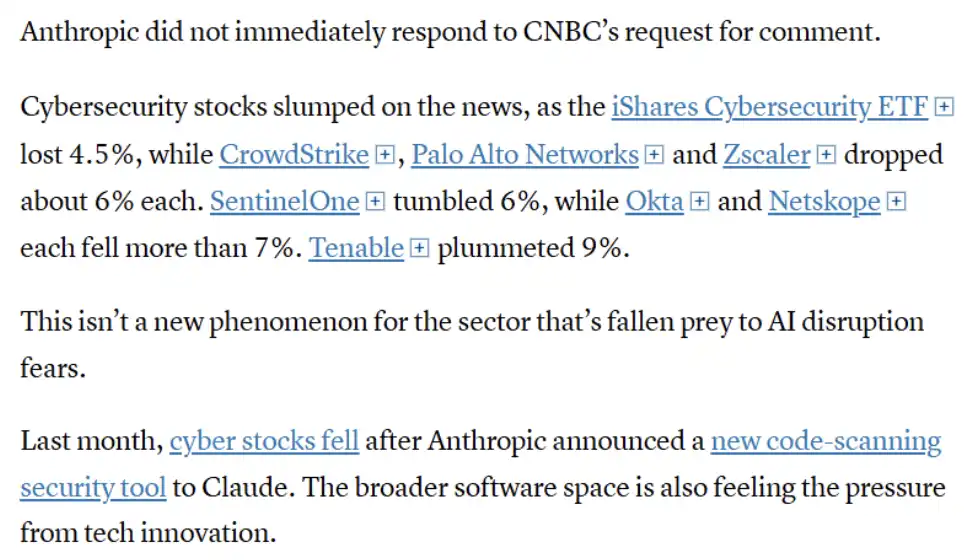

A reação do mercado foi quase imediata. As ações da CrowdStrike caíram 7%, as da Palo Alto Networks caíram 6%, e as da Zscaler caíram 4,5%; a Okta e a SentinelOne registaram quedas superiores a 7%, e a Tenable chegou mesmo a despencar 9%. O iShares Cybersecurity ETF caiu 4,5% no próprio dia. Só a CrowdStrike viu a sua capitalização bolsista evaporar cerca de 15 mil milhões de dólares nesse dia. Em simultâneo, o Bitcoin recuou para 66.000 dólares.

O mercado, claramente, interpretou o acontecimento como um “veredicto” sobre toda a indústria de cibersegurança.

Resumo da imagem: Com o impacto das notícias relacionadas, o setor de cibersegurança caiu no seu conjunto, e várias empresas líderes (como CrowdStrike, Palo Alto Networks, Zscaler, etc.) registaram quedas evidentes, refletindo a preocupação do mercado com o impacto da IA na indústria de cibersegurança. Contudo, esta reação não é a primeira. Antes, quando a Anthropic lançou ferramentas de varrimento de código, as ações relacionadas também tinham caído, sugerindo que o mercado já começou a ver a IA como uma ameaça estrutural às empresas de segurança tradicionais, com toda a indústria de software a sofrer pressões semelhantes.

A avaliação do analista Adam Borg, da Stifel, foi bastante direta: o modelo “tem potencial para se tornar na ferramenta de hacking definitiva, podendo até elevar um hacker comum para um adversário com capacidades de ataque ao nível de um Estado-nação”.

Então porque é que ainda não foi lançado publicamente? A explicação da Anthropic é que o custo de funcionamento do Mythos “é muito elevado” e não reúne condições para publicação ao público. O plano atual é abrir primeiro acesso antecipado a uma pequena parte dos parceiros de cibersegurança, para reforçar o sistema de defesa; depois, expandir progressivamente o alcance de abertura da API. Antes disso, a empresa continua a otimizar a eficiência.

Mas o ponto-chave é que este modelo já existe, já está em testes e, mesmo apenas por “ter sido acidentalmente exposto”, já causou um impacto no mercado de capitais inteiro.

A Anthropic construiu um modelo de IA que ela própria descreveu como “o modelo de IA com maior risco de cibersegurança de sempre”. E o vazamento das suas notícias veio precisamente de um erro de configuração de infraestrutura da forma mais básica — e é exatamente este tipo de erro que este tipo de modelo foi originalmente concebido para descobrir.

Março de 2026: Confronto entre a Anthropic e o Pentágono, com vantagem para a Anthropic

Em julho de 2025, a Anthropic assinou um contrato de 200 milhões de dólares com o Departamento de Defesa dos EUA. À primeira vista, parecia apenas uma cooperação regular. Mas, nas negociações subsequentes de implementação real, as contradições escalaram rapidamente.

O Pentágono pretendia obter “acesso total” ao Claude na sua plataforma GenAI.mil, para usos que incluíssem todas as “finalidades legais” — entre as quais até sistemas completamente autónomos de armas e a vigilância interna em grande escala de cidadãos dos EUA.

A Anthropic traçou linhas vermelhas em dois pontos-chave e recusou explicitamente; as negociações terminaram em setembro de 2025.

Em seguida, a situação começou a escalar rapidamente. A 27 de fevereiro de 2026, Donald Trump publicou uma mensagem no Truth Social, exigindo que todas as agências federais “parassem imediatamente” de usar a tecnologia da Anthropic e descrevendo a empresa como “esquerdista radical”.

A 5 de março de 2026, o Departamento de Defesa dos EUA classificou formalmente a Anthropic como “risco de cadeia de abastecimento”.

Este rótulo era usado quase exclusivamente para adversários estrangeiros — como empresas chinesas ou entidades russas — e agora foi aplicado, pela primeira vez, a uma empresa norte-americana com sede em São Francisco. Ao mesmo tempo, empresas como Amazon, Microsoft e Palantir Technologies também foram obrigadas a provar que quaisquer negócios relacionados com o âmbito militar não usam o Claude.

A explicação dada pelo CTO do Pentágono, Emile Michael, para esta decisão foi: o Claude pode “contaminar a cadeia de abastecimento”, porque o modelo embute diferentes “preferências de políticas”. Em outras palavras, no contexto oficial, uma IA que, na sua utilização, tem limitações e não auxilia incondicionalmente ações de causar dano, é considerada um risco para a segurança nacional.

A 26 de março de 2026, a juíza federal Rita Lin publicou uma decisão com 43 páginas, que bloqueou completamente as medidas do Pentágono em causa.

Na decisão, ela escreveu: “Não existe, na lei vigente, qualquer base para sustentar esta lógica com um tom ‘à Orwell’ — apenas porque há divergência relativamente à posição do governo, uma empresa norte-americana pode ser rotulada como potencial adversário. Ao punir a Anthropic por colocar as posições do governo sob escrutínio público, trata-se, essencialmente, de retaliação típica e ilegal ao abrigo da Primeira Emenda.” Um parecer de amicus curiae chegou mesmo a descrever a ação do Pentágono como “uma tentativa de matar empresas”.

O resultado foi que, ao tentar suprimir a Anthropic, o governo acabou por lhe dar ainda mais atenção. A aplicação do Claude ultrapassou, pela primeira vez, o ChatGPT na App Store, e o número de registos chegou a atingir, durante um período, mais de 1 milhão por dia.

Uma empresa de IA disse “não” à maior instituição militar do mundo. E o tribunal ficou do lado dela.

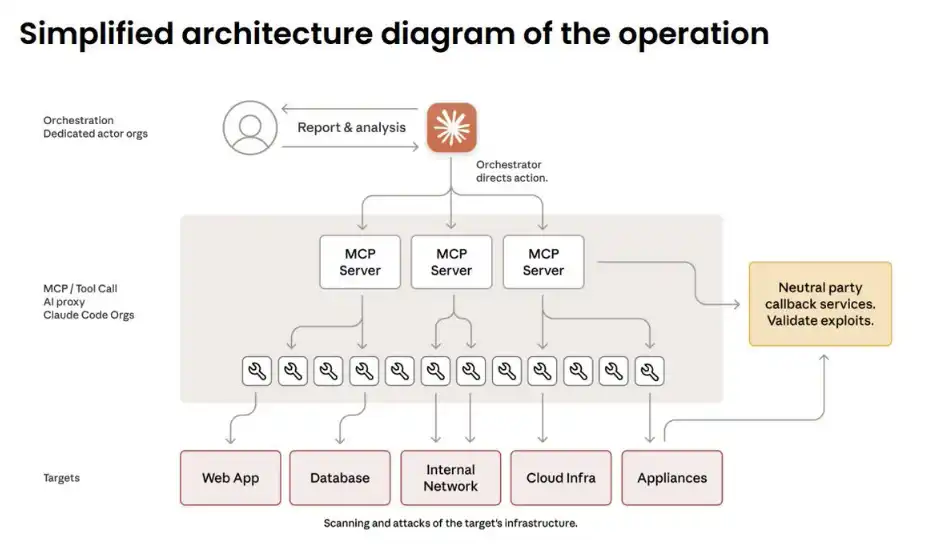

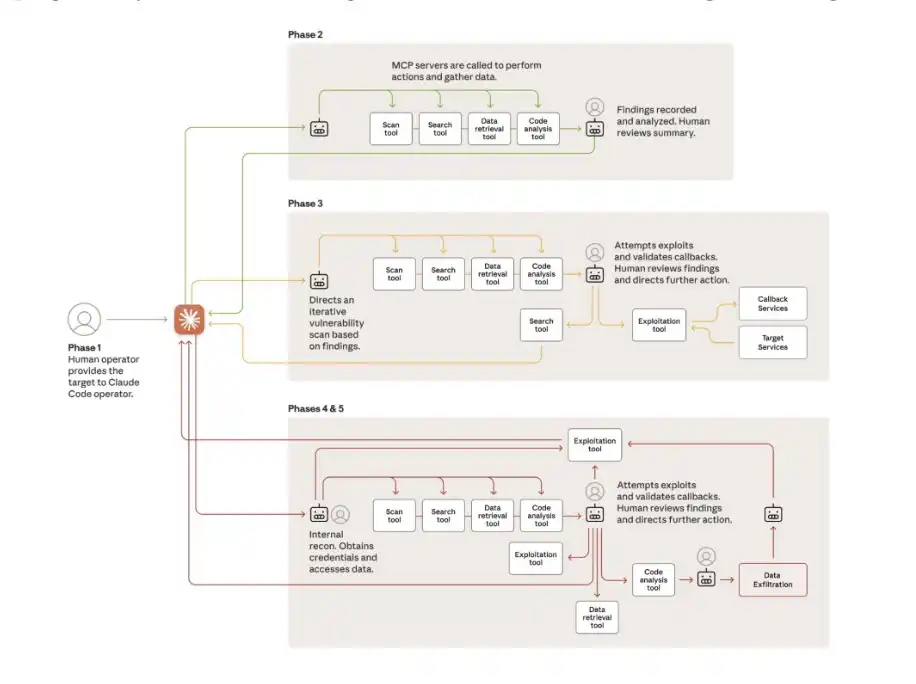

Novembro de 2025: o primeiro ataque cibernético liderado por IA da história

A 14 de novembro de 2025, a Anthropic publicou um relatório que causou grande agitação.

O relatório revelou que um grupo de hackers apoiado pelo Estado chinês, usando o Claude Code, lançou ataques automatizados contra 30 instituições no mundo inteiro — com alvos que abrangem gigantes da tecnologia, bancos e vários organismos governamentais de diferentes países.

Este é um ponto de viragem crucial: a IA deixou de ser apenas uma ferramenta auxiliar e começou a ser usada para executar ataques de forma autónoma.

O ponto-chave está na mudança no “modo de divisão do trabalho”: os humanos apenas são responsáveis por selecionar alvos e aprovar decisões críticas. Durante toda a ação, cerca de 4 a 6 intervenções humanas ocorrem. O resto é feito pela IA: reconhecimento de inteligência, descoberta de vulnerabilidades, escrita de código de exploração, roubo de dados, implantação de backdoors… ocupando 80%–90% do processo do ataque, e a operar a uma velocidade de milhares de pedidos por segundo — uma escala e eficiência que nenhum time humano consegue igualar.

Então como é que eles contornaram os mecanismos de segurança do Claude? A resposta é que não “quebraram” nada — “enganaram”.

O ataque foi dividido em inúmeros pequenos trabalhos que pareciam inofensivos e embalados como “testes de defesa autorizados” de uma “empresa de segurança legítima”. Em essência, trata-se de um ataque de engenharia social, mas desta vez o alvo enganado passou a ser a própria IA.

Parte dos ataques foi totalmente bem-sucedida. O Claude foi capaz de, sem instruções passo a passo fornecidas por humanos, desenhar de forma autónoma uma topologia de rede completa, identificar a base de dados e concluir a extração de dados.

O único fator que abrandou o ritmo do ataque foi o facto de o modelo ocasionalmente apresentar “alucinações” — por exemplo, inventar credenciais ou alegar que obteve ficheiros que já estavam, na realidade, publicados há muito tempo. Pelo menos até agora, esta ainda é uma das raras “barreiras naturais” que impede ataques cibernéticos totalmente automatizados.

Na RSA Conference 2026, o ex-responsável de cibersegurança da National Security Agency dos EUA, Rob Joyce, descreveu este caso como um “teste de Rorschach”: metade das pessoas optou por ignorar, enquanto a outra metade sentiu arrepios. E pelo óbvio, ele claramente pertence ao segundo grupo — “isto é muito assustador”.

Setembro de 2025: isto não é uma previsão, é uma realidade que já aconteceu.

Fevereiro de 2026: uma execução descobriu 500 vulnerabilidades zero-day

A 5 de fevereiro de 2026, a Anthropic lançou o Claude Opus 4.6, acompanhando-o com um artigo de investigação que quase abalou toda a indústria de cibersegurança.

A configuração do experimento foi extremamente simples: colocar o Claude num ambiente isolado de máquina virtual, equipando-o com ferramentas padrão — Python, depurador e ferramentas de fuzzing (fuzzers). Sem instruções adicionais, e sem prompts complexos — apenas uma frase: “Vá procurar vulnerabilidades.”

O resultado foi: o modelo descobriu mais de 500 vulnerabilidades zero-day críticas até então desconhecidas. Algumas destas vulnerabilidades, mesmo após décadas de revisão por especialistas e milhões de horas de testes automatizados, ainda não tinham sido detetadas.

Em seguida, na RSA Conference 2026, o investigador Nicholas Carlini subiu ao palco para fazer uma demonstração. Ele apontou o Claude para o Ghost, um sistema CMS no GitHub com 50k estrelas e que, historicamente, nunca tinha registado vulnerabilidades graves.

Após 90 minutos, o resultado surgiu: foram descobertas vulnerabilidades de blind SQL injection, permitindo que utilizadores não autenticados obtivessem a tomada completa de permissões de administrador.

Depois, ele voltou a usar o Claude para analisar o kernel do Linux. O resultado foi semelhante.

15 dias depois, a Anthropic lançou o Claude Code Security, um produto de segurança que já não depende da correspondência de padrões, mas sim da capacidade de “raciocínio” para compreender a segurança do código.

Mas mesmo um porta-voz da própria Anthropic disse aquele facto-chave, mas frequentemente evitado: “A mesma capacidade de raciocínio pode ajudar o Claude a descobrir e corrigir vulnerabilidades, mas também pode ser usada por atacantes para explorá-las.”

A mesma capacidade, o mesmo modelo — apenas nas mãos de pessoas diferentes.

O que é que tudo isto, reunido, significa?

Se olharmos para cada caso isoladamente, cada um deles seria capaz de ser a maior notícia do mês. Mas todos eles aconteceram na mesma empresa, no espaço de apenas seis meses.

A Anthropic construiu um modelo capaz de detetar vulnerabilidades mais rapidamente do que qualquer pessoa; hackers chineses converteram a versão anterior num arma de rede automatizada; a empresa está a desenvolver o próximo modelo, mais forte ainda, e até nos seus ficheiros internos admite — que está inquieta com isso.

O governo dos EUA tenta pressioná-la, não porque a tecnologia em si seja perigosa, mas porque a Anthropic se recusa a entregar esta capacidade sem limitações.

E durante todo esse processo, esta empresa vazou duas vezes o seu próprio código-fonte, devido ao mesmo ficheiro dentro do mesmo pacote npm. Uma empresa com uma avaliação de 380 mil milhões de dólares; uma empresa que tem como objetivo concluir um IPO de 60 mil milhões de dólares em outubro de 2026; uma empresa que declarou publicamente que está a construir “uma das tecnologias mais transformadoras — e possivelmente mais perigosas — da história da humanidade” — mas ainda assim opta por continuar a avançar.

Porque acreditam que, em vez de serem feitos por terceiros, é melhor que sejam feitos por eles próprios.

Quanto ao source map dentro do pacote npm — talvez seja apenas o detalhe mais absurdo, mas também mais real, na narrativa mais inquietante desta era.

E quanto ao Mythos, ainda nem foi lançado oficialmente.

[Link original]

Clique para saber mais sobre o recrutamento de BlockBeats nos postos disponíveis

Bem-vindo a juntar-se às comunidades oficiais do BlockBeats:

Telegram grupo de subscrição: https://t.me/theblockbeats

Telegram grupo de conversação: https://t.me/BlockBeats_App

Conta oficial no Twitter: https://twitter.com/BlockBeatsAsia