Bagaimana cara kerja Theta EdgeCloud? Ulasan mendalam mengenai keseluruhan alur kerja komputasi edge AI

Layanan AI cloud tradisional pada umumnya mengandalkan pusat data terpusat berskala besar. Meski mampu menyajikan daya komputasi tinggi, pendekatan ini menyebabkan biaya GPU mahal, manajemen sumber daya yang tersentralisasi, serta tantangan skalabilitas. Theta EdgeCloud hadir untuk mengatasi masalah tersebut dengan mengintegrasikan node edge ke dalam komputasi cloud—mengumpulkan sumber daya GPU menganggur dari seluruh dunia ke dalam satu jaringan terintegrasi demi meningkatkan pemanfaatan dan kolaborasi sumber daya secara terdistribusi.

Di tengah kompetisi infrastruktur AI yang kian sengit, Theta EdgeCloud menonjol sebagai solusi DePIN (Decentralized Physical Infrastructure Network) dan jaringan GPU terdistribusi terdepan. Alih-alih mengganti platform cloud tradisional secara penuh, tujuan utama Theta EdgeCloud adalah menyediakan kolaborasi sumber daya yang lebih fleksibel untuk kebutuhan inferensi AI dan komputasi edge.

Apa Itu Theta EdgeCloud

Theta EdgeCloud merupakan platform AI cloud hybrid berbasis ekosistem Theta Network. Pendekatan intinya memadukan Edge Node terdistribusi dengan layanan GPU cloud konvensional, membentuk jaringan sumber daya komputasi terpadu.

Berbeda dari layanan AI cloud terpusat pada umumnya, Theta EdgeCloud tidak hanya mengambil sumber daya dari server cloud, tetapi juga dari Edge Node yang dioperasikan pengguna global. Node ini berkontribusi GPU, CPU, dan bandwidth menganggur untuk mendukung inferensi AI, transkoding video, dan rendering.

Bagi pengembang, Theta EdgeCloud berfungsi sebagai lapisan komputasi AI yang secara dinamis mengatur sumber daya terdistribusi. Pengembang cukup mengajukan tugas melalui platform, dan sistem akan otomatis menangani alokasi serta eksekusi sumber daya—tanpa perlu pengelolaan node secara manual.

Bagaimana Theta EdgeCloud Berbeda dari Layanan AI Cloud Tradisional

Platform AI cloud tradisional mengandalkan pusat data besar dengan layanan GPU terpusat, serta penjadwalan dan pengelolaan sumber daya oleh penyedia cloud. Model ini memang stabil dan matang, namun rentan terhadap kelangkaan GPU dan lonjakan biaya.

Theta EdgeCloud justru menonjolkan konsep "berbagi sumber daya edge." Edge Node di seluruh dunia dapat menyumbangkan GPU menganggur untuk dimanfaatkan kembali. Ketika tugas AI diajukan, platform akan mengalokasikan sumber daya berdasarkan kebutuhan tugas, status node, dan daya komputasi yang tersedia.

Perbedaan utama antara Theta EdgeCloud dan platform AI cloud tradisional antara lain:

| Dimensi Perbandingan | Platform AI Cloud Tradisional | Theta EdgeCloud |

|---|---|---|

| Sumber Sumber Daya | Pusat Data Terpusat | GPU Cloud + Edge Node |

| Struktur Jaringan | Terpusat | Terdistribusi |

| Penjadwalan GPU | Pengelolaan Platform Terpusat | Kolaborasi Node Dinamis |

| Partisipasi Node | Penyedia Layanan Cloud | Sumber Daya Bersama Pengguna |

| Mekanisme Insentif | Biaya Layanan | Mekanisme Hadiah TFUEL |

Pendekatan ini menegaskan posisi Theta EdgeCloud sebagai jaringan GPU terdistribusi yang sebenarnya, bukan sekadar platform komputasi cloud konvensional.

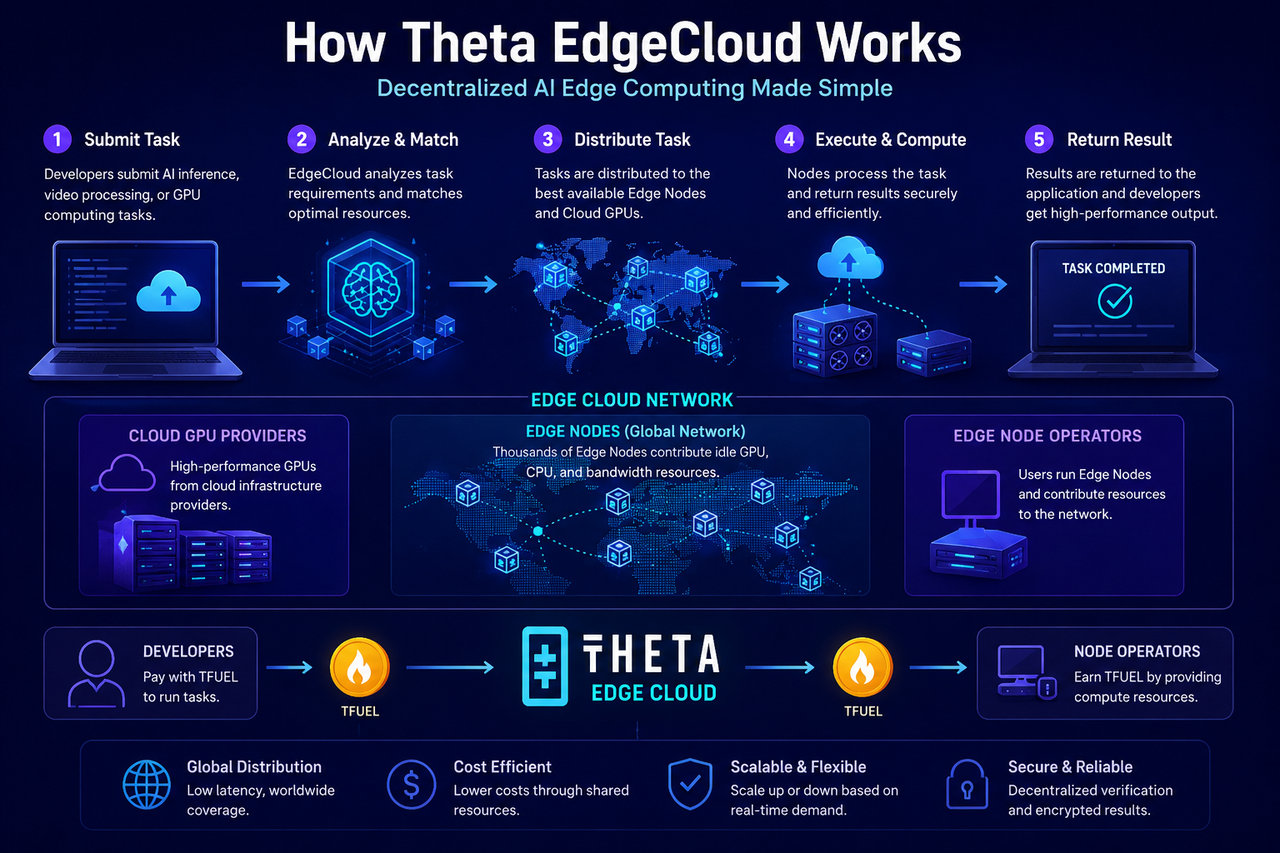

Apa yang Terjadi Ketika Pengguna Mengajukan Tugas AI

Ketika pengembang atau aplikasi mengajukan tugas inferensi AI, pemrosesan video, atau rendering, Theta EdgeCloud akan menganalisis kebutuhan sumber daya—mulai dari tipe GPU, memori, waktu komputasi, hingga bandwidth.

Sistem kemudian mencari node yang sesuai di jaringan. Sebagian tugas akan diproses oleh GPU cloud, sementara tugas lain didistribusikan ke Edge Node seluruh dunia untuk pemrosesan kolaboratif. Semua proses berjalan otomatis tanpa perlu pemilihan node manual dari pengembang.

Selama eksekusi, sistem secara berkelanjutan memantau status node dan progres tugas. Jika ada node yang offline atau kekurangan sumber daya, platform akan mengalihkan tugas ke node lain demi menjaga stabilitas komputasi.

Setelah selesai, hasil dikirimkan kembali ke aplikasi, dan node yang berpartisipasi memperoleh hadiah TFUEL sesuai kontribusi sumber daya.

Pada dasarnya, ini adalah "sistem penjadwalan sumber daya terdistribusi" yang menyatukan pemanfaatan daya komputasi menganggur di seluruh jaringan.

Bagaimana Edge Node Berperan dalam Komputasi GPU

Edge Node merupakan komponen kunci Theta EdgeCloud. Dengan menjalankan Edge Node, pengguna menghubungkan GPU dan sumber daya komputasi lokalnya ke jaringan Theta.

Saat jaringan mendeteksi permintaan inferensi AI, rendering video, atau komputasi edge, tugas akan dialokasikan ke node tersebut. Setelah tugas selesai, node menerima hadiah TFUEL sebanding dengan kontribusi komputasi yang diberikan.

Berbeda dari mesin penambangan konvensional, Edge Node Theta tidak fokus pada penambangan PoW melainkan memberikan sumber daya komputasi nyata. Inilah alasan utama Theta dikategorikan sebagai proyek DePIN.

Bagi pengguna, Edge Node berfungsi sebagai gerbang partisipasi di jaringan Theta dan menjadi bagian penting dalam mekanisme berbagi sumber daya.

Bagaimana Sirkulasi TFUEL di EdgeCloud

TFUEL adalah token utilitas utama dalam Theta EdgeCloud yang berfungsi sebagai alat pembayaran sekaligus insentif dalam jaringan.

Saat pengembang mengajukan tugas AI atau video, mereka membayar TFUEL sebagai biaya sumber daya. Sistem kemudian membagikan sebagian TFUEL kepada Edge Node yang berkontribusi dalam komputasi sesuai pelaksanaan tugas.

Dalam ekosistem EdgeCloud, TFUEL menghubungkan:

-

Pengembang aplikasi AI

-

Penyedia sumber daya GPU

-

Jaringan Edge Node

-

Infrastruktur Theta

Hal ini menciptakan siklus "pembayaran tugas—eksekusi sumber daya—hadiah node".

Skenario Aplikasi Utama Theta EdgeCloud

Theta EdgeCloud berfokus pada kebutuhan komputasi AI dan media.

Untuk AI, aplikasi meliputi:

-

Inferensi model AI

-

Inferensi model bahasa besar

-

Pembuatan gambar

-

Komputasi GPU terdistribusi

Di bidang video dan media, Theta EdgeCloud mendukung:

-

Transkoding video

-

Rendering video

-

Pemrosesan live streaming

-

Pendistribusian konten edge

Berkat node edge yang tersebar di seluruh dunia, tugas dengan tuntutan real-time tinggi dapat memanfaatkan komputasi edge untuk memangkas latensi.

Seiring bertemunya infrastruktur AI dan Web3, Theta EdgeCloud menjadi bagian sentral dalam ekspansi Theta dari ekosistem video menuju sektor AI.

Tantangan Theta EdgeCloud

Walau jaringan GPU terdistribusi menawarkan berbagi sumber daya dan skalabilitas, Theta EdgeCloud tetap menghadapi tantangan nyata.

Pertama, tidak semua edge node memiliki spesifikasi perangkat keras seragam—perbedaan performa GPU dapat memengaruhi efisiensi tugas. Kedua, sifat jaringan yang terdistribusi meningkatkan kerumitan penjadwalan sumber daya dan manajemen tugas.

Bersamaan dengan itu, persaingan di pasar infrastruktur AI semakin ketat, baik dari platform cloud tradisional maupun proyek jaringan GPU terdistribusi lain yang berebut pangsa pasar komputasi AI.

Selain itu, permintaan GPU berkinerja tinggi yang meningkat akibat AI generatif membuat akses serta penjadwalan sumber daya GPU yang stabil menjadi tantangan jangka panjang bagi EdgeCloud.

Ringkasan

Theta EdgeCloud, yang diinisiasi oleh Theta Network sebagai platform AI dan komputasi edge terdesentralisasi, bertujuan membangun jaringan komputasi AI terdistribusi melalui orkestrasi Edge Node global dan GPU cloud.

Dibandingkan layanan AI cloud terpusat konvensional, Theta EdgeCloud mengutamakan berbagi sumber daya edge, kolaborasi GPU, dan penjadwalan terdistribusi. Pengembang dapat mengajukan tugas inferensi AI serta pemrosesan video lewat platform, sementara node global menjalankan tugas-tugas ini dan memperoleh hadiah TFUEL.

Dengan meningkatnya permintaan akan inferensi AI dan sumber daya GPU, Theta EdgeCloud mendorong evolusi Theta dari platform streaming video menjadi solusi infrastruktur AI yang menyeluruh.

FAQ

Bagaimana Cara Kerja Theta EdgeCloud?

Saat pengembang mengajukan tugas AI atau video, sistem secara otomatis mendistribusikan ke GPU cloud dan Edge Node untuk pemrosesan kolaboratif, dengan TFUEL sebagai alat pembayaran sumber daya serta hadiah node.

Apa Peran Edge Node di EdgeCloud?

Edge Node menyediakan GPU dan sumber daya komputasi untuk mengeksekusi tugas inferensi AI, rendering video, dan komputasi edge.

Apa Perbedaan Theta EdgeCloud dengan Layanan AI Cloud Tradisional?

Layanan AI cloud tradisional bergantung pada pusat data terpusat, sedangkan Theta EdgeCloud memadukan edge node dan GPU cloud untuk membangun jaringan sumber daya terdistribusi.

Untuk Apa TFUEL Digunakan di EdgeCloud?

TFUEL digunakan untuk membayar biaya tugas AI dan video, serta menjadi token hadiah bagi node setelah tugas diselesaikan.

Apakah Theta EdgeCloud Termasuk Proyek DePIN?

Berkat model dasarnya yang berbasis berbagi GPU dan sumber daya komputasi edge, Theta EdgeCloud sering dikategorikan sebagai proyek DePIN dan jaringan GPU terdistribusi.

Artikel Terkait

Apa itu privacy smart contract? Bagaimana Aztec mengimplementasikan programmable privacy?

Aztec vs Zcash vs Tornado Cash: Analisis Komparatif Perbedaan Utama dalam Tiga Solusi Privasi

Tokenomik USD.AI: Analisis Kedalaman Kasus Penggunaan Token CHIP dan Mekanisme Insentif

Analisis Sumber Keuntungan USD.AI: Cara Pinjaman Infrastruktur AI Menghasilkan Keuntungan

Analisis Kedalaman Audiera GameFi: Cara Dance-to-Earn Memadukan AI dengan Permainan Ritme